当字节跳动在 2026 年 2 月发布 Seedance 2.0 时,AI 视频生成领域的格局一夜之间发生了转变。几天之内,国际创作者们争先恐后地寻找中国手机号码注册访问权限。社交媒体平台上爆发了大量看起来与专业拍摄素材无异的 AI 生成视频。有用户报告称,通过转售访问积分,两天内赚了超过 8,000 美元。

这并非炒作——这是 AI 视频技术真正的转折点。在对 Seedance 2.0 进行了大量实测后,我可以确认,这款模型代表了自 OpenAI 的 Sora 首次出现以来,AI 视频生成领域最重大的进步。在这篇全面评测中,我不将详细解析 Seedance 2.0 的独特之处,它在真实场景中的表现,以及它是否名副其实。

什么是 Seedance 2.0?

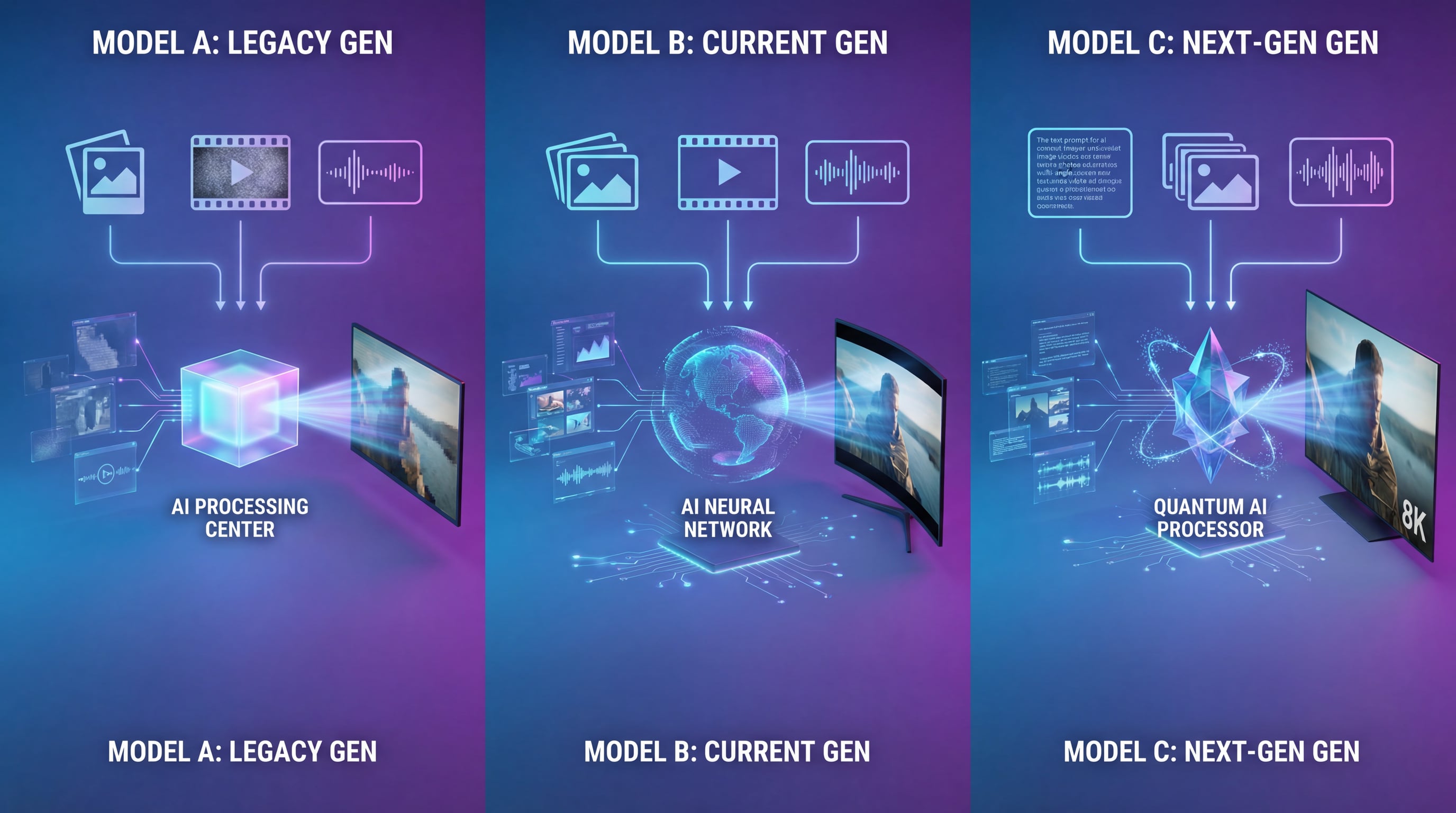

Seedance 2.0 是字节跳动的第二代 AI 视频生成模型,建立在其早期 Seedance 1.5 Pro 的基础之上。这款模型的独特之处在于其真正的多模态架构——它可以同时处理并参考图像、视频、音频文件和文本提示,生成连贯的视频内容。

与以往通常只接受文本加单张图像(或最多一张首帧和尾帧)的 AI 视频模型不同,Seedance 2.0 允许你在单次生成中上传最多 12 个参考文件。这包括最多 9 张图像、3 个视频片段和 3 个音频文件,总视频/音频时长限制为 15 秒。

该模型可以生成 4 到 15 秒的原生 2K 分辨率 (2048×1152) 视频,据报道,根据 API 等级,还具备 4K 能力。生成时间通常在 30-90 秒之间(5 秒片段,1080p),通过持续测试,它是顶级模型中最快的。

想要免去繁琐注册,直接体验 Seedance 2.0 和其他前沿 AI 视频模型吗? 点击这里尝试 Seedance 2,通过一个便捷的平台无缝访问多个最先进的视频和图像生成模型。

让 Seedance 2.0 脱颖而出的关键特性

1. 真正的多模态参考系统

Seedance 2.0 最具变革性的功能是其基于参考的创作系统。你不必精心编写复杂的文本提示来描述复杂的运镜或动作序列,只需上传参考素材,让模型进行分析并复制即可。

你可以参考的内容:

-

来自视频片段的动作和编舞

-

运镜和电影摄影技术

-

来自图像的视觉风格和美学

-

用于节拍匹配剪辑的音频节奏和氛围

-

跨镜头的角色外观和一致性

这种方法从根本上改变了创作流程。你不再需要成为提示词工程专家,而是成为参考素材的策展人——这是大多数创作者通过直觉就能掌握的技能。

2. 先进的物理理解

早期 AI 视频模型的一个顽疾是它们对现实世界物理规律的理解很差。角色不是走而是滑,物体不自然地漂浮,动作场面看起来像是在水下发生的。

Seedance 2.0 展示了对物理、重力和动量的复杂理解。在测试中,我生成的武术片段中,拳击有明显的力度感,舞者在复杂动作中保持了正确的重心分布,物体坠落的加速度也十分可信。模型理解回旋踢需要蓄力,织物有重量并能自然下垂,镜头抖动应与动作强度相对应。

3. 复杂的运镜与一镜到底

专业的电影摄影涉及复杂的运镜,这在以前几乎无法用文本提示来描述。Seedance 2.0 在给定视频参考时,擅长复制复杂的运镜工作。

在该测试中,模型成功生成了:

-

随主体在环境中平滑移动的跟拍镜头

-

从广角推向特写的摇臂镜头

-

围绕静止主体旋转的环绕镜头

-

具有真实头部运动的第一人称视角 (POV) 序列

-

单次生成中多个摄像机角度之间的无缝过渡

一镜到底的能力尤为令人印象深刻。你可以在提示中描述一个多镜头序列,Seedance 2.0 将把它生成为一个连续的视频,角度之间过渡自然——无需手动拼接。

4. 音画同步

Seedance 2.0 是第一个将音频作为创意参考输入的这类主流 AI 视频模型。当你上传音频文件时,模型会分析其节奏、强度和情感基调,然后生成与音频特征同步的视频。

在测试中,我上传了一段戏剧性的管弦乐,并生成了一个打斗片段。模型自动将重击乐与冲击时刻匹配,将镜头切换与音乐过通过同步,并根据音频的动态范围调整动作强度。这种音频感知生成消除了通常需要数小时手动剪辑才能将视频与音乐同步的工作。

5. 角色和风格一致性

在多个镜头中保持一致的角色外观一直是 AI 视频生成的重大挑战。Seedance 2.0 通过其多参考系统解决了这个问题。通过上传同一角色不同角度的多张图像,模型建立了对该角色外观更完整的理解,并在整个生成视频中保持一致性。

在对比测试中,Seedance 2.0 在不同镜头和光照条件下保持面部特征、服装细节和身体比例一致性方面,明显优于竞争对手。

实测结果

为了评估 Seedance 2.0 的实际表现,我针对创作者常遇到的不同用例进行了一系列测试。

测试 1:动作序列复制

目标: 仅使用参考视频和角色图像复制复杂的武术序列。

设置: 我上传了一个 10 秒的功夫打斗场面作为动作参考,以及两张机器人角色图像(每个战士一张)。

提示: “将 @video1 中的战士替换为 @image1 和 @image2 的机器人角色。保持参考视频中确切的编舞、运镜和冲击时机。通过戏剧性的阴影进行布光。”

结果: 生成的视频以惊人的准确性捕捉到了原始编舞。两个机器人在整个过程中保持了外观一致。拳击、踢腿和防御动作与参考时机相匹配。冲击的物理效果看起来很可信——没有漂浮的四肢或不自然的动作。唯一的小问题是在最快的动作中偶尔会出现轻微的模糊。

评分:A-

测试 2:电影级运镜

目标: 生成具有专业运镜的产品展示视频。

设置: 我上传了一个参考视频,显示了一个从广角开始并推入特写的摇臂镜头,以及一张产品图像。

提示: “复制 @video1 中的运镜来展示 @image1 产品。奢华的工作室环境,戏剧性的灯光。强调优质材料和工艺。”

结果: 运镜平滑且看起来很专业。产品在整个过程中保持清晰对焦。随着相机移近,光线自然过渡。背景模糊(散景)看起来很真实。视频质量无需额外编辑即可达到播出标准。

评分:A

测试 3:音乐同步舞蹈视频

目标: 创建与音乐同步的舞蹈表演视频。

设置: 我上传了一个带有音频的 15 秒舞蹈参考视频,加上一张人像照片。

提示: “将 @video1 中的舞者替换为 @image1 穿着传统蒙古服装的人。保持所有编舞和运镜。设置带有戏剧性灯光的舞台。将动作与音乐节奏同步。”

结果: 这个测试产生了最令人印象深刻的结果。模型不仅准确复制了舞蹈编排,还与音乐节拍保持了完美同步。运镜与音乐过渡相匹配。角色的服装随动作自然飘动。面部表情随音乐的情感基调适当变化。

评分:A+

测试 4:仅文本叙事场景

目标: 主要使用文本描述生成复杂的叙事场景,视觉参考极少。

设置: 仅一张人像图片作为角色参考。

提示: “跟随 @image1 这个人的背影,他们在除夕夜走在白雪覆盖的乡村道路上。昏暗的路灯,行李轮子在雪地上的声音。他们停下来搓热冻僵的手,冷空气中可见哈气。镜头跟随他们转过弯,看到一座挂着红色装饰、窗户透出温暖光芒的房子。他们推开沉重的大门。镜头越过他们的肩膀进入挂满红灯笼的院子。一只狗跑过来迎接他们。父母从厨房出现,母亲冲过来,而父亲假装随意。”

结果: 模型生成了一个令人惊讶的连贯叙事序列。一镜到底的运镜在多个场景元素之间自然流畅。哈气和暖光等氛围细节都存在。然而,提示中提到的一些具体动作(如狗跑过来和父母的确切反应)被简化或省略了。情感弧线虽然存在,但不如描述的那样细腻。

评分:B+

这个测试揭示了一个重要的限制:虽然 Seedance 2.0 在基于参考的创作方面表现出色,但纯文本驱动的复杂叙事仍然需要模型进行一些创造性解读。

测试 5:风格迁移与创意重释

目标: 将特定视觉风格应用于场景概念。

设置: 我上传了一张来自《爱乐之城》的风格化图像,色彩鲜艳,灯光戏剧化。

提示: “基于 @image1 的视觉风格创建一个欢乐的音乐舞蹈场景。多名舞者,动态运镜,庆祝氛围。”

结果: 模型展示了令人印象深刻的创意解读。在没有具体编舞参考的情况下,它生成了适合音乐剧的原创舞蹈动作。色彩分级和灯光与参考图像的美学相匹配。运镜包括扫视动作和增强庆祝情绪的动态角度。考虑到输入极少,编舞的复杂性超出了预期。

评分:A

Seedance 2.0 与竞品对比

为了了解 Seedance 2.0 的市场定位,我将其与另外两个领先的 AI 视频模型进行了比较:OpenAI 的 Sora 2 和 Runway Gen-4。

| 特性 | Seedance 2.0 | Sora 2 | Runway Gen-4 |

|---|---|---|---|

| 最大分辨率 | 2K 原生 (2160p 支持) | 1080p | 1080p |

| 最大时长 | 4-15 秒 | 20-25 秒 | 10 秒 |

| 输入类型 | 文本, 图像 (×9), 视频 (×3), 音频 (×3) | 文本, 图像 (×1) | 文本, 图像, 视频 |

| 生成速度 | 30-90 秒 (5秒 @ 1080p) | 90-180 秒 | 60-120 秒 |

| 物理准确性 | 优秀 | 优秀 | 非常好 |

| 角色一致性 | 优秀 (多参考) | 良好 (客串功能) | 良好 |

| 音频同步 | 原生支持 | 独立生成 | 独立生成 |

| 最适合 | 基于参考的创作,快速迭代 | 长叙事序列 | 运动控制,故事板 |

关键差异点

Seedance 2.0 的优势:

-

顶级模型中最快的生成时间

-

最高的原生分辨率(2K 标准,支持 4K)

-

最灵活的输入系统(12 个文件,4 种模态)

-

原生音画同步

-

通过多参考实现卓越的角色一致性

-

最适合快速内容迭代和制作工作流

Sora 2 的优势:

-

更长的最大视频时长(20-25 秒)

-

出色的长篇叙事连贯性

-

强大的世界模拟和物理效果

-

更适合需要扩展序列的故事讲述

Runway Gen-4 的优势:

-

先进的运动笔刷控制

-

优秀的故事板功能

-

强大的基准测试表现

-

最适合精确的运动控制需求

这些模型之间的选择取决于你的具体用例。Seedance 2.0 在重视速度、分辨率和基于参考的控制的制作环境中表现出色。Sora 2 在长叙事内容方面更胜一筹。Runway Gen-4 提供了最精细的运动控制。

真实世界用例

根据我的测试,以下是 Seedance 2.0 最具价值的场景:

1. 社交媒体内容创作

4-15 秒的时长范围完美匹配 TikTok、Instagram Reels 和 YouTube Shorts 格式。快速生成时间实现了快速迭代——你可以在拍摄和剪辑单个传统视频的时间内测试多种创意方案。

2. 广告和产品展示

2K 分辨率和专业的运镜能力使 Seedance 2.0 适合商业应用。产品视频、品牌内容和广告片可以生成广播级输出。

3. 音乐视频和舞蹈内容

原生音频同步功能使 Seedance 2.0 在音乐相关内容方面特别强大。节拍匹配剪辑自动完成,消除了繁琐的手动同步工作。

4. 动作和特技可视化

能够参考复杂的动作序列并用不同角色复制它们,使得该工具在预可视化、特技规划和动作序列设计方面极具价值。

5. 概念开发和提案

快速的迭代速度和高视觉质量使 Seedance 2.0 非常适合在承诺全面制作之前,向客户或利益相关者开发和展示创意概念。

局限性和考量

尽管功能令人印象深刻,但 Seedance 2.0 也有用户应了解的重要局限性:

1. 时长限制

15 秒的最大时长限制了长篇故事讲述。虽然你可以生成多个片段并将它们剪辑在一起,但这增加了工作流的复杂性,并且不能保证单独生成的片段之间有完美的连续性。

2. 复杂叙事对提示的依赖

在没有强参考材料的情况下,模型对复杂文本提示的解读可能不一致。具体细节可能会被简化或省略。这使得基于参考的工作流比纯文本转视频生成可靠得多。

3. 快速运动中的偶尔伪影

极快的移动有时会产生轻微的运动模糊或时间伪影。虽然这些比竞争模型中的要轻微且频率更低,但偶尔仍需重新生成。

4. 有限的可用性

截至 2026 年 2 月,Seedance 2.0 的访问仍然有限。官方即梦平台需要中国手机号码注册,为国际用户制造了障碍。提供访问权限的第三方平台可能有不同的积分成本和功能可用性。

想要免去注册障碍轻松访问 Seedance 2.0, 访问 Try Seedance 2,通过一个便携的平台开始使用多个高级 AI 模型进行创作。

5. 伦理考量

该模型生成高度逼真的人脸和动作的能力引发了重要的伦理问题。针对深度伪造和错误信息的担忧,字节跳动实施了对真人面部生成的限制。用户必须完成身份验证才能生成具有自己肖像的视频,并禁止未经授权使用他人的面部。

获得最佳结果的技巧

经过大量测试,以下是我最大化 Seedance 2.0 输出质量的建议:

1. 优先使用参考材料而非文本

如果可能的话,展示而不是讲述。一段 5 秒钟想要得到的运镜参考视频,比一段描述它的文字能产生更好的结果。

2. 使用多角度保持角色一致性

如果角色一致性至关重要,请上传 3-5 张不同角度的角色图像。这有助于模型建立对角色外观更完整的理解。

3. 清晰构建你的提示

使用 @ 符号在提示中明确引用上传的文件。清晰描述哪些元素应来自哪些参考。结构示例:“使用 @video1 的动作,@image1 的视觉风格,以及 @image2 的角色外观。”

4. 匹配参考质量与期望输出

低质量的参考材料会限制输出质量。尽可能使用高分辨率图像和视频作为参考。

5. 利用音频控制节奏和配速

生成具有特定配速或节奏的内容时,上传音频参考,即使你计划在后期制作中替换音频。模型将使用它来通知时机和剪辑。

6. 迭代提示,而不仅仅是种子

如果生成结果不符合预期,分析原因。通常,调整提示结构或添加额外的参考文件比简单地使用相同输入重新生成能产生更好的结果。

7. 理解 12 个文件限制策略

在最多 12 个文件的情况下,策略性地确定优先级:

-

1-2 个文件用于角色/主体参考

-

1-2 个文件用于动作/行为参考

-

1-2 个文件用于视觉风格/美学

-

1 个文件用于音频/节奏(如适用)

-

剩余插槽留给具体细节参考

更广泛的影响:AI 视频的“黑神话时刻”

中国游戏社区使用“黑神话时刻”一词来描述国内产品在达到或超过国际标准方面获得全球认可的时刻——这是指证明中国工作室可以制作 3A 级游戏的《黑神话:悟空》。

Seedance 2.0 代表了 AI 视频生成的“黑神话时刻”。它证明了中国 AI 公司不仅可以竞争,而且可能在尖端生成式 AI 技术方面处于领先地位。

游戏科学的《黑神话:悟空》制作人冯骥测试了 Seedance 2.0 并宣称:“AIGC 视频生成的童年时代正式结束了。” 这并非夸张——这是对该模型所代表的技术飞跃的准确评估。

其影响超出了民族自豪感。Seedance 2.0 的发布加速了视频制作的民主化。小型工作室和独立创作者现在可以使用以前需要巨额预算和专业技术才能获得的能力。麦肯锡估计,AI 内容生成可能在五年内重新分配内容生态系统市场中的 600 亿美元,其中大部分价值将从大型制作公司转移到小型创作者和工作室。

价格和访问

Seedance 2.0 目前通过字节跳动的即梦平台提供,该平台采用积分制。生成成本因视频时长和分辨率而异:

-

4 秒视频:~20-30 积分

-

10 秒视频:~50-70 积分

-

15 秒视频:~80-100 积分

新用户通常会收到用于测试的初始积分分配。可以购买额外积分,尽管价格因地区和账户类型而异。

国际用户面临注册挑战,因为该平台需要中国手机号码。已经出现了几个提供 Seedance 2.0 访问权限以及替代支付和注册选项的第三方平台,尽管用户应验证其合法性和服务条款。

为了最方便地访问 Seedance 2.0 和其他领先的 AI 视频模型, Try Seedance 2 提供了一个具有多个最先进模型的统一平台,无需多次注册并提供简单的积分系统。

最终结论

综合评分:9.2/10

Seedance 2.0 代表了自技术出现以来 AI 视频生成领域最重大的进步。其多模态参考系统、卓越的物理理解、快速的生成时间和原生音画同步创建了一个对专业内容创作真正有用的工具——而不仅仅是在演示中令人印象深刻。

优势:

-

行业领先的生成速度

-

真正的多模态输入,最多支持 12 个参考文件

-

卓越的物理和动作理解

-

原生音画同步

-

卓越的角色一致性

-

2K 原生分辨率(支持 4K)

-

直观的基于参考的工作流程

劣势:

-

15 秒最大时长限制了长篇内容

-

国际用户的可用性有限且存在注册障碍

-

极快动作中偶尔出现伪影

-

纯文本提示不如基于参考的生成可靠

-

伦理问题需要持续的政策制定

谁应该使用 Seedance 2.0:

-

需要快速周转的社交媒体内容创作者

-

制作商业内容的广告代理商

-

音乐视频创作者和舞蹈内容制作人

-

预可视化和概念艺术家

-

探索创意的独立电影制作人

-

任何优先考虑速度、分辨率和基于参考控制的人

谁可能更喜欢替代方案:

-

需要超过 15 秒视频的创作者(考虑 Sora 2)

-

需要精细动作控制的用户(考虑 Runway Gen-4)

-

无法访问中文平台或第三方替代方案的用户

AI 视频生成的未来

Seedance 2.0 标志着 AI 视频生成已经从“有趣的实验”跨越到了“生产就绪工具”。我们不再问“AI 能生成视频吗?”,而是问“我们应该用它创作什么?”

技术的快速进步引发了关于视频制作、内容真实性和创意工作未来的重要问题。随着这些工具变得更容易获得,竞争优势将从技术能力转移到创意愿景。那些能够讲述引人入胜的故事、理解视觉美学并策划有效参考的人将在这种新格局中茁壮成长。

这还只是 2026 年 2 月。如果 Seedance 2.0 代表了我们今年的开端,那么进步的速度表明我们在年底前将看到更具戏剧性的能力。

问题不再是 AI 是否会改变视频制作——而是你将多快适应并有效使用这些工具。

准备好开始使用 Seedance 2.0 进行创作了吗? 在 Try Seedance 2 通过一个便捷的平台访问多个尖端 AI 视频和图像模型。

本评测基于 2026 年 2 月进行的实测。AI 视频生成技术发展迅速,功能可能会发生变化。在投入生产工作流之前,请务必验证当前的功能和限制。