Le paysage de la génération vidéo par IA a atteint un moment charnière en 2026. Deux modèles dominent désormais la conversation : Seedance 2.0 de ByteDance et Sora 2 d'OpenAI. Tous deux représentent des avancées significatives dans la technologie de synthèse vidéo, mais abordent les mêmes défis créatifs avec des philosophies fondamentalement différentes. Ce comparatif exhaustif examine chaque dimension importante — des spécifications techniques et de la qualité de sortie aux structures tarifaires et aux cas d'utilisation réels — pour vous aider à comprendre quel modèle offre les capacités dont vous avez réellement besoin.

Ce qui rend Seedance 2 différent

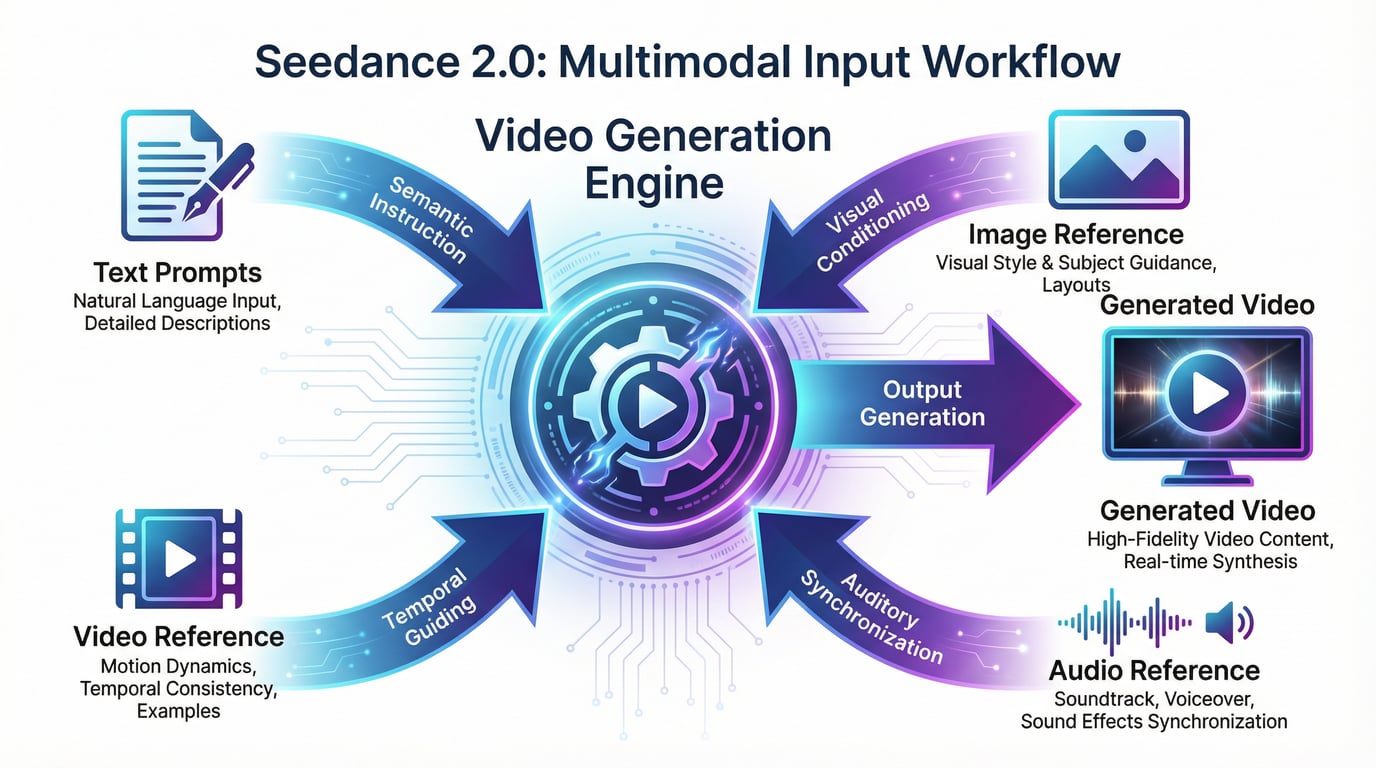

Seedance 2.0 introduit une architecture multimodale unifiée qui change fondamentalement la façon dont les créateurs interagissent avec la génération vidéo par IA. Contrairement aux modèles traditionnels texte-vers-vidéo qui reposent principalement sur des invites écrites, Seedance 2.0 accepte quatre types d'entrées simultanées : les descriptions textuelles, les images de référence, les clips vidéo et les pistes audio. Ce système de référence quad-modal vous permet de spécifier exactement ce que vous voulez en montrant des exemples au modèle, plutôt que d'essayer de tout décrire avec des mots.

Les implications pratiques sont considérables. Si vous avez besoin d'un mouvement de caméra spécifique, vous téléchargez une vidéo de référence démontrant ce mouvement exact. Si vous voulez un style visuel particulier, vous fournissez une image capturant cette esthétique. Si vous avez besoin d'un audio synchronisé avec des rythmes ou des battements spécifiques, vous fournissez la piste audio directement. Le modèle combine ces références selon vos instructions en langage naturel, vous donnant un contrôle de niveau réalisateur sans nécessiter d'expertise technique en ingénierie de prompts.

Cette approche multimodale résout l'un des problèmes les plus persistants de la génération vidéo par IA : l'écart entre l'intention créative et le résultat réel. Les modèles précédents contraignaient les créateurs à un cycle frustrant de raffinement des invites, espérant tomber sur la combinaison magique de mots qui produirait le résultat souhaité. Seedance 2.0 élimine une grande partie de ces conjectures en vous permettant de communiquer via plusieurs canaux simultanément.

Spécifications techniques : Là où chaque modèle brille

Résolution et qualité de sortie

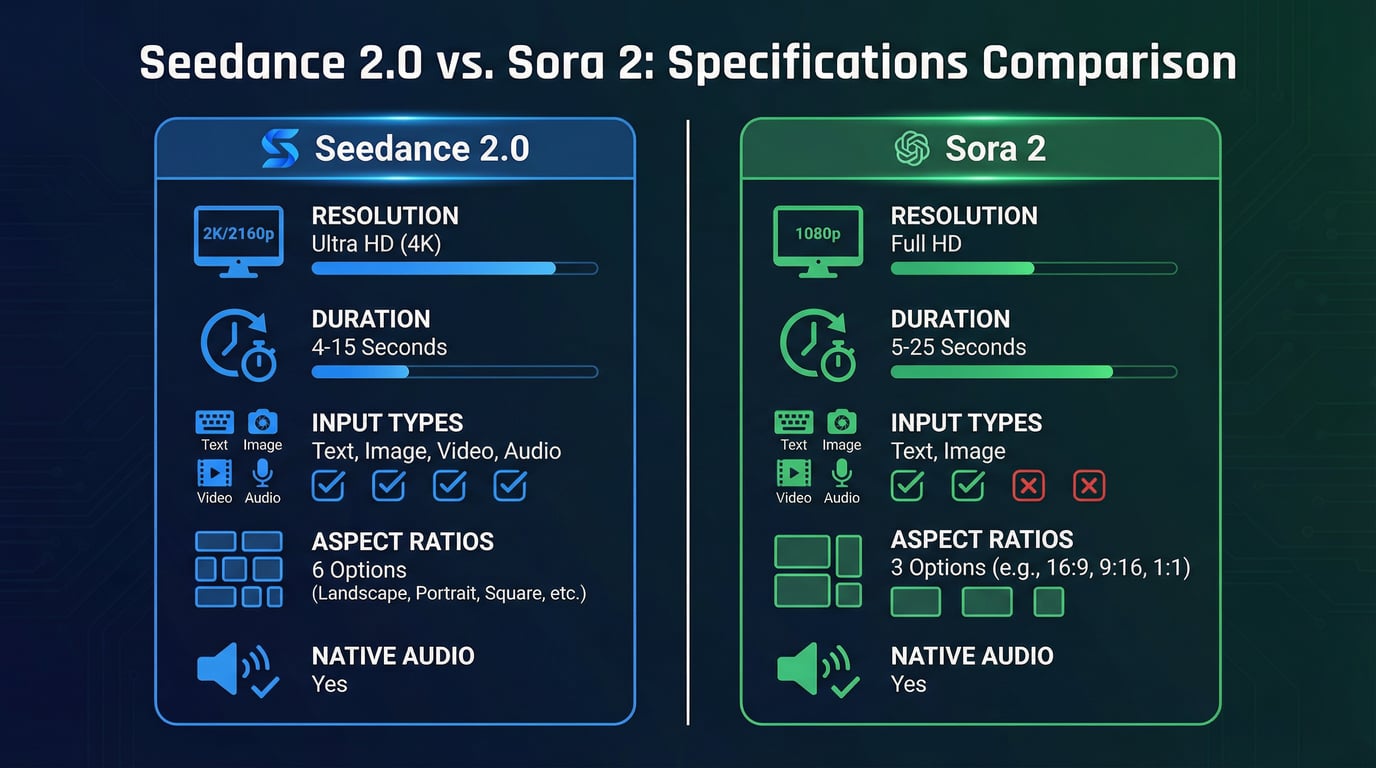

Seedance 2.0 offre une résolution native 2K à 2048×1152 pixels, se positionnant comme l'option de plus haute résolution actuellement disponible dans les modèles vidéo IA de production. Cet avantage de résolution est critique pour le contenu destiné aux grands écrans, aux campagnes publicitaires haute définition ou à toute application où la fidélité visuelle impacte directement la qualité perçue. Le modèle prend en charge six rapports d'aspect : 16:9, 9:16, 4:3, 3:4, 21:9 et 1:1, couvrant pratiquement tous les cas d'utilisation courants, des vidéos YouTube aux Stories Instagram en passant par les formats cinématographiques ultra-larges.

Sora 2 atteint une résolution maximale de 1080p, ce qui reste professionnel pour la plupart des applications mais est en retrait par rapport à la fidélité de sortie de Seedance 2.0. Là où Sora 2 compense cela, c'est dans sa gestion exceptionnelle de l'éclairage, des détails de texture et de l'étalonnage des couleurs. Le modèle démontre une compréhension sophistiquée de la façon dont la lumière se comporte dans les espaces physiques, produisant des vidéos avec une profondeur cinématographique et une richesse visuelle qui dépassent parfois des concurrents à plus haute résolution.

Durée de la vidéo et cohérence temporelle

Sora 2 a un avantage décisif sur la durée de la vidéo, prenant en charge des générations de 5 à 25 secondes selon le niveau d'accès. La capacité de 25 secondes de la version Pro représente une augmentation de 4 fois par rapport à la limite de 6 secondes du modèle Sora original, permettant des séquences narratives complètes sans assemblage de plusieurs segments. Cette durée étendue rend Sora 2 particulièrement précieux pour les applications de narration, les démonstrations de produits et tout contenu bénéficiant d'un développement narratif soutenu.

Seedance 2.0 génère des vidéos entre 4 et 15 secondes, se concentrant sur des clips plus courts à fort impact optimisés pour les médias sociaux, la publicité et les flux de travail à montage rapide. Bien que cette durée plus courte puisse sembler limitative, elle s'aligne parfaitement avec les formats de contenu dominants sur des plateformes comme TikTok, Instagram Reels et YouTube Shorts, où l'héritage de ByteDance transparaît à travers les priorités de conception de Seedance 2.0.

Le modèle étend les vidéos grâce à un système de continuation qui maintient la cohérence des personnages et des scènes sur plusieurs générations. Les tests indiquent que les 2-3 premières extensions préservent la qualité efficacement, mais une dégradation notable se produit autour de la quatrième extension, rendant cette approche plus adaptée aux prévisualisations brutes qu'à la livraison finale.

Simulation physique et réalisme du mouvement

Sora 2 établit la norme de l'industrie pour la précision physique et la compréhension de cause à effet. Le modèle démontre des capacités remarquables dans la simulation d'interactions physiques complexes : routines de gymnastique olympique avec une mécanique corporelle correcte, dynamique de l'eau modélisant correctement la flottabilité et le comportement des fluides, et mouvement des tissus respectant les propriétés des matériaux et les forces gravitationnelles. Cette approche centrée sur la physique crée des mouvements qui semblent ancrés dans la réalité plutôt que générés artificiellement.

Des tests indépendants confirment le leadership de Sora 2 dans cette dimension, les évaluateurs soulignant sa gestion supérieure de la permanence des objets, de la physique des collisions réaliste et des relations naturelles de cause à effet. Le modèle maintient une apparence cohérente des personnages et un état du monde sur des durées prolongées, une capacité critique pour le contenu narratif où les erreurs de continuité brisent l'immersion.

Seedance 2.0 adopte une approche différente, privilégiant la fluidité du mouvement et le comportement cinématographique de la caméra par rapport à une précision physique stricte. Le modèle excelle dans la production de mouvements de caméra de type film — travellings, zooms compensés, mouvements de grue — qui semblent exécutés professionnellement plutôt que générés mécaniquement. Pour le contenu où le style visuel et l'impact émotionnel importent plus que la précision physique, les caractéristiques de mouvement de Seedance 2.0 produisent souvent des résultats esthétiquement plus plaisants.

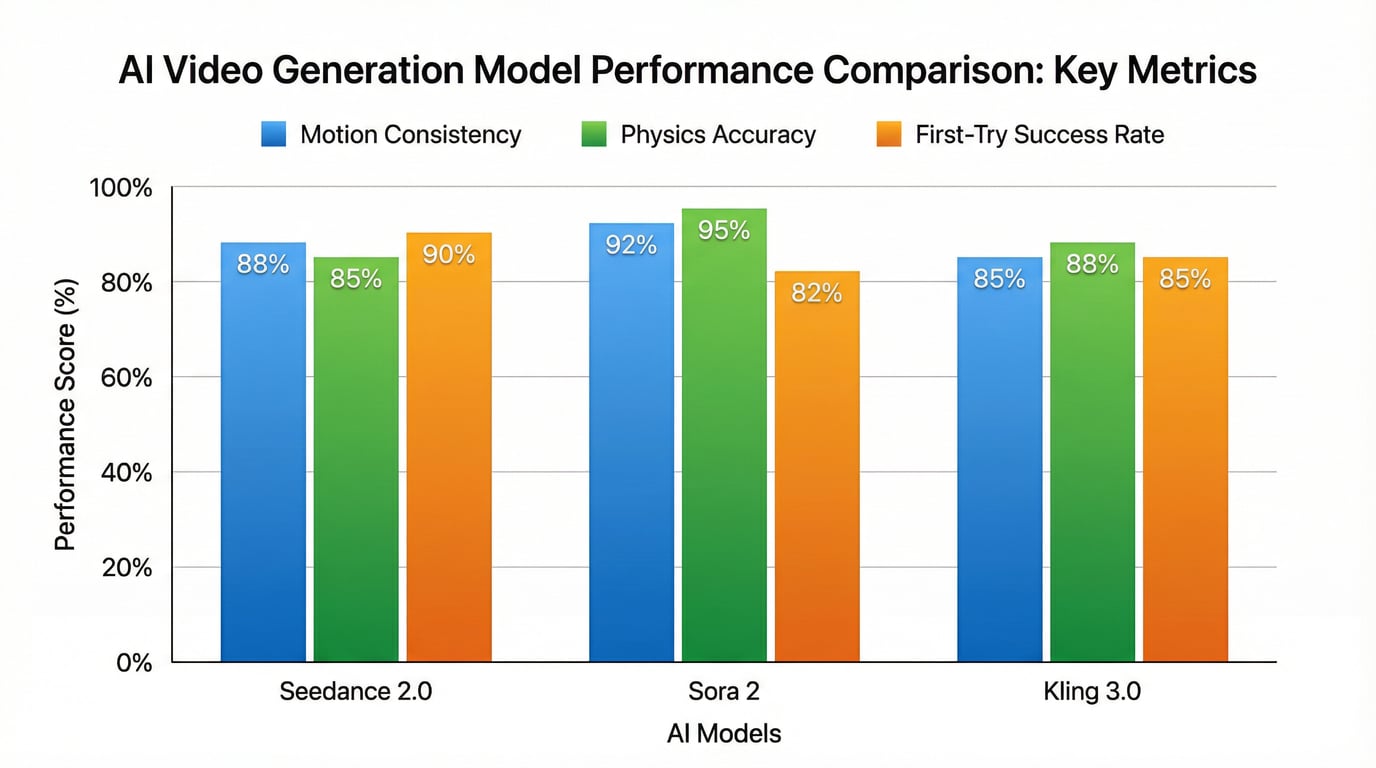

Les tests indiquent que Seedance 2.0 atteint environ 90% de résultats exploitables dès la première tentative de génération, réduisant considérablement le flux de travail d'essais et erreurs qui affectait les outils vidéo IA précédents. Ce taux de succès élevé transforme la génération vidéo d'une loterie imprévisible en un processus de production fiable.

L'avantage multimodal : La capacité unique de Seedance 2

Le différenciateur le plus significatif entre ces modèles réside dans la flexibilité d'entrée. Le système de référence quad-modal de Seedance 2.0 représente une refonte fondamentale de la façon dont les créateurs communiquent avec les modèles vidéo IA. Vous pouvez télécharger jusqu'à 12 fichiers de référence dans quatre catégories, puis utiliser le langage naturel pour spécifier comment le modèle doit combiner et appliquer ces références.

Cette capacité permet des flux de travail tout simplement impossibles avec des modèles texte-et-image uniquement. Si vous créez une vidéo de danse, vous téléchargez la piste audio pour une synchronisation parfaite du rythme, des images de référence pour l'apparence du personnage et un clip vidéo démontrant le style de chorégraphie souhaité. Le modèle synthétise ces entrées en une sortie cohérente qui respecte toutes vos spécifications simultanément.

La capacité de référence audio mérite une attention particulière, car elle est unique à Seedance 2.0 parmi les modèles leaders. Alors que Sora 2 génère un audio synchronisé en sortie, il ne peut pas accepter de l'audio comme référence d'entrée. Cela signifie que vous ne pouvez pas spécifier une atmosphère sonore particulière, une caractéristique vocale ou un rythme musical à suivre pour Sora 2. Le support d'entrée audio de Seedance 2.0 permet un contrôle précis sur la dimension sonore de vos vidéos, crucial pour les clips musicaux, le contenu de marque avec des identités audio spécifiques et toute application où la synchronisation audiovisuelle pilote le concept créatif.

Sora 2 ne prend actuellement en charge que les entrées texte et image, se concentrant sur la génération à la fois de la vidéo et de l'audio à partir de ces sources. Cette structure d'entrée plus simple rend Sora 2 plus direct à utiliser pour les créateurs qui préfèrent travailler principalement avec des descriptions écrites, mais sacrifie le contrôle granulaire qu'offrent les références multimodales.

Génération audio native : Les deux modèles assurent

Tant Seedance 2.0 que Sora 2 génèrent nativement de l'audio synchronisé, éliminant le besoin de flux de travail de production audio séparés. Cette capacité partagée représente une avancée majeure par rapport aux modèles vidéo IA précédents qui produisaient des sorties muettes nécessitant une conception sonore manuelle.

Seedance 2.0 utilise une architecture Dual-Branch Diffusion Transformer avec des chemins de traitement séparés pour la vidéo et l'audio. Cette conception assure une synchronisation étroite entre les événements visuels et leurs sons correspondants — des pas correspondant aux frappes de pieds, des claquements de porte alignés avec les impacts visuels et des paysages sonores ambiants évoluant naturellement avec les changements de scène. Le système de génération audio crée des dialogues, des sons environnementaux et des effets sonores qui semblent intégrés aux visuels plutôt que superposés artificiellement.

Sora 2 génère également des dialogues et des effets sonores synchronisés avec un haut degré de réalisme. Le modèle peut créer des toiles de fond sonores sophistiquées, des discours avec une prosodie naturelle et des effets sonores répondant de manière appropriée à l'action à l'écran. Les tests suggèrent que la qualité audio de Sora 2 rivalise ou dépasse celle de Seedance 2.0 en termes de fidélité et de réalisme, bien que le manque de références d'entrée audio signifie que vous avez moins de contrôle direct sur les caractéristiques sonores.

Capacités narratives multi-plans

Seedance 2.0 introduit un système de planification narratif qui décompose automatiquement les prompts complexes en séquences multi-plans. Les modèles vidéo IA précédents tentaient de faire tenir des histoires entières dans des prises continues uniques, entraînant une compression temporelle, un mouvement déformé ou des éléments de prompt ignorés lorsque la description dépassait la capacité du modèle. Le planificateur de Seedance 2.0 analyse votre prompt, identifie les points de coupure de scène naturels et génère une séquence de plans qui racontent l'histoire complète ensemble.

Cette capacité multi-plans produit des résultats qui ressemblent à des séquences montées plutôt qu'à des images brutes en prise unique. Le modèle maintient la cohérence des personnages, le style visuel et la continuité narrative à travers les limites des plans, résolvant l'un des problèmes les plus difficiles de la génération vidéo par IA. Pour les créateurs produisant du contenu narratif, des vidéos explicatives ou toute application nécessitant plusieurs perspectives ou changements de scène, cette fonctionnalité élargit considérablement ce qui est possible au sein d'une seule génération.

Sora 2 maintient une cohérence exceptionnelle sur ses durées de prise unique plus longues, mais gère les séquences multi-plans différemment. Le modèle excelle dans les scènes soutenues à perspective unique avec une action complexe, ce qui le rend idéal pour les moments narratifs continus bénéficiant d'un flux temporel ininterrompu. Pour les séquences multi-plans, les créateurs génèrent généralement des clips séparés et les montent ensemble manuellement, ce qui offre un contrôle plus précis sur les transitions mais nécessite un travail de production supplémentaire.

Tests de performance : Résultats du monde réel

Des tests indépendants à travers plusieurs cadres d'évaluation fournissent des données comparatives quantitatives. Dans les évaluations VBench — une référence faisant autorité pour la qualité de génération vidéo — l'écart de performance entre Open-Sora 2.0 (une implémentation open source approchant les capacités commerciales de Sora) et le Sora d'OpenAI s'est réduit à seulement 0,69%, indiquant que les modèles de la génération actuelle ont atteint une quasi-parité dans les métriques de qualité mesurables.

Les tests communautaires révèlent des profils de performance distincts. Seedance 2.0 démontre une cohérence de mouvement et une dynamique de caméra supérieures, avec des objets et des mouvements de caméra qui semblent naturels et exécutés professionnellement. Le taux de succès de plus de 90% au premier essai surpasse considérablement les outils précédents qui nécessitaient plusieurs tentatives de génération pour produire des résultats exploitables.

Sora 2 mène en précision de simulation physique et en cohérence temporelle, en particulier dans les scènes impliquant des interactions physiques complexes, plusieurs personnages ou des séquences narratives étendues. La compréhension du modèle des relations de cause à effet et de la permanence des objets produit des vidéos où le monde se comporte de manière prévisible et cohérente sur l'ensemble du clip.

Pour la narration cinématographique nécessitant des mouvements fluides et un travail de caméra sophistiqué, Seedance 2.0 montre des avantages clairs dans les tests. Pour les scènes techniquement exigeantes avec une action rapide, une physique complexe ou des durées plus longues, Sora 2 fournit actuellement des résultats plus stables.

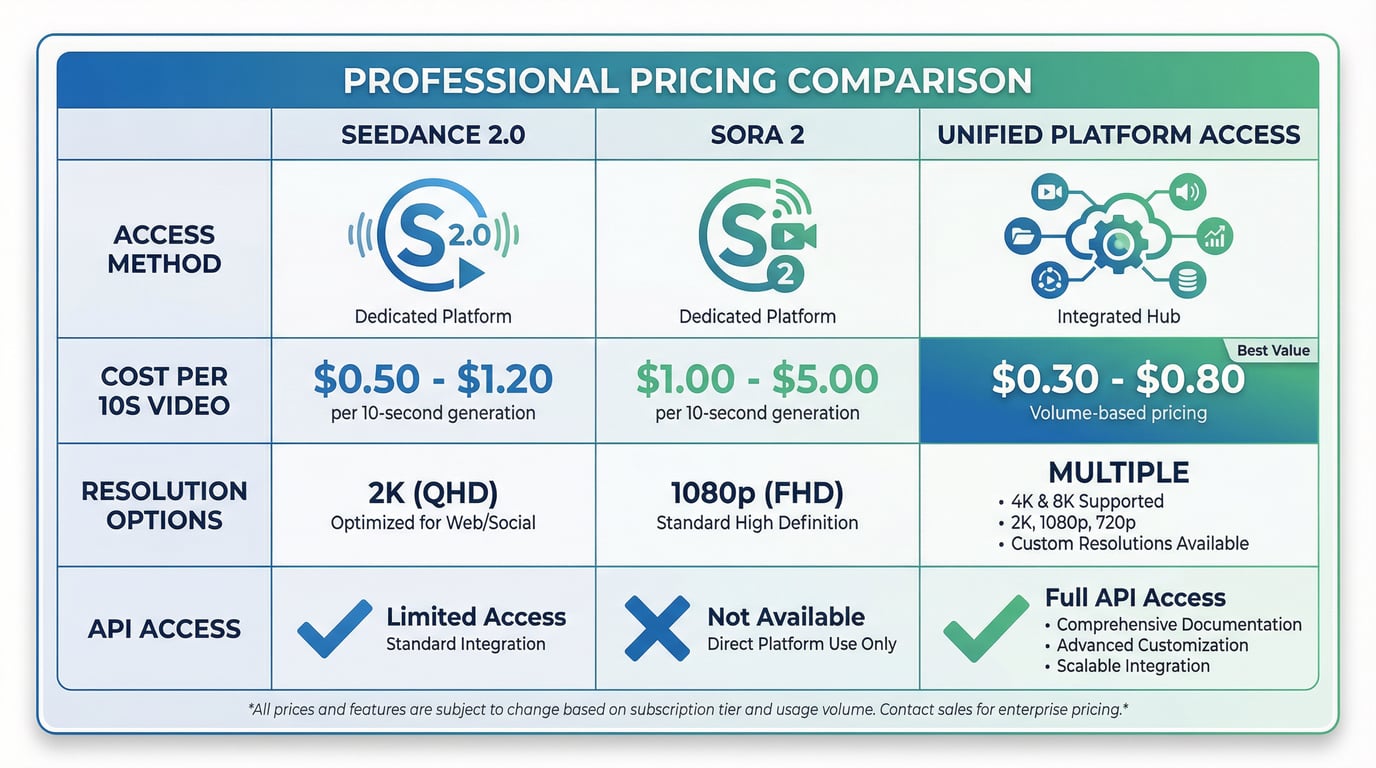

Tarification et accessibilité : Le facteur coût

Les structures tarifaires diffèrent considérablement entre ces modèles, reflétant différentes stratégies commerciales et marchés cibles.

Sora 2 fonctionne sur un modèle de facturation à la seconde via l'API d'OpenAI, facturant 0,10 $ à 0,50 $ par seconde selon la résolution et le niveau. Une vidéo typique de 10 secondes en résolution standard coûte environ 1,00 $, tandis que les générations de niveau Pro en qualité maximale peuvent atteindre 5,00 $ pour la même durée. OpenAI propose également un accès par abonnement via ChatGPT Plus (20 $/mois) et ChatGPT Pro (200 $/mois), qui fournissent une génération basée sur des crédits avec des limites quotidiennes.

Le modèle d'abonnement offre une meilleure valeur pour les utilisateurs à volume élevé qui peuvent maximiser leurs allocations de crédits quotidiennes. ChatGPT Plus fournit environ 30 crédits par jour, ce qui se traduit par environ 15-30 vidéos selon les paramètres de durée et de résolution. ChatGPT Pro offre plus de 100 crédits par jour, prenant en charge les flux de travail de production professionnelle avec des exigences de volume plus élevées.

La tarification de Seedance 2.0 varie selon la méthode d'accès. Le modèle est actuellement disponible principalement via la plateforme Jimeng (Dreamina) de ByteDance, l'accès API devant être lancé via Volcengine le 24 février 2026. Des fournisseurs tiers offrent un accès à Seedance 2.0 à des coûts allant de 0,50 $ à 1,20 $ par vidéo de 10 secondes, généralement inférieurs aux prix officiels de Sora 2 mais supérieurs à certains revendeurs tiers de Sora 2.

L'équation des coûts s'étend au-delà du prix par vidéo pour inclure le facteur de taux de succès. Le taux de succès de 90% au premier essai de Seedance 2.0 signifie que vous obtenez généralement des résultats exploitables sans plusieurs tentatives, réduisant efficacement votre coût réel par vidéo exploitable. Les modèles avec des taux de succès inférieurs nécessitent des allocations budgétaires pour les tentatives et le filtrage de qualité, doublant potentiellement vos coûts effectifs même si le prix nominal par vidéo semble inférieur.

Accès via des plateformes unifiées

Au lieu de gérer des comptes et des API séparés pour chaque modèle, de nombreux créateurs accèdent à Seedance 2.0 et Sora 2 via des plateformes unifiées qui agrègent plusieurs modèles vidéo IA. Ces plateformes offrent plusieurs avantages : facturation unique pour tous les modèles, conception d'interface cohérente réduisant les courbes d'apprentissage, et possibilité de tester différents modèles avec le même prompt pour une comparaison directe de la qualité.

Try Seedance 2 offre un accès simplifié à Seedance 2.0 aux côtés d'autres modèles de génération vidéo et d'image de premier plan. La plateforme élimine la complexité de la gestion de plusieurs clés API, de la navigation dans différentes structures tarifaires et de l'apprentissage d'interfaces séparées pour chaque modèle. Vous pouvez générer des vidéos en utilisant Seedance 2.0, Sora 2 et d'autres modèles à partir d'un seul tableau de bord et comparer directement les résultats pour déterminer quel modèle est le mieux adapté à chaque cas d'utilisation spécifique.

Cette approche unifiée s'avère particulièrement précieuse pour les flux de travail de production où différents projets nécessitent différentes forces de modèle. Le contenu des médias sociaux pourrait bénéficier du contrôle multimodal et du taux de succès élevé de Seedance 2.0, tandis que les séquences narratives pourraient tirer parti de la durée étendue et de la précision physique de Sora 2. Avoir les deux modèles accessibles via une seule plateforme vous permet d'adapter les capacités du modèle aux exigences du projet sans changer de service.

Recommandations de cas d'utilisation : Quel modèle pour quoi

Choisissez Seedance 2.0 si :

Vous avez besoin d'un contrôle créatif maximal via des références. Si vous souhaitez reproduire des styles visuels spécifiques, des modèles de mouvement, des atmosphères audio ou des mouvements de caméra, le système multimodal de Seedance 2.0 offre une précision inégalée. Téléchargez des exemples de ce que vous voulez, décrivez comment les combiner, et le modèle exécute votre vision avec un minimum d'ingénierie de prompts.

Vous produisez du contenu pour les médias sociaux en grand volume. La plage de durée de 4-15 secondes s'aligne parfaitement avec les formats de TikTok, Instagram Reels et YouTube Shorts. Le taux de succès de 90% au premier essai permet des flux de travail de production fiables où vous avez besoin de résultats cohérents sans itération extensive. La résolution native 2K garantit que votre contenu est net sur tous les appareils.

Vous avez besoin d'une synchronisation audiovisuelle avec des caractéristiques audio spécifiques. Les clips musicaux, le contenu de danse, les vidéos de marque avec des sons distinctifs et toute application où l'audio pilote le concept créatif bénéficient de l'entrée de référence audio de Seedance 2.0. Vous pouvez spécifier des modèles de rythme exacts, des qualités vocales ou des atmosphères sonores que le modèle doit faire correspondre dans sa sortie.

Vous avez besoin d'une résolution maximale pour l'affichage ou l'impression. La sortie native 2K offre des détails supérieurs pour les grands écrans, la publicité haute définition, l'affichage numérique et tout contexte où la fidélité visuelle impacte directement la qualité perçue.

Vous privilégiez le travail de caméra cinématographique et l'esthétique du mouvement. Pour le contenu où le style visuel, les mouvements de caméra fluides et les caractéristiques de mouvement de type film importent plus que la précision physique stricte, le profil de mouvement de Seedance 2.0 produit des résultats esthétiquement plus plaisants.

Choisissez Sora 2 si :

Vous avez besoin d'une durée étendue pour des séquences narratives. La plage de 5-25 secondes (selon le niveau) permet des moments narratifs complets, des démonstrations de produits avec plusieurs fonctionnalités ou tout contenu bénéficiant d'un développement temporel soutenu sans nécessiter de montage multi-clips.

La précision physique et le réalisme sont critiques. Pour le contenu représentant des scénarios du monde réel où un mouvement irréaliste se démarquerait immédiatement — sports, interactions complexes, séquences de cause à effet — les capacités de simulation physique de Sora 2 offrent des résultats supérieurs.

Vous préférez des flux de travail simples texte-vers-vidéo. Si vous êtes à l'aise avec l'ingénierie de prompts et n'avez pas besoin de la complexité de la gestion de plusieurs fichiers de référence, la structure d'entrée plus simple de Sora 2 offre une expérience plus rationalisée. La forte compréhension sémantique du modèle produit d'excellents résultats à partir de descriptions textuelles bien formulées uniquement.

Vous avez besoin d'une cohérence temporelle maximale sur de longs clips. La capacité de Sora 2 à maintenir l'apparence des personnages, l'état du monde et la continuité narrative sur des générations de 20-25 secondes le rend idéal pour le contenu où les erreurs de cohérence sont immédiatement perceptibles et problématiques.

Vous produisez du contenu fantastique, abstrait ou surréaliste. L'interprétation créative des concepts abstraits par Sora 2 et sa capacité à générer des scénarios imaginatifs qui n'existent pas dans le monde réel le rendent particulièrement efficace pour le contenu vidéo artistique, expérimental ou conceptuel.

Limitations techniques et considérations

Les deux modèles ont des limitations qui affectent leur adéquation à des applications spécifiques.

La durée maximale plus courte de Seedance 2.0 nécessite des flux de travail multi-clips pour le contenu dépassant 15 secondes. Bien que le système d'extension maintienne une cohérence raisonnable pour 2-3 itérations, la dégradation de la qualité devient notable au-delà. Cette limitation rend Seedance 2.0 moins adapté aux séquences narratives en prise unique ou au contenu bénéficiant d'un flux temporel ininterrompu.

Le système de référence multimodal, bien que puissant, introduit de la complexité. Gérer plusieurs fichiers de référence, comprendre comment le modèle combine différents types d'entrées et apprendre des stratégies de référence efficaces nécessite plus d'investissement initial que les flux de travail simples texte-vers-vidéo. La limite de 12 fichiers peut sembler restrictive pour les projets complexes nécessitant de nombreuses références de style, de mouvement et audio.

Seedance 2.0 a actuellement une accessibilité limitée en dehors de l'écosystème de ByteDance, l'accès API n'étant devenu disponible que récemment via des plateformes sélectionnées. Cette disponibilité restreinte a ralenti l'adoption par rapport à des alternatives plus largement accessibles.

La résolution maximale de 1080p de Sora 2 est en retrait par rapport à la sortie 2K de Seedance 2.0, limitant potentiellement son adéquation aux applications nécessitant une fidélité visuelle maximale. Le prix par seconde plus élevé peut rendre Sora 2 significativement plus coûteux pour la production à fort volume, en particulier lors de la génération de clips plus longs dans des paramètres de qualité premium.

Les deux modèles produisent occasionnellement des artefacts, des déformations ou des incohérences nécessitant une régénération. Budgetez 1,5-2x votre volume de génération prévu pour tenir compte du filtrage de qualité et des tentatives. Les temps de génération varient généralement de 2 à 5 minutes par vidéo selon la durée, la résolution et la charge actuelle du serveur, rendant les applications en temps réel ou quasi-réel difficiles.

Le paysage concurrentiel plus large

Bien que Seedance 2.0 et Sora 2 dominent les discussions actuelles, ils existent au sein d'un paysage concurrentiel en évolution rapide. Veo 3.1 de Google offre une sortie prête pour la diffusion avec des fréquences d'images standard cinéma et de solides performances dans les tâches de génération simples. Gen-4 de Runway fournit les outils de développement les plus accessibles et un contrôle précis du mouvement via des interfaces basées sur des pinceaux. Kling 3.0 de Kuaishou offre une excellente valeur pour les flux de travail simples prompt-vers-vidéo, en particulier pour les sujets et environnements asiatiques.

Chaque modèle occupe une position distincte dans l'écosystème. Sora 2 reste le leader de marque pour la qualité cinématographique et la simulation physique, bien que son coût plus élevé et sa disponibilité limitée créent des opportunités pour des alternatives. Seedance 2.0 offre le système de contrôle le plus complet pour les créateurs qui savent exactement ce qu'ils veulent et peuvent fournir des matériaux de référence. Runway Gen-4 s'adresse aux développeurs et aux utilisateurs techniques qui privilégient la qualité API et la flexibilité d'intégration. Kling 3.0 fournit des résultats fiables à des prix compétitifs pour les utilisateurs n'ayant pas besoin de systèmes de référence avancés ou d'une précision physique maximale.

Le rythme rapide de développement signifie que le leader d'aujourd'hui dans n'importe quelle dimension spécifique peut être dépassé en quelques mois. Seedance 2.0 a été lancé en février 2026, Sora 2 a stabilisé son infrastructure fin 2025 et Runway Gen-4 a étendu ses capacités API début 2026 — le tout dans un laps de temps compressé qui suggère une itération rapide continue sur toutes les plateformes.

Développement futur et feuille de route

La trajectoire de la génération vidéo par IA pointe vers plusieurs tendances claires qui façonneront l'évolution des deux modèles.

La résolution continuera d'augmenter, la sortie 4K devenant la norme plutôt que l'exception. Seedance 2.0 prend déjà en charge jusqu'à 2160p (4K) selon le niveau d'API et les limites de débit, suggérant que la sortie ultra-haute définition sera largement accessible dans la prochaine génération de modèles.

Les limites de durée s'étendront davantage, permettant des séquences narratives complètes au sein de générations individuelles. Le maximum actuel de 25 secondes représente une augmentation de 4 fois par rapport aux modèles précédents, et cette tendance se poursuivra probablement jusqu'à ce que des générations continues de plusieurs minutes soient réalisables sans perte de qualité.

Les capacités multimodales proliféreront sur tous les modèles. Le système de référence quad-modal de Seedance 2.0 démontre des avantages clairs en matière de contrôle créatif, suggérant que les concurrents adopteront une flexibilité d'entrée similaire. La capacité de communiquer l'intention créative via plusieurs canaux simultanément représente une amélioration fondamentale par rapport aux interfaces texte uniquement.

Les simulations physiques s'amélioreront globalement, réduisant l'écart actuel entre la précision de premier plan de Sora 2 et les capacités des concurrents. À mesure que les ensembles de données d'entraînement augmentent et que les architectures de modèles évoluent, le mouvement réaliste et les interactions physiques deviendront des enjeux de base plutôt que des différenciateurs.

La génération en temps réel ou quasi-réel émergera à mesure que l'infrastructure évoluera et que l'efficacité des modèles s'améliorera. Les temps de génération actuels de 2-5 minutes limitent certaines applications ; réduire cela à quelques secondes débloquerait des cas d'utilisation entièrement nouveaux dans la production en direct, le contenu interactif et les outils créatifs en temps réel.

Prendre la décision : Un cadre

Choisir entre Seedance 2.0 et Sora 2 nécessite de faire correspondre les capacités du modèle à vos exigences spécifiques sur plusieurs dimensions.

Évaluez vos besoins de contrôle. Si vous avez des matériaux de référence spécifiques et avez besoin d'un contrôle précis sur le style visuel, les caractéristiques de mouvement et l'atmosphère audio, le système multimodal de Seedance 2.0 offre des capacités que Sora 2 ne peut égaler. Si vous préférez des flux de travail plus simples et êtes satisfait des résultats pilotés par des prompts textuels uniquement, l'approche rationalisée de Sora 2 peut être plus efficace.

Considérez vos besoins de durée. Pour le contenu de moins de 15 secondes, les deux modèles fonctionnent efficacement. Pour les séquences de 15-25 secondes, Sora 2 est votre seule option entre ces deux. Pour le contenu dépassant 25 secondes, les deux modèles nécessitent des flux de travail multi-clips avec montage manuel.

Jaugez vos exigences de précision physique. Si votre contenu représente des scénarios du monde réel où un mouvement irréaliste se démarquerait immédiatement — sports, interactions complexes, séquences de cause à effet — la simulation physique supérieure de Sora 2 justifie le coût plus élevé. Si le style visuel et l'impact esthétique importent plus que la précision physique, les caractéristiques de mouvement de Seedance 2.0 produisent souvent des résultats plus plaisants.

Calculez vos coûts réels. Tenez compte des taux de succès, pas seulement des prix nominaux par vidéo. Un modèle avec un taux de succès de 90% à 1,00 $ par vidéo coûte effectivement 1,11 $ par vidéo exploitable. Un modèle avec un taux de succès de 60% à 0,80 $ par vidéo coûte 1,33 $ par vidéo exploitable après prise en compte des générations échouées. Le taux de succès plus élevé au premier essai de Seedance 2.0 le rend souvent plus rentable malgré des prix nominaux comparables.

Tenez compte de vos exigences de résolution. Pour le contenu destiné aux grands écrans, à la publicité haute définition ou aux applications où la fidélité visuelle maximale compte, la sortie 2K de Seedance 2.0 offre un avantage significatif. Pour les applications web standard et les médias sociaux, la sortie 1080p de Sora 2 reste totalement professionnelle.

Testez les deux modèles sur vos cas d'utilisation réels. Les comparaisons théoriques n'ont qu'une portée limitée. Générez des vidéos de test avec les deux modèles en utilisant des prompts représentatifs de vos projets réels. Évaluez les résultats par rapport à vos normes de qualité spécifiques, vos exigences de flux de travail et vos objectifs créatifs. Le modèle qui fonctionne le mieux sur votre contenu réel importe plus que le modèle qui gagne dans des benchmarks abstraits.

Conclusion : Outils complémentaires, pas rivaux directs

Seedance 2.0 et Sora 2 représentent des philosophies différentes sur la façon dont la génération vidéo par IA devrait fonctionner. Seedance 2.0 priorise le contrôle créatif via des références multimodales, permettant une spécification précise du style visuel, des caractéristiques de mouvement et de l'atmosphère audio par des exemples au lieu de descriptions. Sora 2 met l'accent sur la précision physique et la cohérence temporelle étendue, produisant des vidéos où le monde se comporte de manière réaliste sur des durées plus longues.

Ces approches distinctes rendent les modèles plus complémentaires que directement concurrents. Les flux de travail professionnels utilisent de plus en plus plusieurs modèles, sélectionnant l'outil qui correspond le mieux aux exigences de chaque projet spécifique. Le contenu des médias sociaux pourrait tirer parti du taux de succès élevé et du contrôle multimodal de Seedance 2.0. Les séquences narratives pourraient utiliser la durée étendue et la simulation physique de Sora 2. Les démonstrations de produits pourraient basculer entre les modèles selon que le contenu met l'accent sur le style visuel ou l'interaction réaliste avec le produit.

L'approche de plateforme unifiée — accéder aux deux modèles via des services comme Try Seedance 2 — reflète cette réalité. Au lieu de s'engager exclusivement dans l'écosystème d'un modèle, les créateurs bénéficient d'avoir les deux outils disponibles, choisissant le bon modèle pour chaque tâche spécifique en fonction des exigences réelles plutôt que de la fidélité à la plateforme.

Alors que la technologie de génération vidéo par IA continue d'évoluer rapidement, l'écart entre ces modèles se réduira dans certaines dimensions tandis que de nouveaux différenciateurs émergeront dans d'autres. Ce qui reste constant est le principe fondamental : alignez les capacités du modèle avec les besoins du projet, testez rigoureusement sur vos cas d'utilisation réels et restez suffisamment flexible pour adopter de nouveaux outils à mesure qu'ils prouvent leur valeur dans les flux de travail de production.

L'avenir de la génération vidéo par IA ne réside pas dans la recherche du seul meilleur modèle, mais dans la construction d'une boîte à outils de capacités complémentaires qui, ensemble, permettent des visions créatives impossibles il y a seulement quelques mois. Tant Seedance 2.0 que Sora 2 méritent leur place dans cette boîte à outils, chacun excellant dans les dimensions qui importent le plus pour différents types de contenu.

Points clés

| Dimension | Seedance 2.0 | Sora 2 |

|---|---|---|

| Résolution | 2K (2048×1152) | 1080p |

| Durée | 4-15 secondes | 5-25 secondes |

| Types d'entrée | Texte, Image, Vidéo, Audio | Texte, Image |

| Rapports d'aspect | 6 options | 3 options |

| Précision physique | Bonne | Excellente |

| Esthétique du mouvement | Excellente | Bonne |

| Succès au 1er essai | ~90% | ~82% |

| Meilleur pour | Médias sociaux, contrôle multimodal, Sortie Haute-Rés | Séquences narratives, simulation physique, durée étendue |

| Fourchette de prix | 0,50 $-1,20 $ par vidéo de 10s | 1,00 $-5,00 $ par vidéo de 10s |

Prêt à expérimenter les deux modèles ? Try Seedance 2 offre un accès pratique à Seedance 2.0, Sora 2 et d'autres modèles de génération vidéo et d'image IA de premier plan via une seule plateforme unifiée — éliminant la complexité de la gestion de plusieurs services tout en vous donnant la flexibilité de choisir le bon outil pour chaque projet.