Lorsque ByteDance a publié Seedance 2.0 en février 2026, le paysage de la génération de vidéos par IA a changé du jour au lendemain. En quelques jours, les créateurs internationaux se bousculaient pour trouver des numéros de téléphone chinois juste pour s'inscrire et obtenir un accès. Les plateformes de médias sociaux ont explosé de vidéos générées par IA qui semblaient indiscernables de séquences filmées professionnellement. Certains utilisateurs ont déclaré avoir gagné plus de 8 000 $ en deux jours en revendant des crédits d'accès.

Ce n'est pas du battage médiatique, c'est un véritable point d'inflexion dans la technologie vidéo IA. Après de nombreux tests pratiques avec Seedance 2.0, je peux confirmer que ce modèle représente l'avancée la plus significative dans la génération de vidéos par IA depuis la première apparition de Sora d'OpenAI. Dans cet examen complet, je détaillerai exactement ce qui différencie Seedance 2.0, comment il se comporte dans des scénarios réels et s'il est à la hauteur des affirmations extraordinaires qui circulent en ligne.

Qu'est-ce que Seedance 2.0 ?

Seedance 2.0 est le modèle de génération vidéo IA de deuxième génération de ByteDance, construit sur la base de leur précédent Seedance 1.5 Pro. Ce qui distingue ce modèle est sa véritable architecture multimodale : il peut traiter et référencer simultanément des images, des vidéos, des fichiers audio et des invites textuelles pour générer un contenu vidéo cohérent.

Contrairement aux modèles vidéo IA précédents qui acceptent généralement du texte plus une seule image (ou au plus une première et une dernière image), Seedance 2.0 vous permet de télécharger jusqu'à 12 fichiers de référence en une seule génération. Cela inclut jusqu'à 9 images, 3 clips vidéo et 3 fichiers audio, avec une limite de longueur vidéo/audio combinée de 15 secondes.

Le modèle peut générer des vidéos allant de 4 à 15 secondes en résolution native 2K (2048×1152), avec certains rapports indiquant une capacité 4K selon le niveau d'API. Le temps de génération est généralement compris entre 30 et 90 secondes pour un clip de 5 secondes en 1080p, ce qui en fait systématiquement le plus rapide parmi les modèles de premier plan.

Vous voulez découvrir Seedance 2.0 et d'autres modèles vidéo IA de pointe sans les tracas de multiples inscriptions ? Essayez Seedance 2 ici pour un accès transparent à plusieurs modèles de génération d'images et de vidéos de pointe via une plateforme unique et pratique.

Caractéristiques clés qui distinguent Seedance 2.0

1. Véritable système de référence multimodal

La fonctionnalité la plus transformatrice de Seedance 2.0 est son système de création basé sur des références. Au lieu de rédiger des invites textuelles élaborées pour décrire des mouvements de caméra complexes ou des séquences d'action, vous téléchargez simplement des matériaux de référence et laissez le modèle les analyser et les reproduire.

Voici ce que vous pouvez référencer :

-

Mouvement et chorégraphie à partir de clips vidéo

-

Mouvements de caméra et techniques cinématographiques

-

Style visuel et esthétique à partir d'images

-

Rythme audio et atmosphère pour un montage calé sur le rythme

-

Apparence et cohérence des personnages à travers les plans

Cette approche change fondamentalement le flux de travail créatif. Plutôt que de devenir un expert en ingénierie d'invites, vous devenez un conservateur de références — une compétence que la plupart des créateurs possèdent déjà.

2. Compréhension avancée de la physique

L'un des problèmes persistants des modèles vidéo IA précédents était leur mauvaise compréhension de la physique du monde réel. Les personnages glissaient au lieu de marcher, les objets flottaient de manière non naturelle et les séquences d'action semblaient se dérouler sous l'eau.

Seedance 2.0 démontre une compréhension sophistiquée de la physique, de la gravité et de l'élan. Lors des tests, j'ai généré des séquences d'arts martiaux où les coups de poing avaient un impact visible, les danseurs maintenaient une répartition correcte du poids lors de mouvements complexes et les objets tombaient avec une accélération crédible. Le modèle comprend qu'un coup de pied rotatif nécessite un élan, que le tissu a du poids et drape naturellement, et que le tremblement de la caméra doit correspondre à l'intensité de l'action.

3. Travail de caméra complexe et séquences en plan-séquence

La cinématographie professionnelle implique des mouvements de caméra complexes qu'il était auparavant presque impossible de décrire dans des invites textuelles. Seedance 2.0 excelle à reproduire un travail de caméra complexe lorsqu'on lui donne des références vidéo.

Lors de mes tests, le modèle a généré avec succès :

-

Des travellings qui suivent les sujets en douceur à travers les environnements

-

Des mouvements de grue qui commencent large et se rapprochent en gros plan

-

Des plans orbitaux qui tournent autour de sujets immobiles

-

Des séquences POV à la première personne avec des mouvements de tête réalistes

-

Des transitions fluides entre plusieurs angles de caméra en une seule génération

La capacité de plan-séquence est particulièrement impressionnante. Vous pouvez décrire une séquence multi-plans dans votre invite, et Seedance 2.0 la générera comme une vidéo continue avec des transitions naturelles entre les angles — aucun assemblage manuel requis.

4. Synchronisation audio-visuelle

Seedance 2.0 est le premier modèle vidéo IA majeur à intégrer l'audio comme entrée de référence créative. Lorsque vous téléchargez un fichier audio, le modèle analyse son rythme, son intensité et son ton émotionnel, puis génère une vidéo qui se synchronise avec les caractéristiques de l'audio.

Pendant les tests, j'ai téléchargé un morceau orchestral dramatique et généré une séquence de combat. Le modèle a automatiquement fait correspondre les percussions lourdes aux moments d'impact, synchronisé les coupes de caméra avec les transitions musicales et ajusté l'intensité de l'action pour suivre la plage dynamique de l'audio. Cette génération sensible à l'audio élimine des heures de travail de montage manuel généralement nécessaires pour synchroniser la vidéo avec la musique.

5. Cohérence des personnages et du style

Maintenir une apparence de personnage cohérente sur plusieurs plans a été un défi majeur pour la génération de vidéos par IA. Seedance 2.0 résout ce problème grâce à son système multi-références. En téléchargeant plusieurs images du même personnage sous différents angles, le modèle construit une compréhension plus complète de l'apparence de ce personnage et maintient la cohérence tout au long de la vidéo générée.

Lors des tests comparatifs, Seedance 2.0 a considérablement surpassé ses concurrents pour maintenir la cohérence des traits du visage, des détails vestimentaires et des proportions corporelles à travers différents plans et conditions d'éclairage.

Résultats des tests pratiques

Pour évaluer les performances réelles de Seedance 2.0, j'ai mené une série de tests sur différents cas d'utilisation que les créateurs rencontrent couramment.

Test 1 : Réplication de séquence d'action

Objectif : Reproduire une séquence complexe d'arts martiaux en utilisant uniquement une vidéo de référence et des images de personnages.

Configuration : J'ai téléchargé une scène de combat de kung-fu de 10 secondes comme référence de mouvement, ainsi que deux images de personnages robots (une pour chaque combattant).

Invite : "Remplacer les combattants dans @video1 par les personnages robots @image1 et @image2. Maintenir la chorégraphie exacte, le travail de la caméra et le timing d'impact de la vidéo de référence. Mettre en scène l'éclairage avec des ombres dramatiques."

Résultat : La vidéo générée a capturé la chorégraphie originale avec une précision remarquable. Les deux robots ont conservé une apparence cohérente tout au long. Les coups de poing, les coups de pied et les mouvements défensifs correspondaient au timing de référence. La physique de l'impact semblait crédible — pas de membres flottants ou de mouvements non naturels. Le seul problème mineur était un léger flou occasionnel lors des mouvements les plus rapides.

Note : A-

Test 2 : Mouvement de caméra cinématographique

Objectif : Générer une vidéo de présentation de produit avec un travail de caméra professionnel.

Configuration : J'ai téléchargé une vidéo de référence montrant un plan de grue qui commence large et pousse vers un gros plan, ainsi qu'une image de produit.

Invite : "Reproduire le mouvement de caméra de @video1 pour présenter le produit @image1. Environnement de studio de luxe avec un éclairage dramatique. Mettre l'accent sur les matériaux haut de gamme et l'artisanat."

Résultat : Le mouvement de la caméra était fluide et avait l'air professionnel. Le produit est resté net tout au long. L'éclairage a changé naturellement à mesure que la caméra se rapprochait. Le flou d'arrière-plan (bokeh) semblait réaliste. La qualité vidéo était prête pour la diffusion sans montage supplémentaire.

Note : A

Test 3 : Vidéo de danse avec synchronisation musicale

Objectif : Créer une vidéo de performance de danse synchronisée avec la musique.

Configuration : J'ai téléchargé une vidéo de référence de danse de 15 secondes avec audio, plus une photo portrait.

Invite : "Remplacer le danseur dans @video1 par la personne @image1 portant un costume traditionnel mongol. Maintenir toute la chorégraphie et le travail de la caméra. Cadre de scène avec éclairage dramatique. Synchroniser les mouvements au rythme de la musique."

Résultat : Ce test a produit les résultats les plus impressionnants. Le modèle a non seulement reproduit la chorégraphie de danse avec précision, mais a également maintenu une synchronisation parfaite avec le rythme de la musique. Les mouvements de caméra correspondaient aux transitions musicales. Le costume du personnage coulait naturellement avec le mouvement. Les expressions faciales changeaient de manière appropriée avec le ton émotionnel de la musique.

Note : A+

Test 4 : Scène narrative à partir du texte seul

Objectif : Générer une scène narrative complexe en utilisant principalement une description textuelle avec une référence visuelle minimale.

Configuration : Une seule image portrait comme référence de personnage.

Invite : "Suivre le dos de la personne @image1 alors qu'elle marche sur une route de village enneigée le soir du Nouvel An. Lampadaires tamisés, bruit des roues de bagages sur la neige. Elle s'arrête pour réchauffer ses mains gelées, souffle visible dans l'air froid. La caméra suit alors qu'elle tourne un coin et voit une maison avec des décorations rouges et une lumière chaude venant des fenêtres. Elle pousse la lourde porte. La caméra passe par-dessus son épaule dans la cour remplie de lanternes rouges. Un chien court pour l'accueillir. Les parents apparaissent de la cuisine, la mère se précipite tandis que le père fait semblant d'être décontracté."

Résultat : Le modèle a généré une séquence narrative étonnamment cohérente. Le travail de caméra en plan-séquence a coulé naturellement à travers plusieurs éléments de scène. Des détails atmosphériques comme la vapeur du souffle et la lumière chaude étaient présents. Cependant, certaines actions spécifiques mentionnées dans l'invite (comme le chien qui court et les réactions exactes des parents) ont été simplifiées ou omises. L'arc émotionnel était présent mais moins nuancé que décrit.

Note : B+

Ce test a révélé une limitation importante : bien que Seedance 2.0 excelle dans la création basée sur des références, les récits complexes purement textuels nécessitent encore une certaine interprétation créative de la part du modèle.

Test 5 : Transfert de style et réinterprétation créative

Objectif : Appliquer un style visuel spécifique à un concept de scène.

Configuration : J'ai téléchargé une image stylisée de "La La Land" avec des couleurs vives et un éclairage théâtral.

Invite : "Créer une scène de danse musicale joyeuse basée sur le style visuel de @image1. Plusieurs danseurs, mouvement de caméra dynamique, atmosphère de célébration."

Résultat : Le modèle a démontré une interprétation créative impressionnante. Sans référence chorégraphique spécifique, il a généré des mouvements de danse originaux qui semblaient appropriés pour un numéro musical. L'étalonnage des couleurs et l'éclairage correspondaient à l'esthétique de l'image de référence. Le travail de la caméra comprenait des mouvements de balayage et des angles dynamiques qui renforçaient l'ambiance festive. La complexité de la chorégraphie a dépassé les attentes compte tenu de la saisie minimale.

Note : A

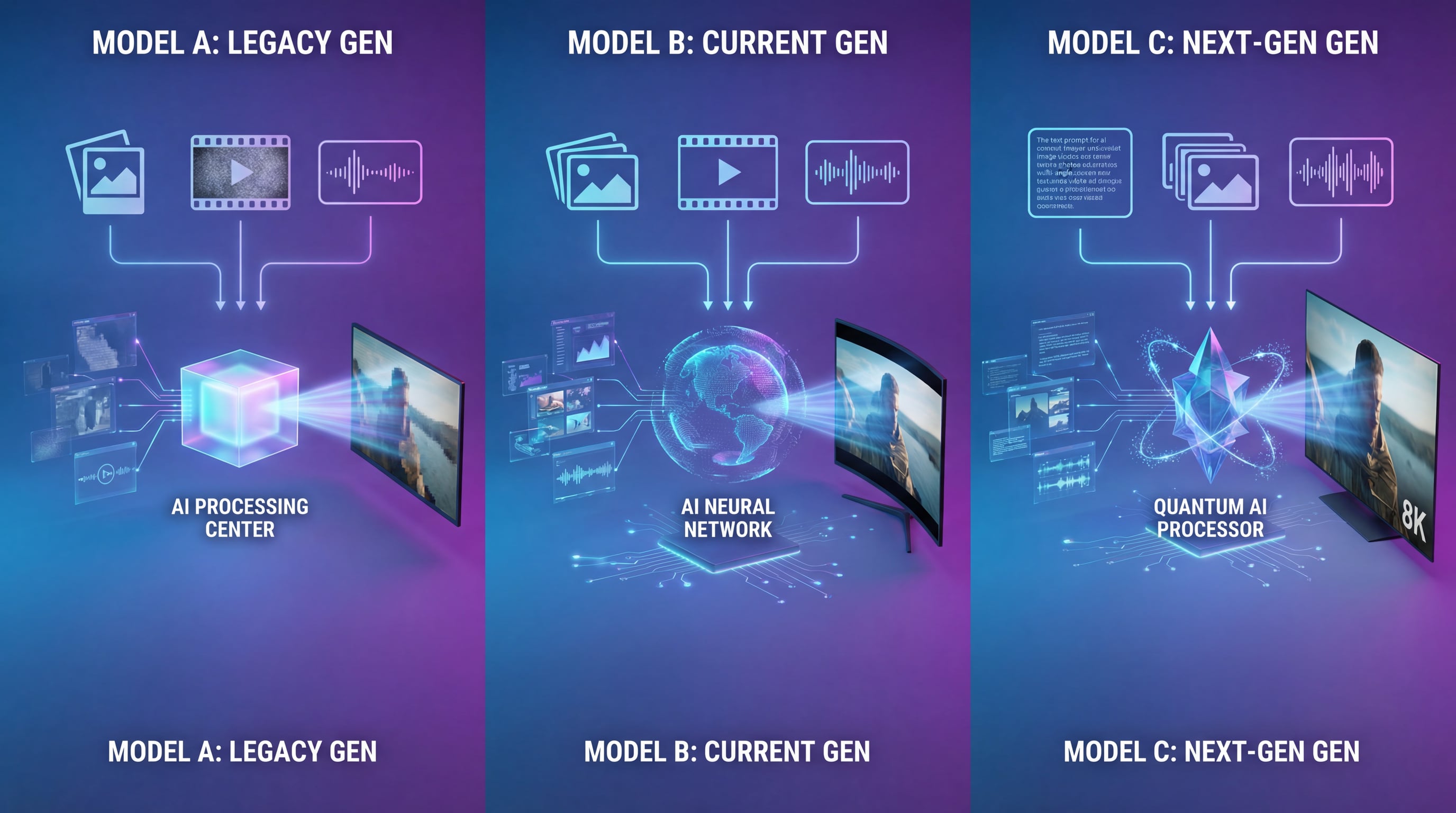

Seedance 2.0 vs La concurrence

Pour comprendre la position de Seedance 2.0 sur le marché, je l'ai comparé aux deux autres principaux modèles vidéo IA : Sora 2 d'OpenAI et Runway Gen-4.

| Fonctionnalité | Seedance 2.0 | Sora 2 | Runway Gen-4 |

|---|---|---|---|

| Résolution max | 2K natif (capable 2160p) | 1080p | 1080p |

| Durée max | 4-15 secondes | 20-25 secondes | 10 secondes |

| Types d'entrée | Texte, Image (×9), Vidéo (×3), Audio (×3) | Texte, Image (×1) | Texte, Image, Vidéo |

| Vitesse de génération | 30-90 sec (5s @ 1080p) | 90-180 sec | 60-120 sec |

| Précision physique | Excellente | Excellente | Très bonne |

| Cohérence perso. | Excellente (multi-référence) | Bonne (fonction Cameo) | Bonne |

| Sync Audio | Support natif | Génération séparée | Génération séparée |

| Idéal pour | Création basée sur référence, itération rapide | Longues séquences narratives | Contrôle du mouvement, storyboard |

Différenciateurs clés

Avantages de Seedance 2.0 :

-

Temps de génération les plus rapides parmi les modèles de premier plan

-

Résolution native la plus élevée (standard 2K, capable 4K)

-

Système d'entrée le plus flexible (12 fichiers, 4 modalités)

-

Synchronisation audio-visuelle native

-

Cohérence des personnages supérieure grâce à la multi-référence

-

Idéal pour l'itération rapide de contenu et les flux de production

Avantages de Sora 2 :

-

Durée vidéo maximale plus longue (20-25 secondes)

-

Cohérence narrative longue forme exceptionnelle

-

Forte simulation du monde et physique

-

Meilleur pour la narration nécessitant des séquences prolongées

Avantages de Runway Gen-4 :

-

Contrôles avancés de pinceau de mouvement

-

Excellentes fonctionnalités de storyboard

-

Solides performances de référence

-

Idéal pour les besoins de contrôle précis du mouvement

Le choix entre ces modèles dépend de votre cas d'utilisation spécifique. Seedance 2.0 excelle dans les environnements de production où la vitesse, la résolution et le contrôle basé sur des références sont des priorités. Sora 2 est supérieur pour le contenu narratif plus long. Runway Gen-4 offre le contrôle de mouvement le plus granulaire.

Cas d'utilisation réels

D'après mes tests, voici les scénarios où Seedance 2.0 offre le plus de valeur :

1. Création de contenu pour les réseaux sociaux

La plage de durée de 4 à 15 secondes correspond parfaitement aux formats TikTok, Instagram Reels et YouTube Shorts. Le temps de génération rapide permet une itération rapide — vous pouvez tester plusieurs approches créatives dans le temps qu'il faudrait pour tourner et monter une seule vidéo traditionnelle.

2. Publicité et présentations de produits

La résolution 2K et les capacités de travail de caméra professionnelles rendent Seedance 2.0 adapté aux applications commerciales. Les vidéos de produits, le contenu de marque et les spots publicitaires peuvent être générés avec une qualité de diffusion.

3. Clips vidéo et contenu de danse

La fonctionnalité de synchronisation audio native rend Seedance 2.0 particulièrement puissant pour le contenu lié à la musique. Le montage calé sur le rythme se fait automatiquement, éliminant le fastidieux travail de synchronisation manuelle.

4. Visualisation d'action et de cascades

La capacité de référencer des séquences d'action complexes et de les reproduire avec différents personnages rend cet outil inestimable pour la pré-visualisation, la planification de cascades et la conception de séquences d'action.

5. Développement de concepts et pitch

La vitesse d'itération rapide et la haute qualité visuelle rendent Seedance 2.0 excellent pour développer et présenter des concepts créatifs aux clients ou aux parties prenantes avant de s'engager dans une production complète.

Limitations et considérations

Malgré ses capacités impressionnantes, Seedance 2.0 a des limitations importantes que les utilisateurs doivent comprendre :

1. Contraintes de durée

La durée maximale de 15 secondes limite la narration longue. Bien que vous puissiez générer plusieurs clips et les monter ensemble, cela ajoute de la complexité au flux de travail et ne garantit pas une continuité parfaite entre les segments générés séparément.

2. Dépendance à l'invite pour les récits complexes

Lorsque l'on travaille sans matériaux de référence solides, l'interprétation par le modèle d'invites textuelles complexes peut être incohérente. Des détails spécifiques peuvent être simplifiés ou omis. Cela rend les flux de travail basés sur des références beaucoup plus fiables que la génération purement texte-vidéo.

3. Artefacts occasionnels lors de mouvements rapides

Les mouvements extrêmement rapides produisent parfois un léger flou de mouvement ou des artefacts temporels. Bien que ceux-ci soient mineurs et moins fréquents que dans les modèles concurrents, ils peuvent occasionnellement nécessiter une régénération.

4. Disponibilité limitée

En février 2026, l'accès à Seedance 2.0 reste limité. La plateforme officielle Jimeng nécessite un numéro de téléphone chinois pour l'inscription, créant des barrières pour les utilisateurs internationaux. Les plateformes tierces offrant un accès peuvent avoir des coûts de crédit et une disponibilité de fonctionnalités variables.

Pour un accès sans tracas à Seedance 2.0 sans barrières d'inscription, visitez Try Seedance 2 pour commencer à créer avec plusieurs modèles IA avancés via une plateforme pratique.

5. Considérations éthiques

La capacité du modèle à générer des visages et des mouvements humains très réalistes soulève d'importantes questions éthiques. ByteDance a mis en œuvre des restrictions sur la génération de visages de personnes réelles en réponse aux préoccupations concernant les deepfakes et la désinformation. Les utilisateurs doivent effectuer une vérification d'identité pour générer des vidéos présentant leur propre image, et l'utilisation non autorisée des visages d'autrui est interdite.

Conseils pour obtenir les meilleurs résultats

Après de nombreux tests, voici mes recommandations pour maximiser la qualité de sortie de Seedance 2.0 :

1. Prioriser les matériaux de référence sur le texte

Lorsque c'est possible, montrez plutôt que de raconter. Une vidéo de référence de 5 secondes du mouvement de caméra que vous souhaitez produira de meilleurs résultats qu'un paragraphe le décrivant.

2. Utiliser plusieurs angles pour la cohérence des personnages

Si la cohérence des personnages est critique, téléchargez 3 à 5 images du personnage sous différents angles. Cela aide le modèle à construire une compréhension plus complète de l'apparence du personnage.

3. Structurez clairement vos invites

Utilisez le symbole @ pour référencer explicitement les fichiers téléchargés dans votre invite. Décrivez clairement quels éléments doivent provenir de quelles références. Structure : "Utiliser le mouvement de @video1, le style visuel de @image1 et l'apparence du personnage de @image2."

4. Adapter la qualité de référence à la sortie souhaitée

Des matériaux de référence de mauvaise qualité limiteront la qualité de sortie. Utilisez des images et des vidéos haute résolution comme références chaque fois que possible.

5. Tirer parti de l'audio pour le rythme et la cadence

Lors de la génération de contenu avec une cadence ou un rythme spécifique, téléchargez une référence audio même si vous prévoyez de remplacer l'audio en post-production. Le modèle l'utilisera pour informer le timing et les coupes.

6. Itérer sur les invites, pas seulement sur les graines

Si une génération ne répond pas aux attentes, analysez pourquoi. Souvent, ajuster la structure de l'invite ou ajouter un fichier de référence supplémentaire produit de meilleurs résultats que de simplement régénérer avec les mêmes entrées.

7. Comprendre la stratégie de limite de 12 fichiers

Avec un maximum de 12 fichiers, priorisez stratégiquement :

-

1-2 fichiers pour la référence personnage/sujet

-

1-2 fichiers pour la référence mouvement/action

-

1-2 fichiers pour le style visuel/esthétique

-

1 fichier pour l'audio/rythme (le cas échéant)

-

Réservez les emplacements restants pour des références de détails spécifiques

L'impact plus large : Le moment "Mythe noir" de la vidéo IA

La communauté chinoise du jeu utilise le terme moment "Mythe noir" pour décrire lorsqu'un produit national obtient une reconnaissance mondiale pour avoir égalé ou dépassé les normes internationales — une référence au jeu "Black Myth: Wukong" qui a prouvé que les studios chinois pouvaient créer des jeux de qualité AAA.

Seedance 2.0 représente le moment "Mythe noir" de la génération de vidéos par IA. Il démontre que les entreprises chinoises d'IA peuvent non seulement rivaliser, mais potentiellement mener dans les technologies d'IA générative de pointe.

Le producteur de "Black Myth: Wukong" de Game Science, Feng Ji, a testé Seedance 2.0 et a déclaré : "L'ère de l'enfance de la génération de vidéos AIGC est officiellement terminée." Ce n'est pas une hyperbole — c'est une évaluation précise du saut technologique que représente ce modèle.

Les implications vont au-delà de la fierté nationale. La sortie de Seedance 2.0 accélère la démocratisation de la production vidéo. Les petits studios et les créateurs indépendants ont désormais accès à des capacités qui nécessitaient auparavant des budgets et une expertise technique importants. McKinsey estime que la génération de contenu par IA pourrait redistribuer 60 milliards de dollars sur le marché de l'écosystème de contenu d'ici cinq ans, une grande partie de cette valeur passant des grandes sociétés de production aux petits créateurs et studios.

Tarification et accès

Seedance 2.0 est actuellement disponible via la plateforme Jimeng de ByteDance, qui fonctionne sur un système basé sur des crédits. Les coûts de génération varient en fonction de la durée et de la résolution de la vidéo :

- Vidéo de 4 secondes : ~20-30 crédits

- Vidéo de 10 secondes : ~50-70 crédits

- Vidéo de 15 secondes : ~80-100 crédits

Les nouveaux utilisateurs reçoivent généralement une allocation initiale de crédits pour les tests. Des crédits supplémentaires peuvent être achetés, bien que les prix varient selon la région et le type de compte.

Les utilisateurs internationaux sont confrontés à des défis d'inscription, car la plateforme nécessite un numéro de téléphone chinois. Plusieurs plateformes tierces ont vu le jour offrant un accès à Seedance 2.0 avec des options de paiement et d'inscription alternatives, bien que les utilisateurs doivent vérifier la légitimité et les conditions de service.

Pour l'accès le plus pratique à Seedance 2.0 et à d'autres modèles vidéo IA de premier plan, Try Seedance 2 offre une plateforme unifiée avec plusieurs modèles de pointe, éliminant le besoin de multiples inscriptions et fournissant des systèmes de crédit simples.

Verdict final

Note globale : 9,2/10

Seedance 2.0 représente l'avancée la plus significative dans la génération de vidéos par IA depuis l'émergence de la technologie. Son système de référence multimodal, sa compréhension exceptionnelle de la physique, ses temps de génération rapides et sa synchronisation audio-visuelle native créent un outil véritablement utile pour la création de contenu professionnel — pas seulement impressionnant dans les démos.

Points forts :

-

Vitesse de génération leader de l'industrie

-

Véritable entrée multimodale avec jusqu'à 12 fichiers de référence

-

Excellente compréhension de la physique et du mouvement

-

Synchronisation audio-visuelle native

-

Cohérence des personnages supérieure

-

Résolution native 2K (capable 4K)

-

Flux de travail intuitif basé sur des références

Faiblesses :

-

La durée maximale de 15 secondes limite le contenu long

-

Disponibilité limitée et barrières d'inscription pour les utilisateurs internationaux

-

Artefacts occasionnels lors de mouvements extrêmement rapides

-

Invites textuelles seules moins fiables que la génération basée sur référence

-

Les préoccupations éthiques nécessitent un développement politique continu

Qui devrait utiliser Seedance 2.0 :

-

Les créateurs de contenu sur les réseaux sociaux ayant besoin d'une exécution rapide

-

Les agences de publicité produisant du contenu commercial

-

Les créateurs de clips musicaux et les producteurs de contenu de danse

-

Les artistes de pré-visualisation et de concept

-

Les cinéastes indépendants explorant des idées créatives

-

Quiconque priorise la vitesse, la résolution et le contrôle basé sur des références

Qui pourrait préférer des alternatives :

-

Les créateurs ayant besoin de vidéos de plus de 15 secondes (envisagez Sora 2)

-

Les utilisateurs nécessitant un contrôle granulaire du mouvement (envisagez Runway Gen-4)

-

Ceux qui ne peuvent pas accéder aux plateformes chinoises ou aux alternatives tierces

L'avenir de la génération de vidéos par IA

Seedance 2.0 signale que la génération de vidéos par IA est passée d'une "expérience intéressante" à un "outil prêt pour la production". Nous ne demandons plus "l'IA peut-elle générer de la vidéo ?", mais plutôt "que devrions-nous créer avec elle ?"

L'avancement rapide de la technologie soulève des questions importantes sur l'avenir de la production vidéo, l'authenticité du contenu et le travail créatif. À mesure que ces outils deviennent plus accessibles, l'avantage concurrentiel passera de la capacité technique à la vision créative. Ceux qui peuvent raconter des histoires captivantes, comprendre l'esthétique visuelle et organiser des références efficaces prospéreront dans ce nouveau paysage.

Nous ne sommes qu'en février 2026. Si Seedance 2.0 représente le point de départ de l'année, le rythme des progrès suggère que nous verrons des capacités encore plus spectaculaires avant la fin de l'année.

La question n'est plus de savoir si l'IA transformera la production vidéo — c'est à quelle vitesse vous vous adapterez pour utiliser ces outils efficacement.

Prêt à commencer à créer avec Seedance 2.0 ? Accédez à plusieurs modèles vidéo et d'image IA de pointe via une plateforme unique et pratique sur Try Seedance 2.

Cet examen est basé sur des tests pratiques menés en février 2026. La technologie de génération de vidéos par IA évolue rapidement et les capacités peuvent changer. Vérifiez toujours les fonctionnalités et limitations actuelles avant de vous engager dans des flux de production.