El panorama de la generación de video con IA ha alcanzado un momento crucial en 2026. Dos modelos dominan ahora la conversación: Seedance 2.0 de ByteDance y Sora 2 de OpenAI. Ambos representan avances significativos en la tecnología de síntesis de video, pero abordan los mismos desafíos creativos desde filosofías fundamentalmente diferentes. Esta comparativa exhaustiva examina cada dimensión importante —desde especificaciones técnicas y calidad de salida hasta estructuras de precios y casos de uso reales— para ayudarte a entender qué modelo ofrece las capacidades que realmente necesitas.

Qué Hace Diferente a Seedance 2

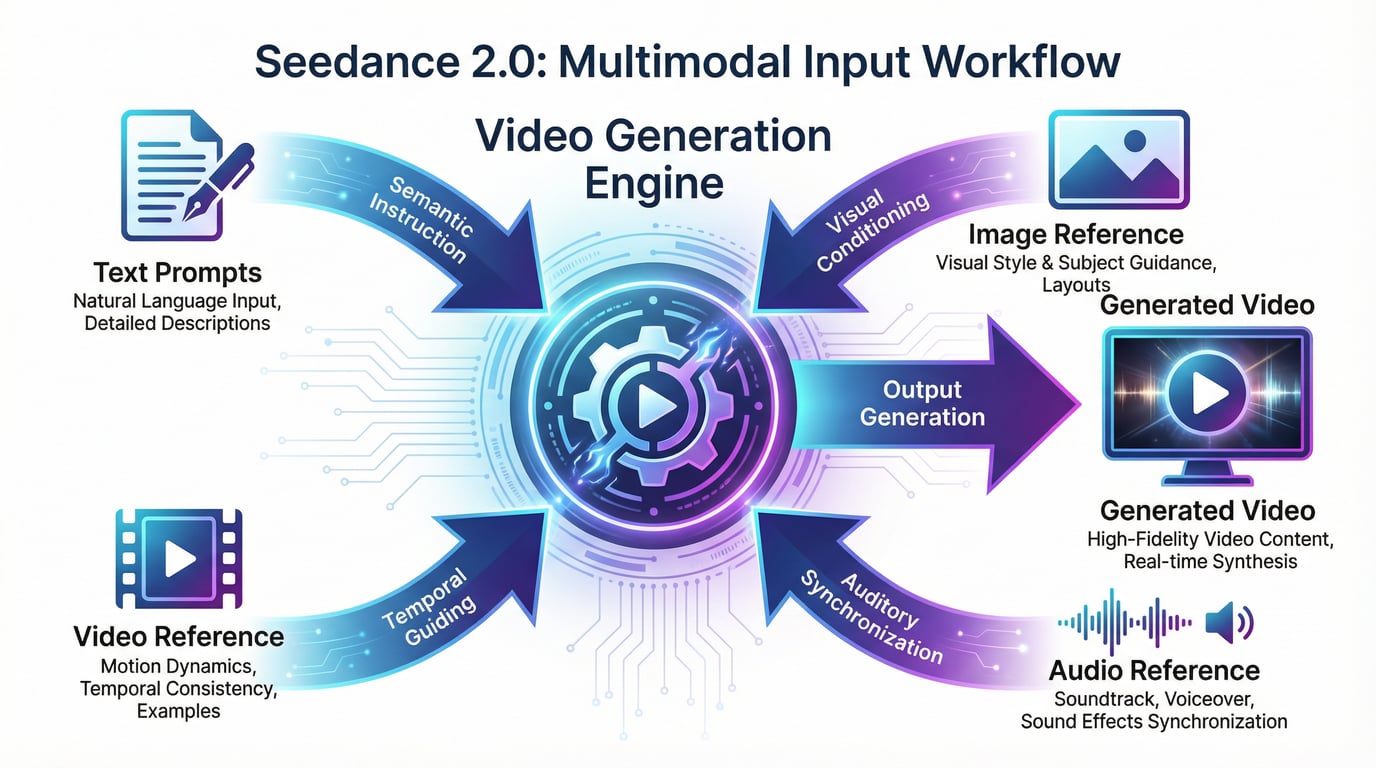

Seedance 2.0 introduce una arquitectura multimodal unificada que cambia fundamentalmente cómo los creadores interactúan con la generación de video por IA. A diferencia de los modelos tradicionales de texto a video que dependen principalmente de instrucciones escritas, Seedance 2.0 acepta cuatro tipos de entrada simultáneos: descripciones de texto, imágenes de referencia, videoclips y pistas de audio. Este sistema de referencia cuatrimodal te permite especificar exactamente lo que quieres mostrando ejemplos al modelo, en lugar de intentar describir todo con palabras.

Las implicaciones prácticas son significativas. Si necesitas un movimiento de cámara específico, subes un video de referencia demostrando ese movimiento exacto. Si quieres un estilo visual particular, proporcionas una imagen que capture esa estética. Si necesitas audio sincronizado con ritmos o compases específicos, suministras la pista de audio directamente. El modelo combina estas referencias de acuerdo con tus instrucciones en lenguaje natural, dándote un control a nivel de dirección sin requerir experiencia técnica en ingeniería de prompts.

Este enfoque multimodal resuelve uno de los problemas más persistentes en la generación de video con IA: la brecha entre la intención creativa y la salida real. Los modelos anteriores obligaban a los creadores a un ciclo frustrante de refinamiento de prompts, esperando dar con la combinación mágica de palabras que produjera el resultado deseado. Seedance 2.0 elimina gran parte de estas conjeturas permitiéndote comunicar a través de múltiples canales simultáneamente.

Especificaciones Técnicas: Dónde Brilla Cada Modelo

Resolución y Calidad de Salida

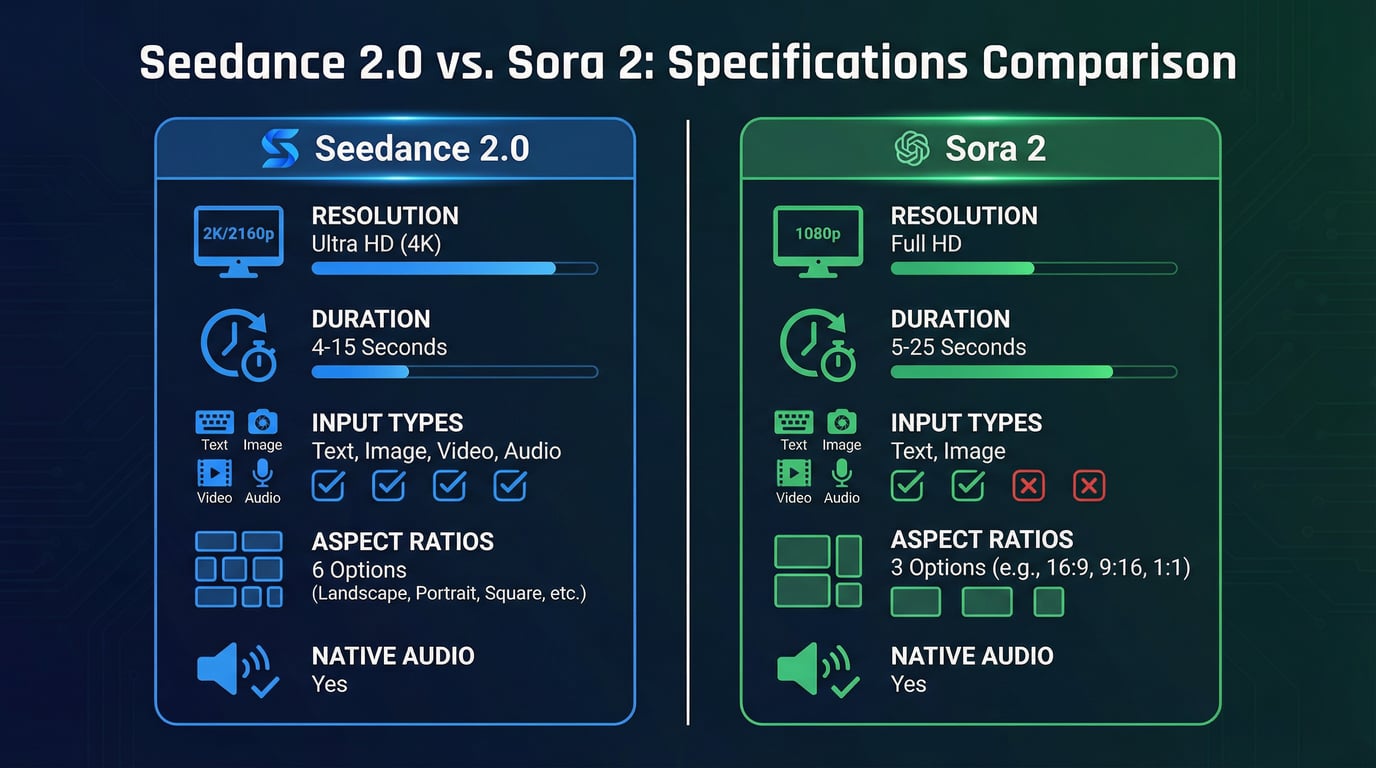

Seedance 2.0 ofrece una resolución nativa 2K a 2048×1152 píxeles, posicionándose como la opción de mayor resolución actualmente disponible en modelos de video con IA de producción. Esta ventaja de resolución es crítica para contenido destinado a pantallas grandes, campañas publicitarias de alta definición o cualquier aplicación donde la fidelidad visual impacte directamente en la calidad percibida. El modelo soporta seis relaciones de aspecto: 16:9, 9:16, 4:3, 3:4, 21:9 y 1:1, cubriendo prácticamente cualquier caso de uso común, desde videos de YouTube hasta Instagram Stories y formatos cinematográficos ultra anchos.

Sora 2 alcanza una resolución máxima de 1080p, que sigue siendo profesional para la mayoría de las aplicaciones pero se queda atrás de la fidelidad de salida de Seedance 2.0. Donde Sora 2 compensa esto es en su manejo excepcional de la iluminación, detalles de textura y gradación de color. El modelo demuestra una comprensión sofisticada de cómo se comporta la luz en espacios físicos, produciendo videos con una profundidad cinematográfica y riqueza visual que a veces supera a competidores de mayor resolución.

Duración del Video y Consistencia Temporal

Sora 2 tiene una ventaja decisiva en la duración del video, soportando generaciones de 5 a 25 segundos dependiendo del nivel de acceso. La capacidad de 25 segundos de la versión Pro representa un aumento de 4 veces sobre el límite de 6 segundos del modelo Sora original, permitiendo secuencias narrativas completas sin unir múltiples segmentos. Esta duración extendida hace que Sora 2 sea particularmente valioso para aplicaciones de narración, demostraciones de productos y cualquier contenido que se beneficie de un desarrollo narrativo sostenido.

Seedance 2.0 genera videos de entre 4 y 15 segundos, enfocándose en clips más cortos de alto impacto optimizados para redes sociales, publicidad y flujos de trabajo de edición rápida. Aunque esta duración más corta puede parecer limitante, se alinea perfectamente con los formatos de contenido dominantes en plataformas como TikTok, Instagram Reels y YouTube Shorts, donde el legado de ByteDance brilla a través de las prioridades de diseño de Seedance 2.0.

El modelo extiende videos a través de un sistema de continuación que mantiene la consistencia de personajes y escenas a través de múltiples generaciones. Las pruebas indican que las primeras 2-3 extensiones preservan la calidad de manera efectiva, pero ocurre una degradación notable alrededor de la cuarta extensión, haciendo este enfoque más adecuado para vistas previas aproximadas que para entregas finales.

Simulación Física y Realismo de Movimiento

Sora 2 establece el estándar de la industria para la precisión física y la comprensión de causa y efecto. El modelo demuestra capacidades notables en la simulación de interacciones físicas complejas: rutinas de gimnasia olímpica con mecánica corporal correcta, dinámica del agua que modela adecuadamente la flotabilidad y el comportamiento de fluidos, y movimiento de telas que respeta las propiedades del material y las fuerzas gravitacionales. Este enfoque centrado en la física crea movimientos que se sienten anclados en la realidad en lugar de generados artificialmente.

Pruebas independientes confirman el liderazgo de Sora 2 en esta dimensión, con evaluadores destacando su manejo superior de la permanencia de objetos, física de colisiones realista y relaciones naturales de causa y efecto. El modelo mantiene una apariencia consistente de personajes y estado del mundo durante duraciones extendidas, una capacidad crítica para contenido narrativo donde los errores de continuidad rompen la inmersión.

Seedance 2.0 adopta un enfoque diferente, priorizando la fluidez del movimiento y el comportamiento cinematográfico de la cámara sobre la precisión física estricta. El modelo sobresale en la producción de movimientos de cámara similares a películas —travellings, zoom dolly, movimientos de grúa— que se sienten ejecutados profesionalmente en lugar de generados mecánicamente. Para contenido donde el estilo visual y el impacto emocional importan más que la precisión física, las características de movimiento de Seedance 2.0 a menudo producen resultados estéticamente más agradables.

Las pruebas indican que Seedance 2.0 logra aproximadamente un 90% de salida utilizable en el primer intento de generación, reduciendo drásticamente el flujo de trabajo de prueba y error que plagaba a las herramientas de video con IA anteriores. Esta alta tasa de éxito transforma la generación de video de una lotería impredecible a un proceso de producción confiable.

La Ventaja Multimodal: La Capacidad Única de Seedance 2

El diferenciador más significativo entre estos modelos radica en la flexibilidad de entrada. El sistema de referencia cuatrimodal de Seedance 2.0 representa un replanteamiento fundamental de cómo los creadores se comunican con los modelos de video con IA. Puedes subir hasta 12 archivos de referencia en cuatro categorías, y luego usar lenguaje natural para especificar cómo el modelo debe combinar y aplicar esas referencias.

Esta capacidad permite flujos de trabajo que son simplemente imposibles con modelos de solo texto e imagen. Si estás creando un video de baile, subes la pista de audio para una sincronización perfecta del ritmo, imágenes de referencia para la apariencia del personaje y un videoclip demostrando el estilo de coreografía deseado. El modelo sintetiza estas entradas en una salida coherente que respeta todas tus especificaciones simultáneamente.

La capacidad de referencia de audio merece atención especial, ya que es única en Seedance 2.0 entre los modelos líderes. Mientras que Sora 2 genera audio sincronizado como salida, no puede aceptar audio como referencia de entrada. Esto significa que no puedes especificar una atmósfera sonora particular, característica vocal o ritmo musical para que Sora 2 lo siga. El soporte de entrada de audio de Seedance 2.0 permite un control preciso sobre la dimensión sónica de tus videos, crucial para videos musicales, contenido de marca con identidades de audio específicas y cualquier aplicación donde la sincronización audiovisual impulse el concepto creativo.

Sora 2 actualmente soporta solo entradas de texto e imagen, enfocándose en generar tanto video como audio a partir de esas fuentes. Esta estructura de entrada más simple hace que Sora 2 sea más sencillo de usar para creadores que prefieren trabajar principalmente con descripciones escritas, pero sacrifica el control granular que ofrecen las referencias multimodales.

Generación Nativa de Audio: Ambos Modelos Cumplen

Tanto Seedance 2.0 como Sora 2 generan audio sincronizado de forma nativa, eliminando la necesidad de flujos de trabajo separados de producción de audio. Esta capacidad compartida representa un avance importante sobre los modelos anteriores de video con IA que producían salidas silenciosas que requerían un diseño de sonido manual.

Seedance 2.0 emplea una arquitectura de Transformador de Difusión de doble rama con rutas de procesamiento separadas para video y audio. Este diseño asegura una sincronización estrecha entre eventos visuales y sus sonidos correspondientes: pasos que coinciden con los golpes de pie, portazos alineados con impactos visuales y paisajes sonoros ambientales que evolucionan naturalmente con los cambios de escena. El sistema de generación de audio crea diálogos, sonidos ambientales y efectos de sonido que se sienten integrados con las imágenes en lugar de superpuestos artificialmente.

Sora 2 también genera diálogos y efectos de sonido sincronizados con un alto grado de realismo. El modelo puede crear fondos sonoros sofisticados, habla con prosodia natural y efectos de sonido que responden apropiadamente a la acción en pantalla. Las pruebas sugieren que la calidad de audio de Sora 2 rivaliza o supera a Seedance 2.0 en fidelidad y realismo, aunque la falta de referencias de entrada de audio significa que tienes menos control directo sobre las características sónicas.

Capacidades Narrativas Multi-toma

Seedance 2.0 introduce un sistema de planificación narrativa que desglosa automáticamente prompts complejos en secuencias multi-toma. Los modelos de video con IA anteriores intentaban meter historias enteras en tomas continuas únicas, resultando en compresión temporal, movimiento distorsionado o elementos de prompt ignorados cuando la descripción excedía la capacidad del modelo. El planificador de Seedance 2.0 analiza tu prompt, identifica puntos de corte de escena naturales y genera una secuencia de tomas que cuentan la historia completa juntas.

Esta capacidad multi-toma produce resultados que se sienten como secuencias editadas en lugar de metraje crudo de toma única. El modelo mantiene la consistencia del personaje, el estilo visual y la continuidad narrativa a través de los límites de las tomas, resolviendo uno de los problemas más desafiantes en la generación de video con IA. Para creadores que producen contenido narrativo, videos explicativos o cualquier aplicación que requiera múltiples perspectivas o cambios de escena, esta característica expande dramáticamente lo que es posible dentro de una sola generación.

Sora 2 mantiene una consistencia excepcional a través de sus duraciones más largas de toma única, pero maneja las secuencias multi-toma de manera diferente. El modelo sobresale en escenas sostenidas de perspectiva única con acción compleja, haciéndolo ideal para momentos narrativos continuos que se benefician de un flujo temporal ininterrumpido. Para secuencias multi-toma, los creadores típicamente generan clips separados y los editan juntos manualmente, lo que ofrece un control más preciso sobre las transiciones pero requiere trabajo de producción adicional.

Pruebas de Rendimiento: Resultados del Mundo Real

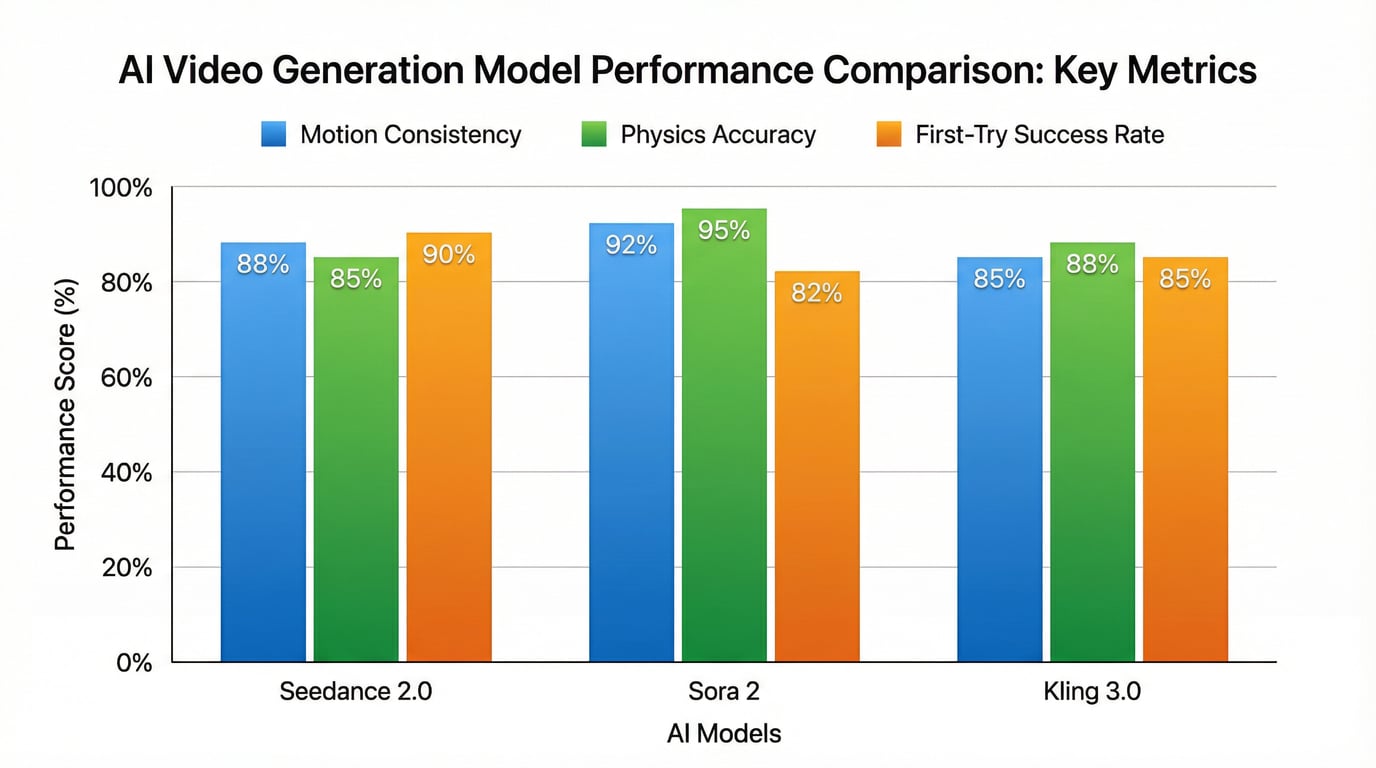

Pruebas independientes a través de múltiples marcos de evaluación proporcionan datos comparativos cuantitativos. En evaluaciones VBench —un punto de referencia autorizado para la calidad de generación de video— la brecha de rendimiento entre Open-Sora 2.0 (una implementación de código abierto que se aproxima a las capacidades comerciales de Sora) y el Sora de OpenAI se ha reducido a solo 0.69%, indicando que los modelos de la generación actual han alcanzado casi la paridad en métricas de calidad medibles.

Las pruebas de la comunidad revelan perfiles de rendimiento distintos. Seedance 2.0 demuestra una coherencia de movimiento y dinámica de cámara superiores, con objetos y movimientos de cámara que se sienten naturales y ejecutados profesionalmente. La tasa de éxito de más del 90% en el primer intento supera significativamente a las herramientas anteriores que requerían múltiples intentos de generación para producir resultados utilizables.

Sora 2 lidera en precisión de simulación física y consistencia temporal, particularmente en escenas que involucran interacciones físicas complejas, múltiples personajes o secuencias narrativas extendidas. La comprensión del modelo de las relaciones causa-efecto y la permanencia de objetos produce videos donde el mundo se comporta de manera predecible y consistente a lo largo del clip completo.

Para narración cinematográfica que requiere movimientos suaves y trabajo de cámara sofisticado, Seedance 2.0 muestra ventajas claras en las pruebas. Para escenas técnicamente exigentes con acción rápida, física compleja o duraciones más largas, Sora 2 actualmente entrega resultados más estables.

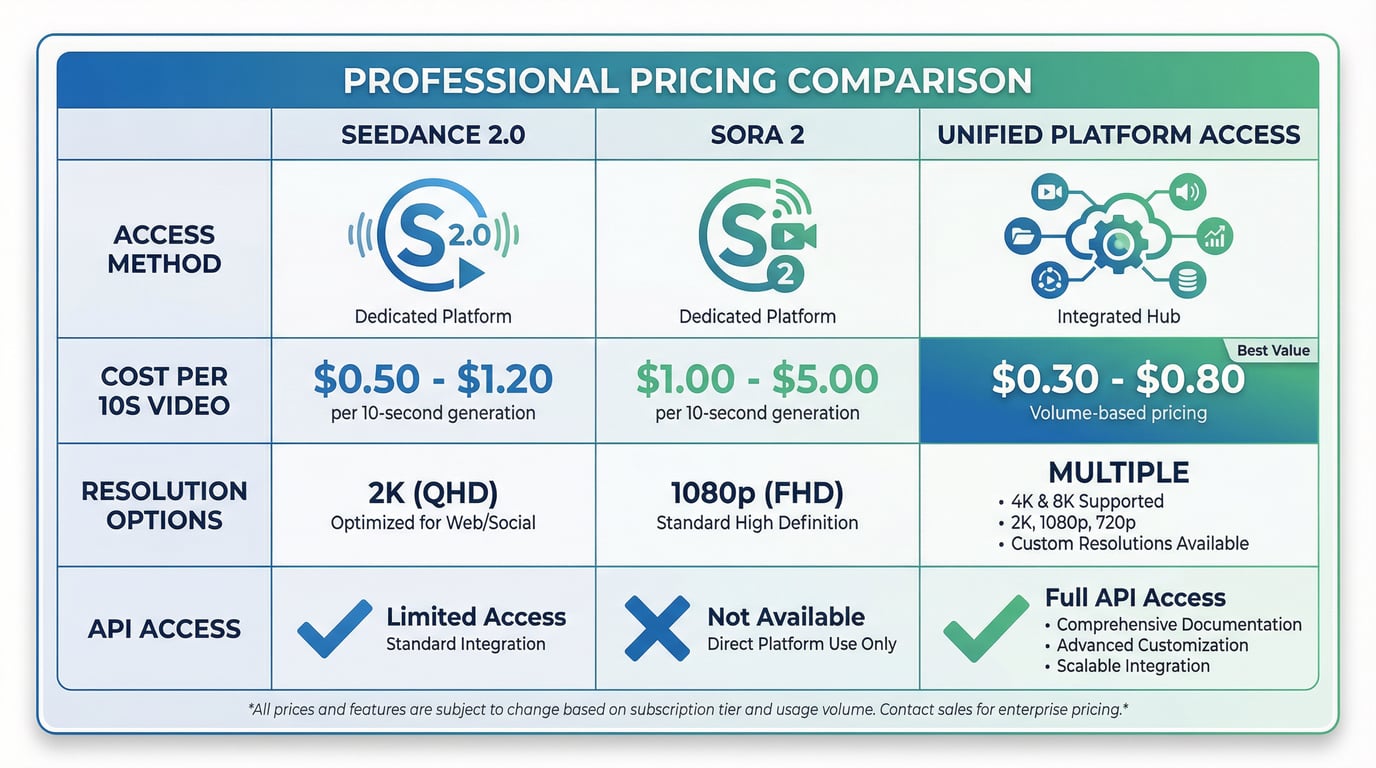

Precios y Accesibilidad: El Factor Costo

Las estructuras de precios difieren significativamente entre estos modelos, reflejando diferentes estrategias comerciales y mercados objetivo.

Sora 2 opera con un modelo de facturación por segundo a través de la API de OpenAI, cobrando de $0.10 a $0.50 por segundo dependiendo de la resolución y el nivel. Un video típico de 10 segundos en resolución estándar cuesta aproximadamente $1.00, mientras que las generaciones de nivel Pro en calidad máxima pueden alcanzar $5.00 para la misma duración. OpenAI también ofrece acceso por suscripción a través de ChatGPT Plus ($20/mes) y ChatGPT Pro ($200/mes), que proporcionan generación basada en créditos con límites diarios.

El modelo de suscripción ofrece mejor valor para usuarios de alto volumen que pueden maximizar sus asignaciones diarias de créditos. ChatGPT Plus proporciona aproximadamente 30 créditos diarios, lo que se traduce en unos 15-30 videos dependiendo de la configuración de duración y resolución. ChatGPT Pro ofrece más de 100 créditos diarios, soportando flujos de trabajo de producción profesional con requisitos de volumen más altos.

El precio de Seedance 2.0 varía según el método de acceso. El modelo está disponible actualmente principalmente a través de la plataforma Jimeng (Dreamina) de ByteDance, con acceso API esperado para lanzarse a través de Volcengine el 24 de febrero de 2026. Proveedores externos ofrecen acceso a Seedance 2.0 a costos que van desde $0.50 a $1.20 por video de 10 segundos, generalmente más bajo que los precios oficiales de Sora 2 pero más alto que algunos revendedores de Sora 2 de terceros.

La ecuación de costos se extiende más allá del precio por video para incluir el factor de tasa de éxito. La tasa de éxito del 90% en el primer intento de Seedance 2.0 significa que típicamente obtienes resultados utilizables sin múltiples reintentos, reduciendo efectivamente tu costo real por video utilizable. Los modelos con tasas de éxito más bajas requieren asignaciones presupuestarias para reintentos y filtrado de calidad, potencialmente duplicando tus costos efectivos incluso si el precio nominal por video parece más bajo.

Acceso a Través de Plataformas Unificadas

En lugar de gestionar cuentas y APIs separadas para cada modelo, muchos creadores acceden a Seedance 2.0 y Sora 2 a través de plataformas unificadas que agregan múltiples modelos de video con IA. Estas plataformas ofrecen varias ventajas: facturación única a través de modelos, diseño de interfaz consistente que reduce las curvas de aprendizaje y la capacidad de probar diferentes modelos con el mismo prompt para una comparación directa de calidad.

Try Seedance 2 proporciona acceso optimizado a Seedance 2.0 junto con otros modelos líderes de generación de video e imagen. La plataforma elimina la complejidad de gestionar múltiples claves API, navegar por diferentes estructuras de precios y aprender interfaces separadas para cada modelo. Puedes generar videos usando Seedance 2.0, Sora 2 y otros modelos desde un solo panel y comparar resultados directamente para determinar qué modelo es mejor para cada caso de uso específico.

Este enfoque unificado resulta particularmente valioso para flujos de trabajo de producción donde diferentes proyectos requieren diferentes fortalezas de modelo. El contenido de redes sociales podría beneficiarse del control multimodal y la alta tasa de éxito de Seedance 2.0, mientras que las secuencias narrativas podrían aprovechar la duración extendida y la precisión física de Sora 2. Tener ambos modelos accesibles a través de una sola plataforma te permite adaptar las capacidades del modelo a los requisitos del proyecto sin cambiar entre servicios separados.

Recomendaciones de Casos de Uso: Qué Modelo para Qué

Elige Seedance 2.0 si:

Necesitas máximo control creativo a través de referencias. Si quieres replicar estilos visuales específicos, patrones de movimiento, atmósferas de audio o movimientos de cámara, el sistema multimodal de Seedance 2.0 ofrece una precisión inigualable. Sube ejemplos de lo que quieres, describe cómo combinarlos y el modelo ejecuta tu visión con un mínimo de ingeniería de prompts.

Estás produciendo contenido de redes sociales en alto volumen. El rango de duración de 4-15 segundos se alinea perfectamente con los formatos de TikTok, Instagram Reels y YouTube Shorts. La tasa de éxito del 90% en el primer intento permite flujos de trabajo de producción confiables donde necesitas resultados consistentes sin una iteración extensa. La resolución nativa 2K asegura que tu contenido se vea nítido en todos los dispositivos.

Necesitas sincronización audiovisual con características de audio específicas. Videos musicales, contenido de baile, videos de marca con sonidos característicos y cualquier aplicación donde el audio impulse el concepto creativo se benefician de la entrada de referencia de audio de Seedance 2.0. Puedes especificar patrones de ritmo exactos, cualidades vocales o atmósferas sonoras para que el modelo coincida en su salida.

Requieres resolución máxima para aplicaciones de pantalla o impresión. La salida nativa 2K proporciona detalles superiores para pantallas grandes, publicidad de alta definición, señalización digital y cualquier contexto donde la fidelidad visual impacte directamente en la calidad percibida.

Priorizas el trabajo de cámara cinematográfico y la estética del movimiento. Para contenido donde el estilo visual, los movimientos suaves de cámara y las características de movimiento similares a películas importan más que la estricta precisión física, el perfil de movimiento de Seedance 2.0 produce resultados estéticamente más agradables.

Elige Sora 2 si:

Necesitas duración extendida para secuencias narrativas. El rango de 5-25 segundos (dependiendo del nivel) permite golpes completos de historia, demostraciones de productos con múltiples características o cualquier contenido que se beneficie de un desarrollo temporal sostenido sin requerir edición de múltiples clips.

La precisión física y el realismo son críticos. Para contenido que representa escenarios del mundo real donde el movimiento poco realista se destacaría inmediatamente —deportes, interacciones complejas, secuencias de causa y efecto—, las capacidades de simulación física de Sora 2 entregan resultados superiores.

Prefieres flujos de trabajo directos de texto a video. Si te sientes cómodo con la ingeniería de prompts y no necesitas la complejidad de gestionar múltiples archivos de referencia, la estructura de entrada más simple de Sora 2 ofrece una experiencia más optimizada. La fuerte comprensión semántica del modelo produce resultados excelentes solo a partir de descripciones de texto bien elaboradas.

Necesitas máxima consistencia temporal en clips largos. La capacidad de Sora 2 para mantener la apariencia del personaje, el estado del mundo y la continuidad narrativa a través de generaciones de 20-25 segundos lo hace ideal para contenido donde los errores de consistencia son inmediatamente notables y problemáticos.

Estás produciendo contenido de fantasía, abstracto o surrealista. La interpretación creativa de conceptos abstractos por parte de Sora 2 y su capacidad para generar escenarios imaginativos que no existen en el mundo real lo hacen particularmente efectivo para contenido de video artístico, experimental o conceptual.

Limitaciones Técnicas y Consideraciones

Ambos modelos tienen limitaciones que afectan su idoneidad para aplicaciones específicas.

La duración máxima más corta de Seedance 2.0 requiere flujos de trabajo de múltiples clips para contenido que exceda los 15 segundos. Mientras que el sistema de extensión mantiene una consistencia razonable para 2-3 iteraciones, la degradación de calidad se vuelve notable más allá de eso. Esta limitación hace que Seedance 2.0 sea menos adecuado para secuencias narrativas de una sola toma o contenido que se beneficie de un flujo temporal ininterrumpido.

El sistema de referencia multimodal, aunque poderoso, introduce complejidad. Gestionar múltiples archivos de referencia, entender cómo el modelo combina diferentes tipos de entrada y aprender estrategias de referencia efectivas requiere más inversión inicial que los flujos de trabajo simples de texto a video. El límite de 12 archivos puede sentirse restrictivo para proyectos complejos que requieren numerosas referencias de estilo, movimiento y audio.

Seedance 2.0 tiene actualmente una accesibilidad limitada fuera del ecosistema de ByteDance, con acceso API solo recientemente disponible a través de plataformas seleccionadas. Esta disponibilidad restringida ha ralentizado la adopción en comparación con alternativas más ampliamente accesibles.

La resolución máxima de 1080p de Sora 2 se queda atrás de la salida 2K de Seedance 2.0, limitando potencialmente su idoneidad para aplicaciones que requieren máxima fidelidad visual. El precio más alto por segundo puede hacer que Sora 2 sea significativamente más costoso para la producción de alto volumen, particularmente al generar clips más largos en configuraciones de calidad premium.

Ambos modelos producen ocasionalmente artefactos, transformaciones o inconsistencias que requieren regeneración. Presupuesta 1.5-2x tu volumen de generación esperado para tener en cuenta el filtrado de calidad y los reintentos. Los tiempos de generación típicamente varían de 2 a 5 minutos por video dependiendo de la duración, resolución y carga actual del servidor, haciendo que las aplicaciones en tiempo real o casi real sean desafiantes.

El Paisaje Competitivo Más Amplio

Mientras Seedance 2.0 y Sora 2 dominan las discusiones actuales, existen dentro de un paisaje competitivo en rápida evolución. Veo 3.1 de Google ofrece salida lista para transmisión con velocidades de cuadro estándar de cine y un fuerte rendimiento en tareas de generación directas. Gen-4 de Runway proporciona las herramientas para desarrolladores más accesibles y un control de movimiento preciso a través de interfaces basadas en pinceles. Kling 3.0 de Kuaishou entrega excelente valor para flujos de trabajo sencillos de prompt a video, particularmente para temas y entornos asiáticos.

Cada modelo ocupa una posición distinta en el ecosistema. Sora 2 sigue siendo el líder de marca para la calidad cinematográfica y la simulación física, aunque su mayor costo y disponibilidad limitada crean oportunidades para alternativas. Seedance 2.0 ofrece el sistema de control más completo para creadores que saben exactamente lo que quieren y pueden proporcionar materiales de referencia. Runway Gen-4 atiende a desarrolladores y usuarios técnicos que priorizan la calidad de API y la flexibilidad de integración. Kling 3.0 ofrece resultados confiables a precios competitivos para usuarios que no necesitan sistemas de referencia avanzados o máxima precisión física.

El rápido ritmo de desarrollo significa que el líder de hoy en cualquier dimensión específica puede ser superado en meses. Seedance 2.0 se lanzó en febrero de 2026, Sora 2 estabilizó su infraestructura a finales de 2025 y Runway Gen-4 expandió sus capacidades API a principios de 2026, todo dentro de un marco de tiempo comprimido que sugiere una iteración rápida continua a través de todas las plataformas.

Desarrollo Futuro y Hoja de Ruta

La trayectoria de la generación de video con IA apunta a varias tendencias claras que darán forma a la evolución de ambos modelos.

La resolución continuará aumentando, con la salida 4K volviéndose estándar en lugar de excepcional. Seedance 2.0 ya soporta hasta 2160p (4K) dependiendo del nivel de API y límites de velocidad, sugiriendo que la salida de ultra alta definición será ampliamente accesible en la próxima generación de modelos.

Los límites de duración se expandirán aún más, permitiendo secuencias narrativas completas dentro de generaciones individuales. El máximo actual de 25 segundos representa un aumento de 4 veces sobre los modelos anteriores, y esta tendencia probablemente continuará hasta que las generaciones continuas de varios minutos sean factibles sin pérdida de calidad.

Las capacidades multimodales proliferarán a través de todos los modelos. El sistema de referencia cuatrimodal de Seedance 2.0 demuestra ventajas claras en control creativo, sugiriendo que los competidores adoptarán una flexibilidad de entrada similar. La capacidad de comunicar la intención creativa a través de múltiples canales simultáneamente representa una mejora fundamental sobre las interfaces de solo texto.

Las simulaciones físicas mejorarán en todos los ámbitos, reduciendo la brecha actual entre la precisión líder en la industria de Sora 2 y las capacidades de los competidores. A medida que los conjuntos de datos de entrenamiento crecen y las arquitecturas de modelos evolucionan, el movimiento realista y las interacciones físicas se convertirán en apuestas básicas en lugar de diferenciadores.

La generación en tiempo real o casi real surgirá a medida que la infraestructura escale y la eficiencia del modelo mejore. Los tiempos de generación actuales de 2-5 minutos limitan ciertas aplicaciones; reducir esto a segundos desbloquearía casos de uso completamente nuevos en producción en vivo, contenido interactivo y herramientas creativas en tiempo real.

Tomando la Decisión: Un Marco

Elegir entre Seedance 2.0 y Sora 2 requiere mapear las capacidades del modelo contra tus requisitos específicos a través de múltiples dimensiones.

Evalúa tus necesidades de control. Si tienes materiales de referencia específicos y necesitas un control preciso sobre el estilo visual, las características de movimiento y la atmósfera de audio, el sistema multimodal de Seedance 2.0 ofrece capacidades que Sora 2 no puede igualar. Si prefieres flujos de trabajo más simples y estás satisfecho con resultados impulsados solo por prompts de texto, el enfoque optimizado de Sora 2 puede ser más eficiente.

Considera tus necesidades de duración. Para contenido de menos de 15 segundos, ambos modelos funcionan efectivamente. Para secuencias de 15-25 segundos, Sora 2 es tu única opción entre estos dos. Para contenido que exceda los 25 segundos, ambos modelos requieren flujos de trabajo de múltiples clips con edición manual.

Valora tus requisitos de precisión física. Si tu contenido representa escenarios del mundo real donde el movimiento poco realista se destacaría inmediatamente —deportes, interacciones complejas, secuencias de causa y efecto—, la simulación física superior de Sora 2 justifica el mayor costo. Si el estilo visual y el impacto estético importan más que la precisión física, las características de movimiento de Seedance 2.0 a menudo producen resultados más agradables.

Calcula tus costos reales. Factoriza las tasas de éxito, no solo los precios nominales por video. Un modelo con una tasa de éxito del 90% a $1.00 por video cuesta efectivamente $1.11 por video utilizable. Un modelo con una tasa de éxito del 60% a $0.80 por video cuesta $1.33 por video utilizable después de tener en cuenta las generaciones fallidas. La mayor tasa de éxito de Seedance 2.0 en el primer intento a menudo lo hace más rentable a pesar de precios nominales comparables.

Factoriza tus requisitos de resolución. Para contenido destinado a pantallas grandes, publicidad de alta definición o aplicaciones donde la máxima fidelidad visual cuenta, la salida 2K de Seedance 2.0 ofrece una ventaja significativa. Para aplicaciones web estándar y de redes sociales, la salida de 1080p de Sora 2 sigue siendo totalmente profesional.

Prueba ambos modelos en tus casos de uso reales. Las comparaciones teóricas solo llegan hasta cierto punto. Genera videos de prueba con ambos modelos usando prompts representativos de tus proyectos reales. Evalúa los resultados contra tus estándares de calidad específicos, requisitos de flujo de trabajo y objetivos creativos. El modelo que funcione mejor en tu contenido real importa más que el modelo que gane en puntos de referencia abstractos.

Conclusión: Herramientas Complementarias, No Rivales Directos

Seedance 2.0 y Sora 2 representan filosofías diferentes sobre cómo debería funcionar la generación de video con IA. Seedance 2.0 prioriza el control creativo a través de referencias multimodales, permitiendo una especificación precisa del estilo visual, las características de movimiento y la atmósfera de audio a través de ejemplos en lugar de descripciones. Sora 2 enfatiza la precisión física y la consistencia temporal extendida, produciendo videos donde el mundo se comporta de manera realista durante duraciones más largas.

Estos enfoques distintos hacen que los modelos sean más complementarios que directamente competitivos. Los flujos de trabajo profesionales utilizan cada vez más múltiples modelos, seleccionando la herramienta que mejor se adapta a los requisitos de cada proyecto específico. El contenido de redes sociales podría aprovechar la alta tasa de éxito y el control multimodal de Seedance 2.0. Las secuencias narrativas podrían utilizar la duración extendida y la simulación física de Sora 2. Las demostraciones de productos podrían cambiar entre modelos dependiendo de si el contenido enfatiza el estilo visual o la interacción realista del producto.

El enfoque de plataforma unificada —acceder a ambos modelos a través de servicios como Try Seedance 2— refleja esta realidad. En lugar de comprometerse exclusivamente con el ecosistema de un modelo, los creadores se benefician al tener ambas herramientas disponibles, eligiendo el modelo adecuado para cada tarea específica basándose en requisitos reales en lugar de lealtad a la plataforma.

A medida que la tecnología de generación de video con IA continúa evolucionando rápidamente, la brecha entre estos modelos se reducirá en algunas dimensiones mientras surgen nuevos diferenciadores en otras. Lo que permanece constante es el principio fundamental: alinea las capacidades del modelo con las necesidades del proyecto, prueba exhaustivamente en tus casos de uso reales y mantente lo suficientemente flexible para adoptar nuevas herramientas a medida que demuestren su valor en los flujos de trabajo de producción.

El futuro de la generación de video con IA no se trata de encontrar el único mejor modelo, sino de construir un conjunto de herramientas de capacidades complementarias que juntas permitan visiones creativas que eran imposibles hace solo unos meses. Tanto Seedance 2.0 como Sora 2 merecen su lugar en ese conjunto de herramientas, cada uno sobresaliendo en las dimensiones que más importan para diferentes tipos de contenido.

Conclusiones Clave

| Dimensión | Seedance 2.0 | Sora 2 |

|---|---|---|

| Resolución | 2K (2048×1152) | 1080p |

| Duración | 4-15 segundos | 5-25 segundos |

| Tipos de Entrada | Texto, Imagen, Video, Audio | Texto, Imagen |

| Relaciones de Aspecto | 6 opciones | 3 opciones |

| Precisión Física | Buena | Excelente |

| Estética de Movimiento | Excelente | Buena |

| Éxito en 1er Intento | ~90% | ~82% |

| Mejor para | Redes Sociales, control multimodal, Salida Alta Res | Secuencias narrativas, simulación física, duración extendida |

| Rango de Precio | $0.50-1.20 por video de 10s | $1.00-5.00 por video de 10s |

¿Listo para experimentar ambos modelos? Try Seedance 2 proporciona un acceso conveniente a Seedance 2.0, Sora 2 y otros modelos líderes de generación de video e imagen con IA a través de una sola plataforma unificada, eliminando la complejidad de gestionar múltiples servicios mientras te brinda la flexibilidad de elegir la herramienta adecuada para cada proyecto.