Cuando ByteDance lanzó Seedance 2.0 en febrero de 2026, el panorama de la generación de video por IA cambió de la noche a la mañana. En cuestión de días, creadores internacionales se apresuraron a encontrar números de teléfono chinos solo para registrarse y obtener acceso. Las plataformas de redes sociales explotaron con videos generados por IA que parecían indistinguibles de metraje filmado profesionalmente. Algunos usuarios informaron haber ganado más de $8,000 en dos días revendiendo créditos de acceso.

Esto no es publicidad exagerada, es un punto de inflexión genuino en la tecnología de video de IA. Después de extensas pruebas prácticas con Seedance 2.0, puedo confirmar que este modelo representa el avance más significativo en la generación de video por IA desde que apareció por primera vez Sora de OpenAI. En esta reseña completa, desglosaré exactamente qué hace que Seedance 2.0 sea diferente, cómo funciona en escenarios del mundo real y si está a la altura de las extraordinarias afirmaciones que circulan en línea.

¿Qué es Seedance 2.0?

Seedance 2.0 es el modelo de generación de video por IA de segunda generación de ByteDance, construido sobre la base de su anterior Seedance 1.5 Pro. Lo que distingue a este modelo es su verdadera arquitectura multimodal: puede procesar y referenciar simultáneamente imágenes, videos, archivos de audio y prompts de texto para generar contenido de video cohesivo.

A diferencia de los modelos de video de IA anteriores que generalmente aceptan texto más una sola imagen (o como mucho un primer y último cuadro), Seedance 2.0 te permite subir hasta 12 archivos de referencia en una sola generación. Esto incluye hasta 9 imágenes, 3 clips de video y 3 archivos de audio, con un límite de duración combinada de video/audio de 15 segundos.

El modelo puede generar videos que van desde 4 a 15 segundos en resolución nativa 2K (2048×1152), con algunos informes que indican capacidad 4K dependiendo del nivel de API. El tiempo de generación generalmente oscila entre 30 y 90 segundos para un clip de 5 segundos a 1080p, lo que lo convierte consistentemente en el más rápido entre los modelos de primer nivel.

¿Quieres experimentar Seedance 2.0 y otros modelos de video de IA de vanguardia sin la molestia de múltiples registros? Prueba Seedance 2 aquí para un acceso fluido a múltiples modelos de generación de video e imagen de última generación a través de una plataforma única y conveniente.

Características clave que distinguen a Seedance 2.0

1. Verdadero sistema de referencia multimodal

La característica más transformadora de Seedance 2.0 es su sistema de creación basado en referencias. En lugar de elaborar prompts de texto detallados para describir movimientos de cámara complejos o secuencias de acción, simplemente subes materiales de referencia y dejas que el modelo los analice y replique.

Esto es lo que puedes referenciar:

-

Movimiento y coreografía de clips de video

-

Movimientos de cámara y técnicas cinematográficas

-

Estilo visual y estética de imágenes

-

Ritmo de audio y atmósfera para una edición ajustada al ritmo

-

Apariencia y consistencia del personaje a través de tomas

Este enfoque cambia fundamentalmente el flujo de trabajo creativo. En lugar de convertirte en un experto en ingeniería de prompts, te conviertes en un curador de referencias, una habilidad que la mayoría de los creadores ya poseen.

2. Comprensión avanzada de la física

Uno de los problemas persistentes con los modelos de video de IA anteriores era su pobre comprensión de la física del mundo real. Los personajes se deslizaban en lugar de caminar, los objetos flotaban de forma antinatural y las secuencias de acción parecían estar sucediendo bajo el agua.

Seedance 2.0 demuestra una comprensión sofisticada de la física, la gravedad y el impulso. Durante las pruebas, generé secuencias de artes marciales donde los golpes tenían un impacto visible, los bailarines mantenían una distribución de peso adecuada durante movimientos complejos y los objetos caían con una aceleración creíble. El modelo entiende que una patada giratoria requiere impulso, que la tela tiene peso y cae naturalmente, y que el movimiento de la cámara debe corresponder a la intensidad de la acción.

3. Trabajo de cámara complejo y secuencias de una sola toma

La cinematografía profesional implica movimientos de cámara intrincados que antes eran casi imposibles de describir en prompts de texto. Seedance 2.0 sobresale en replicar trabajos de cámara complejos cuando se le dan referencias de video.

En mis pruebas, el modelo generó con éxito:

-

Tomas de seguimiento que siguen a los sujetos suavemente a través de entornos

-

Movimientos de grúa que comienzan amplios y se acercan a primeros planos

-

Tomas orbitales que giran alrededor de sujetos estacionarios

-

Secuencias de POV en primera persona con movimiento de cabeza realista

-

Transiciones fluidas entre múltiples ángulos de cámara en una sola generación

La capacidad de una sola toma es particularmente impresionante. Puedes describir una secuencia de múltiples tomas en tu prompt, y Seedance 2.0 la generará como un video continuo con transiciones naturales entre ángulos, sin necesidad de unión manual.

4. Sincronización audiovisual

Seedance 2.0 es el primer modelo de video de IA importante en integrar audio como una entrada de referencia creativa. Cuando subes un archivo de audio, el modelo analiza su ritmo, intensidad y tono emocional, luego genera video que se sincroniza con las características del audio.

Durante las pruebas, subí una pieza orquestal dramática y generé una secuencia de lucha. El modelo emparejó automáticamente los golpes de percusión pesados con momentos de impacto, sincronizó los cortes de cámara con las transiciones musicales y ajustó la intensidad de la acción para seguir el rango dinámico del audio. Esta generación consciente del audio elimina horas de trabajo de edición manual típicamente requeridas para sincronizar video con música.

5. Consistencia de personaje y estilo

Mantener una apariencia de personaje consistente a través de múltiples tomas ha sido un desafío importante para la generación de video por IA. Seedance 2.0 aborda esto a través de su sistema de múltiples referencias. Al subir múltiples imágenes del mismo personaje desde diferentes ángulos, el modelo construye una comprensión más completa de la apariencia de ese personaje y mantiene la consistencia a lo largo del video generado.

En pruebas comparativas, Seedance 2.0 superó significativamente a los competidores en el mantenimiento de características faciales consistentes, detalles de ropa y proporciones corporales a través de diferentes tomas y condiciones de iluminación.

Resultados de las pruebas prácticas

Para evaluar el rendimiento en el mundo real de Seedance 2.0, realicé una serie de pruebas en diferentes casos de uso que los creadores encuentran comúnmente.

Prueba 1: Replicación de secuencia de acción

Objetivo: Replicar una secuencia compleja de artes marciales utilizando solo un video de referencia e imágenes de personajes.

Configuración: Subí una escena de lucha de kung fu de 10 segundos como referencia de movimiento, junto con dos imágenes de personajes robot (una para cada luchador).

Prompt: "Reemplazar a los luchadores en @video1 con personajes robot de @image1 y @image2. Mantener la coreografía exacta, el trabajo de cámara y el tiempo de impacto del video de referencia. Iluminación escénica con sombras dramáticas."

Resultado: El video generado capturó la coreografía original con notable precisión. Ambos robots mantuvieron una apariencia consistente en todo momento. Los puñetazos, patadas y movimientos defensivos coincidieron con el tiempo de referencia. La física del impacto parecía creíble: sin extremidades flotantes o movimientos antinaturales. El único problema menor fue un ligero desenfoque ocasional durante los movimientos más rápidos.

Calificación: A-

Prueba 2: Movimiento de cámara cinematográfico

Objetivo: Generar un video de exhibición de producto con trabajo de cámara profesional.

Configuración: Subí un video de referencia que mostraba una toma de grúa que comienza amplia y se acerca a un primer plano, junto con una imagen de producto.

Prompt: "Replicar el movimiento de cámara de @video1 para mostrar el producto @image1. Entorno de estudio de lujo con iluminación dramática. Enfatizar materiales premium y artesanía."

Resultado: El movimiento de la cámara fue suave y de aspecto profesional. El producto permaneció en enfoque nítido en todo momento. La iluminación hizo una transición natural a medida que la cámara se acercaba. El desenfoque de fondo (bokeh) parecía realista. La calidad del video estaba lista para transmisión sin edición adicional.

Calificación: A

Prueba 3: Video de baile con sincronización de música

Objetivo: Crear un video de actuación de baile sincronizado con música.

Configuración: Subí un video de referencia de baile de 15 segundos con audio, más una foto de retrato.

Prompt: "Reemplazar al bailarín en @video1 con la persona de @image1 usando traje tradicional mongol. Mantener toda la coreografía y el trabajo de cámara. Escenario con iluminación dramática. Sincronizar movimientos con el ritmo de la música."

Resultado: Esta prueba produjo los resultados más impresionantes. El modelo no solo replicó la coreografía de baile con precisión, sino que también mantuvo una sincronización perfecta con el ritmo de la música. Los movimientos de cámara coincidieron con las transiciones musicales. El traje del personaje fluía naturalmente con el movimiento. Las expresiones faciales cambiaron apropiadamente con el tono emocional de la música.

Calificación: A+

Prueba 4: Escena narrativa solo a partir de texto

Objetivo: Generar una escena narrativa compleja utilizando principalmente una descripción de texto con referencia visual mínima.

Configuración: Solo una imagen de retrato como referencia de personaje.

Prompt: "Seguir la espalda de la persona @image1 mientras camina por una carretera de pueblo nevada en Nochevieja. Farolas tenues, sonido de ruedas de equipaje sobre la nieve. Se detienen para calentar sus manos congeladas, aliento visible en el aire frío. La cámara sigue mientras doblan una esquina y ven una casa con decoraciones rojas y luz cálida desde las ventanas. Empujan la pesada puerta para abrirla. La cámara se mueve más allá de su hombro hacia el patio lleno de linternas rojas. Un perro corre a saludarlos. Los padres aparecen desde la cocina, la madre se apresura mientras el padre finge ser casual."

Resultado: El modelo generó una secuencia narrativa sorprendentemente coherente. El trabajo de cámara de una sola toma fluyó naturalmente a través de múltiples elementos de la escena. Detalles atmosféricos como el vapor del aliento y la luz cálida estaban presentes. Sin embargo, algunas acciones específicas mencionadas en el prompt (como el perro corriendo y las reacciones exactas de los padres) se simplificaron u omitieron. El arco emocional estaba presente pero menos matizado de lo descrito.

Calificación: B+

Esta prueba reveló una limitación importante: si bien Seedance 2.0 sobresale en la creación basada en referencias, las narrativas complejas puramente impulsadas por texto aún requieren cierta interpretación creativa por parte del modelo.

Prueba 5: Transferencia de estilo y reinterpretación creativa

Objetivo: Aplicar un estilo visual específico a un concepto de escena.

Configuración: Subí una imagen estilizada de "La La Land" con colores vibrantes e iluminación teatral.

Prompt: "Crear una alegre escena de baile musical basada en el estilo visual de @image1. Múltiples bailarines, movimiento de cámara dinámico, atmósfera de celebración."

Resultado: El modelo demostró una interpretación creativa impresionante. Sin referencia de coreografía específica, generó movimientos de baile originales que se sentían apropiados para un número musical. La gradación de color y la iluminación coincidieron con la estética de la imagen de referencia. El trabajo de cámara incluyó movimientos de barrido y ángulos dinámicos que mejoraron el estado de ánimo festivo. La complejidad de la coreografía superó las expectativas dada la entrada mínima.

Calificación: A

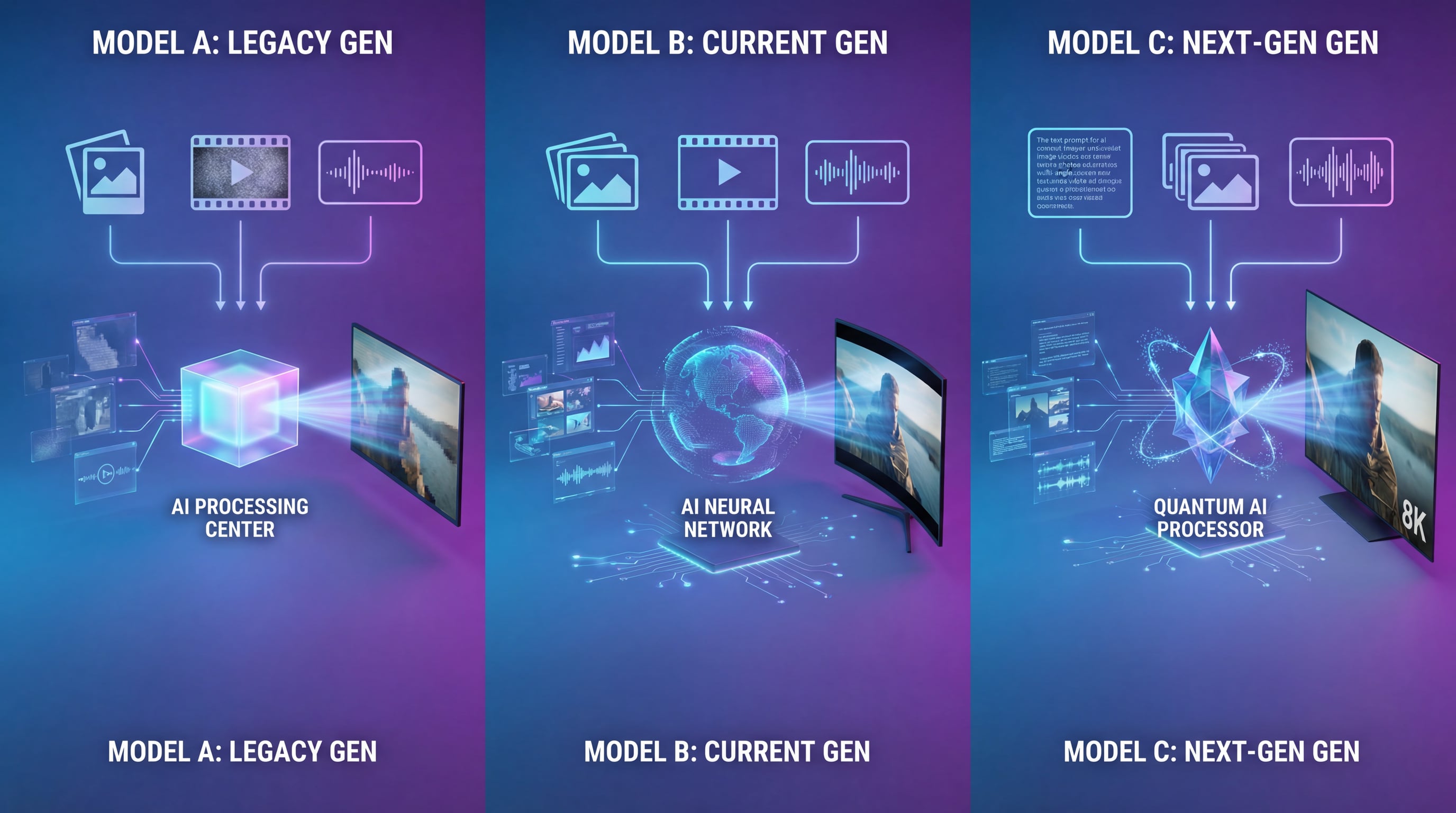

Seedance 2.0 vs. La competencia

Para comprender la posición de Seedance 2.0 en el mercado, lo comparé con los otros dos modelos líderes de video de IA: Sora 2 de OpenAI y Runway Gen-4.

| Característica | Seedance 2.0 | Sora 2 | Runway Gen-4 |

|---|---|---|---|

| Resolución Máx | 2K nativa (capaz de 2160p) | 1080p | 1080p |

| Duración Máx | 4-15 segundos | 20-25 segundos | 10 segundos |

| Tipos de Entrada | Texto, Imagen (×9), Video (×3), Audio (×3) | Texto, Imagen (×1) | Texto, Imagen, Video |

| Velocidad de Gen | 30-90 seg (5s @ 1080p) | 90-180 seg | 60-120 seg |

| Precisión Física | Excelente | Excelente | Muy Buena |

| Consistencia Pers. | Excelente (multi-referencia) | Buena (función Cameo) | Buena |

| Sincronización Audio | Soporte nativo | Generación separada | Generación separada |

| Mejor Para | Creación basada en referencia, iteración rápida | Secuencias narrativas largas | Control de movimiento, guion gráfico |

Diferenciadores clave

Ventajas de Seedance 2.0:

-

Tiempos de generación más rápidos entre modelos de primer nivel

-

Resolución nativa más alta (estándar 2K, capaz de 4K)

-

Sistema de entrada más flexible (12 archivos, 4 modalidades)

-

Sincronización audiovisual nativa

-

Consistencia de personaje superior a través de multi-referencia

-

Lo mejor para iteración rápida de contenido y flujos de trabajo de producción

Ventajas de Sora 2:

-

Duración máxima de video más larga (20-25 segundos)

-

Coherencia narrativa de formato largo excepcional

-

Fuerte simulación del mundo y física

-

Mejor para contar historias que requieren secuencias extendidas

Ventajas de Runway Gen-4:

-

Controles avanzados de pincel de movimiento

-

Excelentes funciones de guion gráfico

-

Fuerte rendimiento de referencia

-

Lo mejor para necesidades de control de movimiento preciso

La elección entre estos modelos depende de su caso de uso específico. Seedance 2.0 sobresale en entornos de producción donde la velocidad, la resolución y el control basado en referencias son prioridades. Sora 2 es superior para contenido narrativo más largo. Runway Gen-4 ofrece el control de movimiento más granular.

Casos de uso del mundo real

Basado en mis pruebas, aquí están los escenarios donde Seedance 2.0 ofrece el mayor valor:

1. Creación de contenido para redes sociales

El rango de duración de 4-15 segundos coincide perfectamente con los formatos de TikTok, Instagram Reels y YouTube Shorts. El rápido tiempo de generación permite una iteración rápida: puede probar múltiples enfoques creativos en el tiempo que tomaría grabar y editar un solo video tradicional.

2. Publicidad y exhibiciones de productos

La resolución 2K y las capacidades de trabajo de cámara profesional hacen que Seedance 2.0 sea adecuado para aplicaciones comerciales. Los videos de productos, contenido de marca y anuncios publicitarios se pueden generar con calidad de transmisión.

3. Videos musicales y contenido de baile

La función de sincronización de audio nativa hace que Seedance 2.0 sea particularmente poderoso para contenido relacionado con la música. La edición ajustada al ritmo ocurre automáticamente, eliminando el tedioso trabajo de sincronización manual.

4. Visualización de acción y acrobacias

La capacidad de hacer referencia a secuencias de acción complejas y replicarlas con diferentes personajes hace que esta herramienta sea invaluable para la previsualización, la planificación de acrobacias y el diseño de secuencias de acción.

5. Desarrollo de conceptos y presentación

La velocidad de iteración rápida y la alta calidad visual hacen que Seedance 2.0 sea excelente para desarrollar y presentar conceptos creativos a clientes o partes interesadas antes de comprometerse con la producción completa.

Limitaciones y consideraciones

A pesar de sus impresionantes capacidades, Seedance 2.0 tiene limitaciones importantes que los usuarios deben comprender:

1. Restricciones de duración

La duración máxima de 15 segundos limita la narración de historias de formato largo. Si bien puede generar múltiples clips y editarlos juntos, esto agrega complejidad al flujo de trabajo y no garantiza una continuidad perfecta entre segmentos generados por separado.

2. Dependencia del prompt para narrativas complejas

Cuando se trabaja sin materiales de referencia sólidos, la interpretación del modelo de prompts de texto complejos puede ser inconsistente. Los detalles específicos pueden simplificarse u omitirse. Esto hace que los flujos de trabajo basados en referencias sean significativamente más confiables que la generación pura de texto a video.

3. Artefactos ocasionales durante el movimiento rápido

Los movimientos extremadamente rápidos a veces producen un ligero desenfoque de movimiento o artefactos temporales. Si bien estos son menores y menos frecuentes que en los modelos de la competencia, ocasionalmente pueden requerir regeneración.

4. Disponibilidad limitada

A partir de febrero de 2026, el acceso a Seedance 2.0 sigue siendo limitado. La plataforma oficial Jimeng requiere un número de teléfono chino para el registro, creando barreras para los usuarios internacionales. Las plataformas de terceros que ofrecen acceso pueden tener costos de crédito y disponibilidad de funciones variables.

Para un acceso sin problemas a Seedance 2.0 sin barreras de registro, visite Try Seedance 2 para comenzar a crear con múltiples modelos avanzados de IA a través de una plataforma conveniente.

5. Consideraciones éticas

La capacidad del modelo para generar rostros y movimientos humanos altamente realistas plantea importantes cuestiones éticas. ByteDance ha implementado restricciones en la generación de rostros de personas reales en respuesta a las preocupaciones sobre deepfakes y desinformación. Los usuarios deben completar la verificación de identidad para generar videos con su propia imagen, y el uso no autorizado de los rostros de otros está prohibido.

Consejos para obtener los mejores resultados

Después de extensas pruebas, aquí están mis recomendaciones para maximizar la calidad de salida de Seedance 2.0:

1. Priorizar materiales de referencia sobre el texto

Cuando sea posible, muestre en lugar de contar. Un video de referencia de 5 segundos del movimiento de cámara que desea producirá mejores resultados que un párrafo describiéndolo.

2. Usar múltiples ángulos para la consistencia del personaje

Si la consistencia del personaje es crítica, suba 3-5 imágenes del personaje desde diferentes ángulos. Esto ayuda al modelo a construir una comprensión más completa de la apariencia del personaje.

3. Estructurar sus prompts claramente

Use el símbolo @ para hacer referencia explícita a los archivos subidos dentro de su prompt. Describa claramente qué elementos deben provenir de qué referencias. Estructura: "Usar el movimiento de @video1, el estilo visual de @image1 y la apariencia del personaje de @image2."

4. Coincidir la calidad de referencia con la salida deseada

Los materiales de referencia de baja calidad limitarán la calidad de salida. Use imágenes y videos de alta resolución como referencias siempre que sea posible.

5. Aprovechar el audio para el ritmo y la cadencia

Al generar contenido con un ritmo o cadencia específicos, suba una referencia de audio incluso si planea reemplazar el audio en la postproducción. El modelo lo usará para informar el tiempo y los cortes.

6. Iterar en los prompts, no solo en las semillas

Si una generación no cumple con las expectativas, analice por qué. A menudo, ajustar la estructura del prompt o agregar un archivo de referencia adicional produce mejores resultados que simplemente regenerar con las mismas entradas.

7. Comprender la estrategia del límite de 12 archivos

Con un máximo de 12 archivos, priorice estratégicamente:

-

1-2 archivos para referencia de personaje/sujeto

-

1-2 archivos para referencia de movimiento/acción

-

1-2 archivos para estilo visual/estética

-

1 archivo para audio/ritmo (si corresponde)

-

Reserve las ranuras restantes para referencias de detalles específicos

El impacto más amplio: El momento "Mito Negro" del video de IA

La comunidad de juegos china utiliza el término momento "Mito Negro" para describir cuando un producto nacional logra reconocimiento global por igualar o superar los estándares internacionales, una referencia al juego "Black Myth: Wukong" que demostró que los estudios chinos podían crear juegos de calidad AAA.

Seedance 2.0 representa el momento "Mito Negro" de la generación de video por IA. Demuestra que las empresas de IA chinas no solo pueden competir, sino potencialmente liderar en tecnologías de IA generativa de vanguardia.

El productor de "Black Myth: Wukong" de Game Science, Feng Ji, probó Seedance 2.0 y declaró: "La era de la infancia de la generación de video AIGC ha terminado oficialmente". Esto no es una hipérbole, es una evaluación precisa del salto tecnológico que representa este modelo.

Las implicaciones se extienden más allá del orgullo nacional. El lanzamiento de Seedance 2.0 acelera la democratización de la producción de video. Los pequeños estudios y los creadores independientes ahora tienen acceso a capacidades que anteriormente requerían presupuestos y experiencia técnica significativos. McKinsey estima que la generación de contenido por IA podría redistribuir $60 mil millones en el mercado del ecosistema de contenido dentro de cinco años, con gran parte de ese valor cambiando de grandes compañías de producción a creadores y estudios más pequeños.

Precios y acceso

Seedance 2.0 está actualmente disponible a través de la plataforma Jimeng de ByteDance, que opera en un sistema basado en créditos. Los costos de generación varían según la duración y la resolución del video:

- Video de 4 segundos: ~20-30 créditos

- Video de 10 segundos: ~50-70 créditos

- Video de 15 segundos: ~80-100 créditos

Los nuevos usuarios generalmente reciben una asignación de crédito inicial para pruebas. Se pueden comprar créditos adicionales, aunque el precio varía según la región y el tipo de cuenta.

Los usuarios internacionales enfrentan desafíos de registro, ya que la plataforma requiere un número de teléfono chino. Han surgido varias plataformas de terceros que ofrecen acceso a Seedance 2.0 con opciones alternativas de pago y registro, aunque los usuarios deben verificar la legitimidad y los términos de servicio.

Para el acceso más conveniente a Seedance 2.0 y otros modelos líderes de video de IA, Try Seedance 2 ofrece una plataforma unificada con múltiples modelos de última generación, eliminando la necesidad de múltiples registros y proporcionando sistemas de crédito sencillos.

Veredicto final

Calificación general: 9.2/10

Seedance 2.0 representa el avance más significativo en la generación de video por IA desde que surgió la tecnología. Su sistema de referencia multimodal, comprensión excepcional de la física, tiempos de generación rápidos y sincronización audiovisual nativa crean una herramienta que es genuinamente útil para la creación de contenido profesional, no solo impresionante en demostraciones.

Fortalezas:

-

Velocidad de generación líder en la industria

-

Verdadera entrada multimodal con hasta 12 archivos de referencia

-

Excelente comprensión de la física y el movimiento

-

Sincronización audiovisual nativa

-

Consistencia de personaje superior

-

Resolución nativa 2K (capaz de 4K)

-

Flujo de trabajo intuitivo basado en referencias

Debilidades:

-

La duración máxima de 15 segundos limita el contenido de formato largo

-

Disponibilidad limitada y barreras de registro para usuarios internacionales

-

Artefactos ocasionales durante movimientos extremadamente rápidos

-

Prompts de solo texto menos confiables que la generación basada en referencias

-

Las preocupaciones éticas requieren un desarrollo continuo de políticas

Quién debería usar Seedance 2.0:

-

Creadores de contenido de redes sociales que necesitan una respuesta rápida

-

Agencias de publicidad que producen contenido comercial

-

Creadores de videos musicales y productores de contenido de baile

-

Artistas de previsualización y concepto

-

Cineastas independientes que exploran ideas creativas

-

Cualquiera que priorice la velocidad, la resolución y el control basado en referencias

Quién podría preferir alternativas:

-

Creadores que necesitan videos de más de 15 segundos (considere Sora 2)

-

Usuarios que requieren un control de movimiento granular (considere Runway Gen-4)

-

Aquellos que no pueden acceder a plataformas chinas o alternativas de terceros

El futuro de la generación de video por IA

Seedance 2.0 señala que la generación de video por IA ha pasado de ser un "experimento interesante" a una "herramienta lista para la producción". Ya no preguntamos "¿puede la IA generar video?" sino más bien "¿qué deberíamos crear con ella?"

El rápido avance de la tecnología plantea preguntas importantes sobre el futuro de la producción de video, la autenticidad del contenido y el trabajo creativo. A medida que estas herramientas se vuelven más accesibles, la ventaja competitiva cambiará de la capacidad técnica a la visión creativa. Aquellos que puedan contar historias convincentes, comprender la estética visual y curar referencias efectivas prosperarán en este nuevo panorama.

Esto es solo febrero de 2026. Si Seedance 2.0 representa dónde comenzamos el año, el ritmo de avance sugiere que veremos capacidades aún más dramáticas antes de fin de año.

La pregunta ya no es si la IA transformará la producción de video, es qué tan rápido se adaptará para usar estas herramientas de manera efectiva.

¿Listo para comenzar a crear con Seedance 2.0? Acceda a múltiples modelos de vanguardia de video e imagen de IA a través de una plataforma conveniente en Try Seedance 2.

Esta reseña se basa en pruebas prácticas realizadas en febrero de 2026. La tecnología de generación de video por IA evoluciona rápidamente y las capacidades pueden cambiar. Verifique siempre las características y limitaciones actuales antes de comprometerse con flujos de trabajo de producción.