Die Landschaft der KI-Videogenerierung hat im Jahr 2026 einen entscheidenden Moment erreicht. Zwei Modelle dominieren nun das Gespräch: Seedance 2.0 von ByteDance und Sora 2 von OpenAI. Beide stellen bedeutende Sprünge in der Videosynthesetechnologie dar, verfolgen jedoch grundlegend unterschiedliche Ansätze zur Lösung derselben kreativen Herausforderungen. Dieser umfassende Vergleich untersucht jede Dimension, die zählt – von technischen Spezifikationen und Ausgabequalität bis hin zu Preisstrukturen und realen Anwendungsfällen –, um Ihnen zu helfen zu verstehen, welches Modell die Fähigkeiten liefert, die Sie tatsächlich benötigen.

Was Seedance 2 anders macht

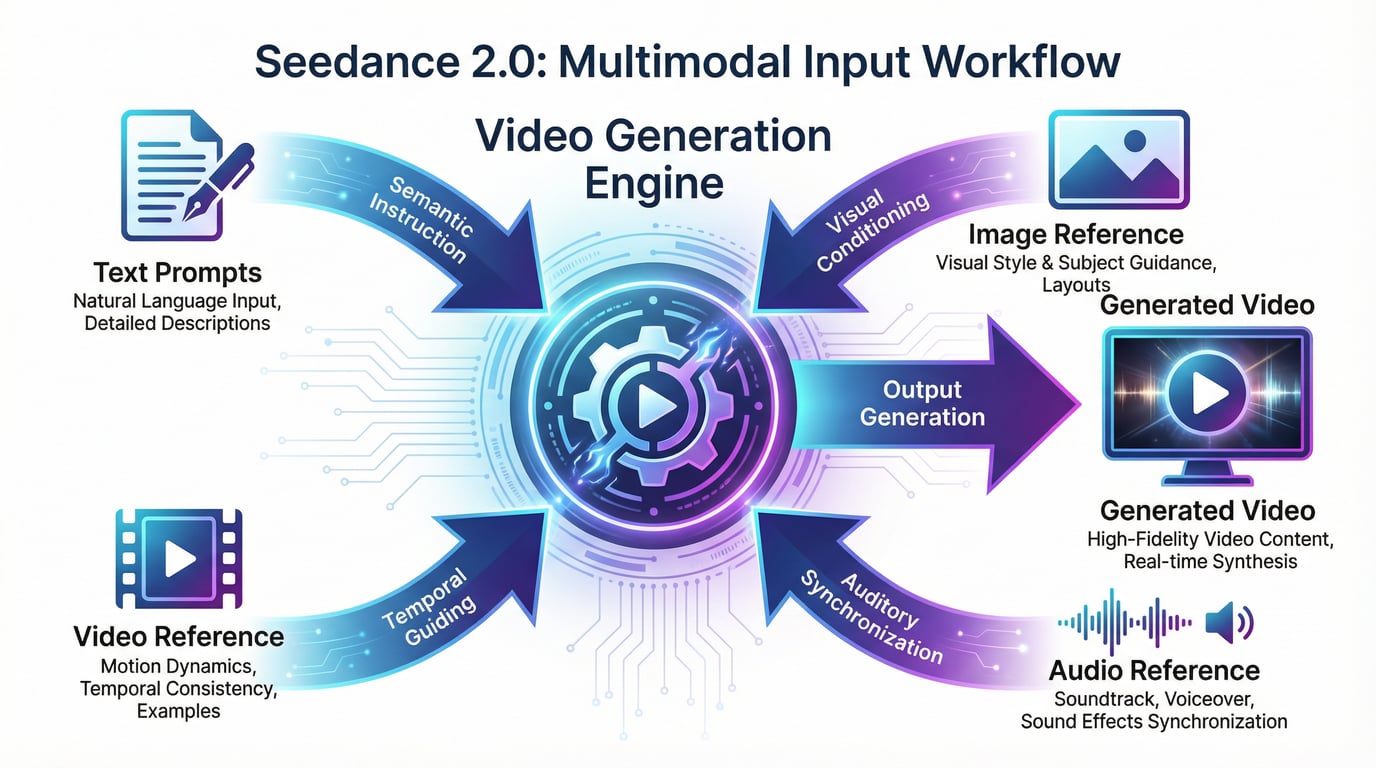

Seedance 2.0 führt eine einheitliche multimodale Architektur ein, die grundlegend ändert, wie Kreative mit KI-Videogenerierung interagieren. Im Gegensatz zu traditionellen Text-zu-Video-Modellen, die sich hauptsächlich auf schriftliche Eingabeaufforderungen stützen, akzeptiert Seedance 2.0 vier gleichzeitige Eingabetypen: Textbeschreibungen, Referenzbilder, Videoclips und Audiodateien. Dieses quad-modale Referenzsystem ermöglicht es Ihnen, genau anzugeben, was Sie möchten, indem Sie dem Modell Beispiele zeigen, anstatt zu versuchen, alles in Worten zu beschreiben.

Die praktischen Auswirkungen sind erheblich. Wenn Sie eine bestimmte Kamerabewegung benötigen, laden Sie ein Referenzvideo hoch, das genau diese Bewegung demonstriert. Wenn Sie einen bestimmten visuellen Stil wünschen, stellen Sie ein Bild bereit, das diese Ästhetik einfängt. Wenn Sie Audio benötigen, das mit bestimmten Beats oder Rhythmen synchronisiert ist, liefern Sie die Audiospur direkt. Das Modell kombiniert diese Referenzen dann gemäß Ihren Anweisungen in natürlicher Sprache und gibt Ihnen eine Kontrolle auf Regie-Ebene, ohne technisches Fachwissen in Prompt Engineering zu erfordern.

Dieser multimodale Ansatz löst eines der hartnäckigsten Probleme bei der KI-Videogenerierung: die Lücke zwischen kreativer Absicht und tatsächlicher Ausgabe. Frühere Modelle zwangen Kreative in einen frustrierenden Zyklus der Prompt-Verfeinerung, in der Hoffnung, auf die magische Kombination von Worten zu stoßen, die das gewünschte Ergebnis produzieren würde. Seedance 2.0 eliminiert einen Großteil dieses Rätselratens, indem es Ihnen ermöglicht, über mehrere Kanäle gleichzeitig zu kommunizieren.

Technische Spezifikationen: Wo jedes Modell glänzt

Auflösung und Ausgabequalität

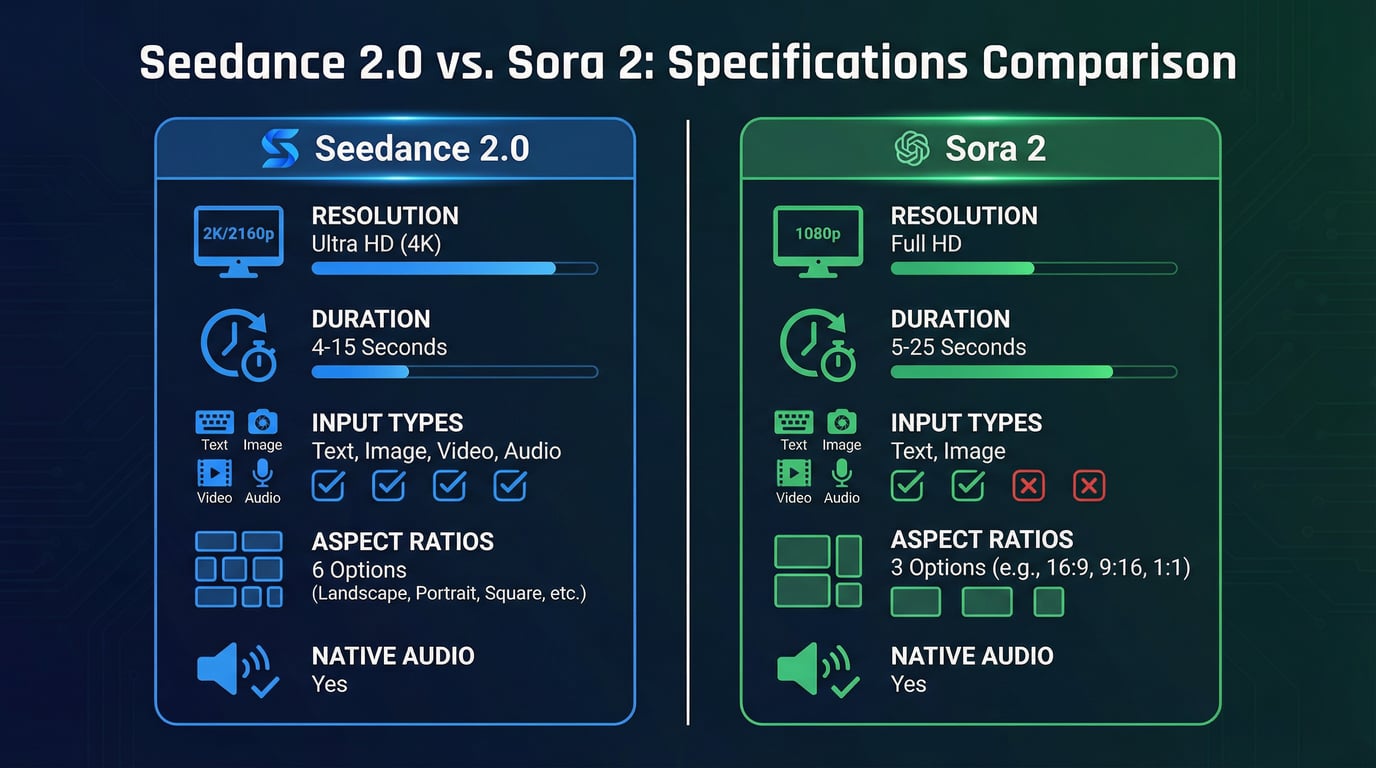

Seedance 2.0 liefert native 2K-Auflösung bei 2048×1152 Pixeln und positioniert sich damit als die derzeit höchstauflösende Option in Produktions-KI-Videomodellen. Dieser Auflösungsvorteil ist entscheidend für Inhalte, die für große Displays, hochauflösende Werbekampagnen oder jede Anwendung bestimmt sind, bei der die visuelle Wiedergabetreue die wahrgenommene Qualität direkt beeinflusst. Das Modell unterstützt sechs Seitenverhältnisse: 16:9, 9:16, 4:3, 3:4, 21:9 und 1:1, was praktisch jeden gängigen Anwendungsfall von YouTube-Videos über Instagram Stories bis hin zu ultrabreiten Kinoformaten abdeckt.

Sora 2 erreicht maximal 1080p-Auflösung, was für die meisten Anwendungen professionell bleibt, aber hinter der Ausgabetreue von Seedance 2.0 zurückbleibt. Wo Sora 2 dies kompensiert, ist seine außergewöhnliche Handhabung von Beleuchtung, Texturdetails und Farbkorrektur. Das Modell zeigt ein ausgeklügeltes Verständnis dafür, wie sich Licht in physischen Räumen verhält, und produziert Videos mit filmischer Tiefe und visueller Fülle, die manchmal höher auflösende Konkurrenten übertreffen.

Videodauer und zeitliche Konsistenz

Sora 2 hat einen entscheidenden Vorteil bei der Videolänge und unterstützt Generationen von 5 bis 25 Sekunden, je nach Zugriffsebene. Die 25-Sekunden-Fähigkeit der Pro-Version entspricht einer 4-fachen Steigerung gegenüber dem 6-Sekunden-Limit des ursprünglichen Sora-Modells und ermöglicht vollständige narrative Sequenzen ohne Zusammenfügen mehrerer Segmente. Diese verlängerte Dauer macht Sora 2 besonders wertvoll für Storytelling-Anwendungen, Produktdemonstrationen und alle Inhalte, die von einer anhaltenden narrativen Entwicklung profitieren.

Seedance 2.0 generiert Videos zwischen 4 und 15 Sekunden und konzentriert sich auf kürzere Clips mit hoher Wirkung, die für soziale Medien, Werbung und Workflows mit schnellen Schnitten optimiert sind. Auch wenn diese kürzere Dauer einschränkend erscheinen mag, passt sie perfekt zu den dominanten Inhaltsformaten auf Plattformen wie TikTok, Instagram Reels und YouTube Shorts, wo das Erbe von ByteDance in den Designprioritäten von Seedance 2.0 durchscheint.

Das Modell erweitert Videos durch ein Fortsetzungssystem, das Charakter- und Szenenkonsistenz über mehrere Generationen hinweg beibehält. Tests zeigen, dass die ersten 2-3 Erweiterungen die Qualität effektiv bewahren, jedoch bei der vierten Erweiterung eine merkliche Verschlechterung auftritt, was diesen Ansatz eher für grobe Vorschauen als für die endgültige Lieferung geeignet macht.

Physiksimulation und Bewegungsrealismus

Sora 2 setzt den Industriestandard für physikalische Genauigkeit und das Verständnis von Ursache und Wirkung. Das Modell demonstriert bemerkenswerte Fähigkeiten bei der Simulation komplexer physikalischer Interaktionen: Olympische Turnübungen mit korrekter Körpermechanik, Wasserdynamik, die Auftrieb und Flüssigkeitsverhalten richtig modelliert, und Stoffbewegungen, die Materialeigenschaften und Gravitationskräfte respektieren. Dieser physikorientierte Ansatz erzeugt Bewegungen, die sich eher in der Realität verankert als künstlich generiert anfühlen.

Unabhängige Tests bestätigen die Führungsposition von Sora 2 in dieser Dimension, wobei Bewerter die überlegene Handhabung von Objektpermanenz, realistischer Kollisionsphysik und natürlichen Ursache-Wirkungs-Beziehungen hervorheben. Das Modell behält konsistentes Charakteraussehen und Weltzustand über längere Zeiträume bei, eine kritische Fähigkeit für narrative Inhalte, bei denen Kontinuitätsfehler die Immersion brechen.

Seedance 2.0 verfolgt einen anderen Ansatz und priorisiert Bewegungsglätte und filmisches Kameraverhalten gegenüber strenger physikalischer Genauigkeit. Das Modell zeichnet sich durch die Produktion von filmähnlichen Kamerabewegungen aus – Tracking-Shots, Dolly-Zooms, Kranbewegungen –, die sich professionell ausgeführt statt mechanisch generiert anfühlen. Für Inhalte, bei denen visueller Stil und emotionale Wirkung wichtiger sind als physikalische Präzision, erzeugen die Bewegungscharakteristiken von Seedance 2.0 oft ästhetisch ansprechendere Ergebnisse.

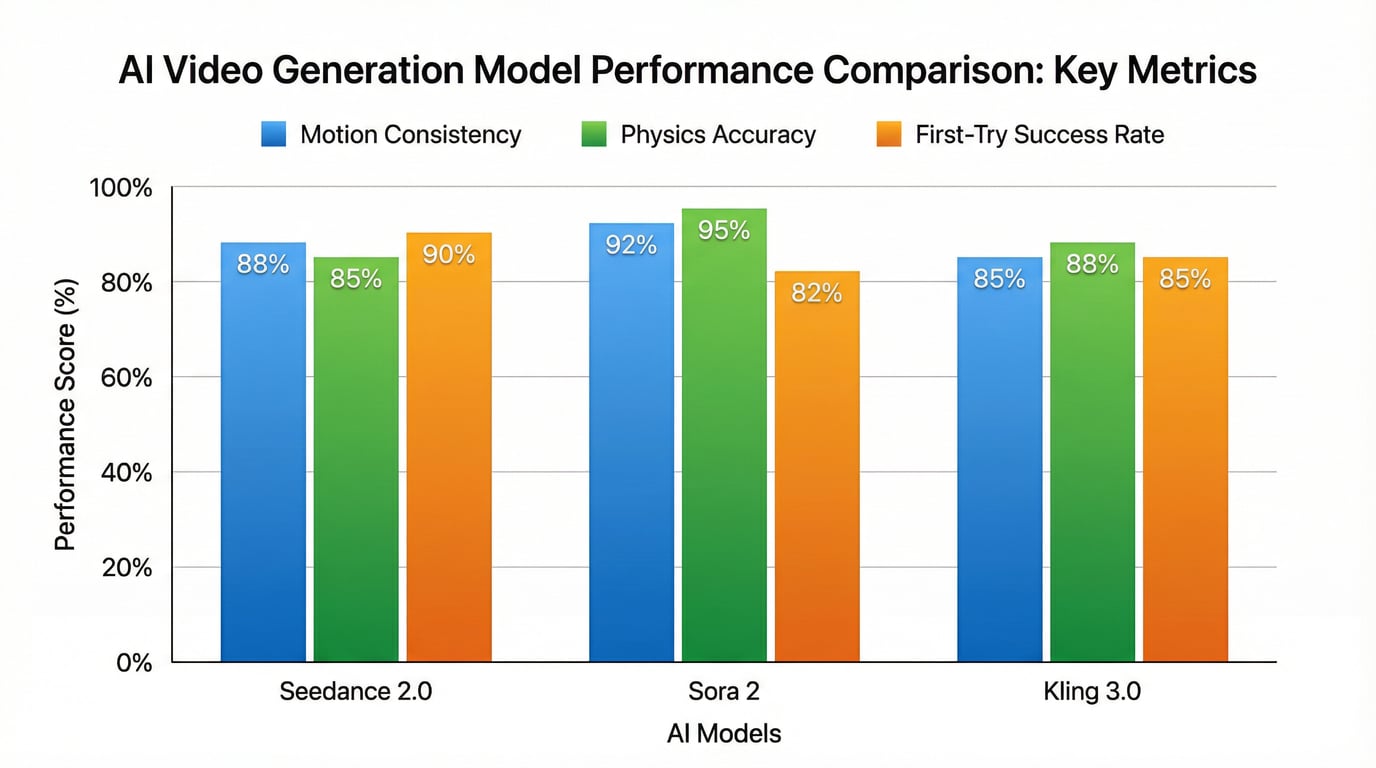

Tests zeigen, dass Seedance 2.0 bereits beim ersten Generierungsversuch etwa 90% brauchbaren Output erzielt, was den Trial-and-Error-Workflow, der frühere KI-Video-Tools plagte, drastisch reduziert. Diese hohe Erfolgsquote verwandelt die Videogenerierung von einer unvorhersehbaren Lotterie in einen zuverlässigen Produktionsprozess.

Der multimodale Vorteil: Die einzigartige Fähigkeit von Seedance 2

Das signifikanteste Unterscheidungsmerkmal zwischen diesen Modellen liegt in der Flexibilität der Eingabe. Das quad-modale Referenzsystem von Seedance 2.0 stellt ein grundlegendes Umdenken dar, wie Kreative mit KI-Videomodellen kommunizieren. Sie können bis zu 12 Referenzdateien in vier Kategorien hochladen und dann natürliche Sprache verwenden, um anzugeben, wie das Modell diese Referenzen kombinieren und anwenden soll.

Diese Fähigkeit ermöglicht Workflows, die mit Nur-Text-und-Bild-Modellen schlicht unmöglich sind. Wenn Sie ein Tanzvideo erstellen, laden Sie die Audiospur für perfekte Beat-Synchronisation hoch, Referenzbilder für das Aussehen des Charakters und einen Videoclip, der den gewünschten Choreografiestil demonstriert. Das Modell synthetisiert diese Eingaben in eine kohärente Ausgabe, die alle Ihre Spezifikationen gleichzeitig respektiert.

Die Audio-Referenzfähigkeit verdient besondere Aufmerksamkeit, da sie unter den führenden Modellen einzigartig für Seedance 2.0 ist. Während Sora 2 synchronisiertes Audio als Ausgabe generiert, kann es kein Audio als Eingabereferenz akzeptieren. Das bedeutet, dass Sie keine bestimmte Soundatmosphäre, Stimmcharakteristik oder musikalischen Rhythmus angeben können, dem Sora 2 folgen soll. Die Audioeingabeunterstützung von Seedance 2.0 ermöglicht präzise Kontrolle über die klangliche Dimension Ihrer Videos, entscheidend für Musikvideos, Markencontent mit spezifischen Audio-Identitäten und jede Anwendung, bei der audio-visuelle Synchronisation das kreative Konzept treibt.

Sora 2 unterstützt derzeit nur Text- und Bildeingaben und konzentriert sich darauf, sowohl Video als auch Audio aus diesen Quellen zu generieren. Diese einfachere Eingabestruktur macht Sora 2 für Kreative, die lieber hauptsächlich mit schriftlichen Beschreibungen arbeiten, unkomplizierter in der Anwendung, opfert aber die granulare Kontrolle, die multimodale Referenzen bieten.

Native Audiogenerierung: Beide Modelle liefern

Sowohl Seedance 2.0 als auch Sora 2 generieren nativ synchronisiertes Audio, wodurch separate Audioproduktions-Workflows entfallen. Diese gemeinsame Fähigkeit stellt einen großen Fortschritt gegenüber früheren KI-Videomodellen dar, die stummen Output produzierten, der manuelles Sounddesign erforderte.

Seedance 2.0 verwendet eine Dual-Branch-Diffusion-Transformer-Architektur mit separaten Verarbeitungspfaden für Video und Audio. Dieses Design gewährleistet eine enge Synchronisation zwischen visuellen Ereignissen und ihren entsprechenden Geräuschen – Schritte, die mit dem Auftreten der Füße übereinstimmen, Türschläge, die zu visuellen Auswirkungen passen, und Umgebungsklanglandschaften, die sich natürlich mit Szenenwechseln entwickeln. Das Audiogenerierungssystem erstellt Dialoge, Umweltgeräusche und Soundeffekte, die sich in die Visuals integriert anfühlen, anstatt nachträglich künstlich überlagert zu wirken.

Sora 2 generiert ebenfalls synchronisierte Dialoge und Soundeffekte mit einem hohen Maß an Realismus. Das Modell kann anspruchsvolle Hintergrundklanglandschaften, Sprache mit natürlicher Prosodie und Soundeffekte erstellen, die angemessen auf das Geschehen auf dem Bildschirm reagieren. Tests zeigen, dass die Audioqualität von Sora 2 in Bezug auf Wiedergabetreue und Realismus mit Seedance 2.0 mithalten oder diese sogar übertreffen kann, obwohl das Fehlen von Audio-Eingabereferenzen bedeutet, dass Sie weniger direkte Kontrolle über die klanglichen Eigenschaften haben.

Multi-Shot-Narrative Fähigkeiten

Seedance 2.0 führt ein narratives Planungssystem ein, das komplexe Prompts automatisch in Multi-Shot-Sequenzen aufteilt. Frühere KI-Videomodelle versuchten, ganze Geschichten in einzelne kontinuierliche Aufnahmen zu packen, was zu zeitlicher Kompression, verzerrter Bewegung oder ignorierten Promptelementen führte, wenn die Beschreibung die Kapazität des Modells überstieg. Der Planer von Seedance 2.0 analysiert Ihren Prompt, identifiziert natürliche Szenenwechsel und generiert eine Sequenz von Einstellungen, die zusammen die komplette Geschichte erzählen.

Diese Multi-Shot-Fähigkeit produziert Ergebnisse, die sich wie bearbeitete Sequenzen anfühlen statt wie rohes Single-Take-Material. Das Modell behält Charakterkonsistenz, visuellen Stil und narrative Kontinuität über Einstellungsgrenzen hinweg bei und löst damit eines der herausforderndsten Probleme bei der KI-Videogenerierung. Für Kreative, die narrative Inhalte, Erklärvideos oder jede Anwendung produzieren, die mehrere Perspektiven oder Szenenwechsel erfordert, erweitert diese Funktion dramatisch das, was innerhalb einer einzigen Generierung möglich ist.

Sora 2 behält außergewöhnliche Konsistenz über seine längeren Single-Shot-Dauern bei, handhabt Multi-Shot-Sequenzen jedoch anders. Das Modell zeichnet sich bei anhaltenden Szenen aus einer einzigen Perspektive mit komplexer Handlung aus, was es ideal für kontinuierliche narrative Momente macht, die von ungebrochenem zeitlichen Fluss profitieren. Für Multi-Shot-Sequenzen generieren Kreative typischerweise separate Clips und bearbeiten sie manuell zusammen, was präzisere Kontrolle über Übergänge bietet, aber zusätzliche Produktionsarbeit erfordert.

Leistungs-Benchmarks: Ergebnisse aus realen Tests

Unabhängige Tests über mehrere Bewertungsrahmen hinweg liefern quantitative Vergleichsdaten. In VBench-Bewertungen – einem maßgeblichen Benchmark für Videogenerierungsqualität – hat sich der Leistungsabstand zwischen Open-Sora 2.0 (einer Open-Source-Implementierung, die sich kommerziellen Sora-Fähigkeiten nähert) und OpenAI's Sora auf nur noch 0,69% verringert, was zeigt, dass Modelle der aktuellen Generation nahezu Parität in messbaren Qualitätsmetriken erreicht haben.

Community-Tests zeigen unterschiedliche Leistungsprofile. Seedance 2.0 demonstriert überlegene Bewegungskohärenz und Kameradynamik, mit Objekten und Kamerabewegungen, die sich natürlich und professionell ausgeführt anfühlen. Die Erfolgsquote von über 90% beim ersten Versuch übertrifft signifikant frühere Tools, die mehrere Generierungsversuche erforderten, um brauchbare Ergebnisse zu erzielen.

Sora 2 führt bei der Genauigkeit der Physiksimulation und der zeitlichen Konsistenz, insbesondere bei Szenen mit komplexen physikalischen Interaktionen, mehreren Charakteren oder erweiterten narrativen Sequenzen. Das Verständnis des Modells für Ursache-Wirkungs-Beziehungen und Objektpermanenz produziert Videos, in denen sich die Welt vorhersehbar und konsistent über den gesamten Clip verhält.

Für filmisches Storytelling, das sanfte Bewegungen und anspruchsvolle Kameraarbeit erfordert, zeigt Seedance 2.0 in Tests klare Vorteile. Für technisch anspruchsvolle Szenen mit schneller Action, komplexer Physik oder längeren Dauern liefert Sora 2 derzeit stabilere Ergebnisse.

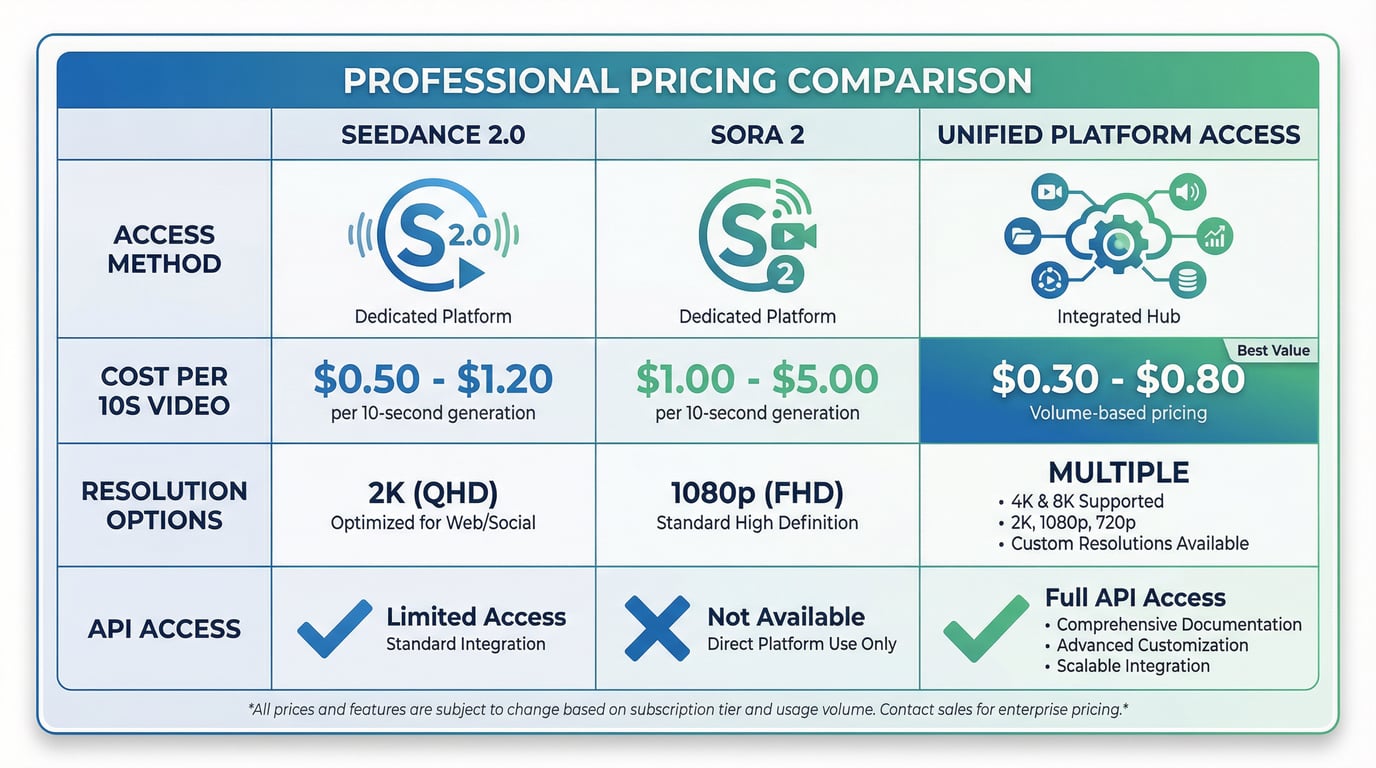

Preisgestaltung und Zugänglichkeit: Der Kostenfaktor

Die Preisstrukturen unterscheiden sich erheblich zwischen diesen Modellen und spiegeln unterschiedliche Geschäftsstrategien und Zielmärkte wider.

Sora 2 arbeitet mit einem Abrechnungsmodell pro Sekunde über die API von OpenAI und berechnet je nach Auflösung und Stufe 0,10 bis 0,50 USD pro Sekunde. Ein typisches 10-Sekunden-Video in Standardauflösung kostet etwa 1,00 USD, während Generationen der Pro-Stufe in maximaler Qualität bis zu 5,00 USD für die gleiche Dauer erreichen können. OpenAI bietet auch Abonnementzugang über ChatGPT Plus (20 USD/Monat) und ChatGPT Pro (200 USD/Monat), die kreditbasierte Generierung mit täglichen Limits bieten.

Das Abonnementmodell bietet ein besseres Preis-Leistungs-Verhältnis für Benutzer mit hohem Volumen, die ihre täglichen Kreditzuteilungen voll ausschöpfen können. ChatGPT Plus bietet etwa 30 Credits täglich, was je nach Dauer und Auflösungseinstellungen etwa 15-30 Videos entspricht. ChatGPT Pro bietet 100+ Credits täglich und unterstützt professionelle Produktionsworkflows mit höheren Volumenanforderungen.

Die Preise für Seedance 2.0 variieren je nach Zugriffsmethode. Das Modell ist derzeit hauptsächlich über die Jimeng (Dreamina) Plattform von ByteDance verfügbar, wobei der API-Zugang voraussichtlich am 24. Februar 2026 über Volcengine starten wird. Drittanbieter bieten Zugang zu Seedance 2.0 zu Kosten von 0,50 bis 1,20 USD pro 10-Sekunden-Video an, im Allgemeinen niedriger als die offiziellen Preise von Sora 2, aber höher als einige Drittanbieter von Sora 2 Wiederverkäufern.

Die Kostengleichung geht über den Preis pro Video hinaus und umfasst den Erfolgsquotenfaktor. Die 90%ige Erfolgsquote von Seedance 2.0 beim ersten Versuch bedeutet, dass Sie typischerweise brauchbare Ergebnisse ohne mehrere Generierungsversuche erzielen, was Ihre realen Kosten pro brauchbarem Video effektiv senkt. Modelle mit niedrigeren Erfolgsquoten erfordern Budgetzuweisungen für Wiederholungen und Qualitätsfilterung, was Ihre effektiven Kosten potenziell verdoppeln kann, selbst wenn der nominale Preis pro Video niedriger erscheint.

Zugang über einheitliche Plattformen

Anstatt separate Konten und APIs für jedes Modell zu verwalten, greifen viele Kreative über einheitliche Plattformen auf Seedance 2.0 und Sora 2 zu, die mehrere KI-Videomodelle aggregieren. Diese Plattformen bieten mehrere Vorteile: eine einzige Abrechnung über alle Modelle hinweg, konsistentes Interface-Design, das Lernkurven reduziert, und die Möglichkeit, verschiedene Modelle mit demselben Prompt für einen direkten Qualitätsvergleich zu testen.

Try Seedance 2 bietet optimierten Zugang zu Seedance 2.0 neben anderen führenden Video- und Bildgenerierungsmodellen. Die Plattform eliminiert die Komplexität der Verwaltung mehrerer API-Schlüssel, das Navigieren durch verschiedene Preisstrukturen und das Erlernen separater Schnittstellen für jedes Modell. Sie können Videos mit Seedance 2.0, Sora 2 und anderen Modellen von einem einzigen Dashboard aus generieren und die Ergebnisse direkt vergleichen, um zu bestimmen, welches Modell für jeden spezifischen Anwendungsfall am besten geeignet ist.

Dieser einheitliche Ansatz erweist sich als besonders wertvoll für Produktionsworkflows, bei denen verschiedene Projekte unterschiedliche Modellstärken erfordern. Social-Media-Inhalte könnten von der multimodalen Kontrolle und der hohen Erfolgsquote von Seedance 2.0 profitieren, während narrative Sequenzen die verlängerte Dauer und physikalische Genauigkeit von Sora 2 nutzen könnten. Wenn beide Modelle über eine einzige Plattform zugänglich sind, können Sie die Modellfähigkeiten an die Projektanforderungen anpassen, ohne zwischen separaten Diensten wechseln zu müssen.

Empfehlungen für Anwendungsfälle: Welches Modell für was

Wählen Sie Seedance 2.0, wenn:

Sie maximale kreative Kontrolle durch Referenzen benötigen. Wenn Sie spezifische visuelle Stile, Bewegungsmuster, Audio-Atmosphären oder Kamerabewegungen replizieren möchten, bietet das multimodale System von Seedance 2.0 unübertroffene Präzision. Laden Sie Beispiele dessen hoch, was Sie wollen, beschreiben Sie, wie sie kombiniert werden sollen, und das Modell führt Ihre Vision mit minimalem Prompt Engineering aus.

Sie Social-Media-Inhalte in hohem Volumen produzieren. Der Bereich von 4-15 Sekunden passt perfekt zu den Formaten von TikTok, Instagram Reels und YouTube Shorts. Die 90%ige Erfolgsquote beim ersten Versuch ermöglicht zuverlässige Produktionsworkflows, bei denen Sie konsistente Ergebnisse ohne umfangreiche Iteration benötigen. Die native 2K-Auflösung sorgt dafür, dass Ihre Inhalte auf allen Geräten scharf aussehen.

Sie audio-visuelle Synchronisation mit spezifischen Audioeigenschaften benötigen. Musikvideos, Tanzinhalte, Markenvideos mit charakteristischen Sounds und jede Anwendung, bei der Audio das kreative Konzept treibt, profitieren von der Audio-Referenzeingabe von Seedance 2.0. Sie können exakte Takmuster, stimmliche Eigenschaften oder Soundatmosphären angeben, die das Modell in seiner Ausgabe anpasst.

Sie maximale Auflösung für Display- oder Druckanwendungen benötigen. Die native 2K-Ausgabe bietet überlegene Details für Großbildschirme, hochauflösende Werbung, Digital Signage und jeden Kontext, in dem visuelle Wiedergabetreue die wahrgenommene Qualität direkt beeinflusst.

Sie filmische Kameraarbeit und Bewegungsästhetik priorisieren. Für Inhalte, bei denen visueller Stil, sanfte Kamerabewegungen und filmähnliche Bewegungscharakteristiken wichtiger sind als strenge physikalische Genauigkeit, erzeugt das Bewegungsprofil von Seedance 2.0 ästhetisch ansprechendere Ergebnisse.

Wählen Sie Sora 2, wenn:

Sie eine verlängerte Dauer für narrative Sequenzen benötigen. Der Bereich von 5-25 Sekunden (je nach Stufe) ermöglicht vollständige Story-Beats, Produktdemonstrationen mit mehreren Funktionen oder alle Inhalte, die von einer anhaltenden zeitlichen Entwicklung profitieren, ohne Multi-Clip-Bearbeitung zu erfordern.

Physikalische Genauigkeit und Realismus kritisch sind. Für Inhalte, die reale Physik, komplexe Interaktionen, Sportbewegungen oder jede Anwendung darstellen, bei der unrealistische Bewegungen die Glaubwürdigkeit untergraben würden, liefern die Fähigkeiten zur Physiksimulation von Sora 2 überlegene Ergebnisse.

Sie unkomplizierte Text-zu-Video-Workflows bevorzugen. Wenn Sie mit Prompt Engineering vertraut sind und nicht die Komplexität der Verwaltung mehrerer Referenzdateien benötigen, bietet die einfachere Eingabestruktur von Sora 2 eine schlankere Erfahrung. Das starke semantische Verständnis des Modells produziert hervorragende Ergebnisse allein aus gut formulierten Textbeschreibungen.

Sie maximale zeitliche Konsistenz über lange Clips benötigen. Die Fähigkeit von Sora 2, Charakteraussehen, Weltzustand und narrative Kontinuität über Generationen von 20-25 Sekunden beizubehalten, macht es ideal für Inhalte, bei denen Konsistenzfehler sofort auffallen und problematisch wären.

Sie Fantasy-, abstrakte oder surreale Inhalte produzieren. Die kreative Interpretation abstrakter Konzepte durch Sora 2 und seine Fähigkeit, fantasievolle Szenarien zu generieren, die in der realen Welt nicht existieren, macht es besonders effektiv für künstlerische, experimentelle oder konzeptionelle Videoinhalte.

Technische Einschränkungen und Überlegungen

Beide Modelle haben Einschränkungen, die ihre Eignung für spezifische Anwendungen beeinflussen.

Die kürzere maximale Dauer von Seedance 2.0 erfordert Multi-Clip-Workflows für Inhalte, die länger als 15 Sekunden sind. Während das Erweiterungssystem eine angemessene Konsistenz für 2-3 Iterationen beibehält, wird eine Qualitätsverschlechterung darüber hinaus merklich. Diese Einschränkung macht Seedance 2.0 weniger geeignet für narrative Sequenzen in einer Aufnahme oder Inhalte, die von ungebrochenem zeitlichen Fluss profitieren.

Das multimodale Referenzsystem ist zwar mächtig, führt aber Komplexität ein. Das Verwalten mehrerer Referenzdateien, das Verstehen, wie das Modell verschiedene Eingabetypen kombiniert, und das Erlernen effektiver Referenzstrategien erfordert mehr Vorabinvestition als einfache Text-zu-Video-Workflows. Das Limit von 12 Dateien kann für komplexe Projekte, die zahlreiche Stil-, Bewegungs- und Audioreferenzen erfordern, einschränkend wirken.

Seedance 2.0 ist derzeit außerhalb des Ökosystems von ByteDance nur begrenzt zugänglich, wobei der API-Zugang erst kürzlich über ausgewählte Plattformen verfügbar wurde. Diese eingeschränkte Verfügbarkeit hat die Akzeptanz im Vergleich zu breiter zugänglichen Alternativen verlangsamt.

Die maximale Auflösung von 1080p bei Sora 2 bleibt hinter der 2K-Ausgabe von Seedance 2.0 zurück, was seine Eignung für Anwendungen, die maximale visuelle Wiedergabetreue erfordern, potenziell einschränkt. Die höheren Preise pro Sekunde können Sora 2 für die Produktion großer Mengen deutlich teurer machen, insbesondere bei der Generierung längerer Clips in Premium-Qualitätseinstellungen.

Beide Modelle produzieren gelegentlich Artefakte, Morphing oder Inkonsistenzen, die eine Neugenerierung erfordern. Planen Sie das 1,5- bis 2-fache Ihres erwarteten Generierungsvolumens ein, um Qualitätsfilterung und Wiederholungen zu berücksichtigen. Die Generierungszeiten liegen typischerweise zwischen 2-5 Minuten pro Video, abhängig von Dauer, Auflösung und aktueller Serverlast, was Echtzeit- oder Fast-Echtzeit-Anwendungen herausfordernd macht.

Die breitere Wettbewerbslandschaft

Während Seedance 2.0 und Sora 2 die aktuellen Diskussionen dominieren, existieren sie in einer sich schnell entwickelnden Wettbewerbslandschaft. Googles Veo 3.1 bietet sendefähigen Output mit kinostandardmäßigen Bildraten und starker Leistung bei unkomplizierten Generierungsaufgaben. Runways Gen-4 bietet die zugänglichsten Entwickler-Tools und präzise Bewegungskontrolle durch pinselbasierte Schnittstellen. Kling 3.0 von Kuaishou liefert hervorragenden Wert für unkomplizierte Prompt-zu-Video-Workflows, insbesondere für asiatische Themen und Umgebungen.

Jedes Modell besetzt eine bestimmte Position im Ökosystem. Sora 2 bleibt der Markenführer in Bezug auf filmische Qualität und Physiksimulation, obwohl seine höheren Kosten und begrenzte Verfügbarkeit Chancen für Alternativen schaffen. Seedance 2.0 bietet das umfassendste Kontrollsystem für Kreative, die genau wissen, was sie wollen und Referenzmaterialien bereitstellen können. Runway Gen-4 bedient Entwickler und technische Nutzer, die API-Qualität und Integrationsflexibilität priorisieren. Kling 3.0 liefert zuverlässige Ergebnisse zu wettbewerbsfähigen Preisen für Nutzer, die keine fortschrittlichen Referenzsysteme oder maximale physikalische Genauigkeit benötigen.

Das schnelle Entwicklungstempo bedeutet, dass der heutige Führer in jeder spezifischen Dimension innerhalb von Monaten überholt werden kann. Seedance 2.0 startete im Februar 2026, Sora 2 stabilisierte seine Infrastruktur Ende 2025 und Runway Gen-4 erweiterte seine API-Fähigkeiten Anfang 2026 – alles innerhalb eines komprimierten Zeitrahmens, der auf eine anhaltende schnelle Iteration über alle Plattformen hindeutet.

Zukünftige Entwicklung und Roadmap

Die Entwicklung der KI-Videogenerierung deutet auf mehrere klare Trends hin, die die Evolution beider Modelle prägen werden.

Die Auflösung wird weiter zunehmen, wobei 4K-Ausgabe eher zum Standard als zur Ausnahme wird. Seedance 2.0 unterstützt bereits bis zu 2160p (4K) abhängig von API-Stufe und Ratenbegrenzungen, was darauf hindeutet, dass Ultra-High-Definition-Ausgabe in der nächsten Modellgeneration allgemein zugänglich sein wird.

Dauergrenzen werden sich weiter ausdehnen und vollständige narrative Sequenzen innerhalb einzelner Generationen ermöglichen. Das aktuelle Maximum von 25 Sekunden stellt eine 4-fache Steigerung gegenüber früheren Modellen und dieser Trend wird wahrscheinlich anhalten, bis mehrminütige kontinuierliche Generationen ohne Qualitätsverlust machbar sind.

Multimodale Fähigkeiten werden sich über alle Modelle ausweiten. Das quad-modale Referenzsystem von Seedance 2.0 demonstriert klare Vorteile bei der kreativen Kontrolle, was darauf hindeutet, dass Wettbewerber ähnliche Eingabeflexibilität übernehmen werden. Die Fähigkeit, kreative Absichten über mehrere Kanäle gleichzeitig zu kommunizieren, stellt eine grundlegende Verbesserung gegenüber Nur-Text-Schnittstellen dar.

Physiksimulationen werden sich bei allen Modellen verbessern und die aktuelle Lücke zwischen der branchenführenden Genauigkeit von Sora 2 und den Fähigkeiten der Wettbewerber verringern. Da Trainingsdatensätze wachsen und Modellarchitekturen sich weiterentwickeln, werden realistische Bewegung und physikalische Interaktionen eher zur Grundvoraussetzung als zum Unterscheidungsmerkmal.

Echtzeit- oder Fast-Echtzeit-Generierung wird entstehen, wenn die Infrastruktur skaliert und die Modelleffizienz verbessert wird. Aktuelle Generierungszeiten von 2-5 Minuten begrenzen bestimmte Anwendungen; eine Reduzierung auf Sekunden würde völlig neue Anwendungsfälle in der Live-Produktion, interaktiven Inhalten und Echtzeit-Kreativwerkzeugen ermöglichen.

Die Entscheidung treffen: Ein Rahmenwerk

Die Wahl zwischen Seedance 2.0 und Sora 2 erfordert den Abgleich der Modellfähigkeiten mit Ihren spezifischen Anforderungen über mehrere Dimensionen hinweg.

Bewerten Sie Ihre Kontrollanforderungen. Wenn Sie spezifische Referenzmaterialien haben und präzise Kontrolle über visuellen Stil, Bewegungscharakteristiken und Audio-Atmosphäre benötigen, bietet das multimodale System von Seedance 2.0 Fähigkeiten, die Sora 2 nicht erreichen kann. Wenn Sie einfachere Workflows bevorzugen und mit Ergebnissen allein durch Textprompts zufrieden sind, kann der optimierte Ansatz von Sora 2 effizienter sein.

Berücksichtigen Sie Ihre Dauer-Bedürfnisse. Für Inhalte unter 15 Sekunden arbeiten beide Modelle effektiv. Für Sequenzen von 15-25 Sekunden ist Sora 2 Ihre einzige Option zwischen diesen beiden. Für Inhalte, die 25 Sekunden überschreiten, erfordern beide Modelle Multi-Clip-Workflows mit manueller Bearbeitung.

Beurteilen Sie Ihre Anforderungen an die physikalische Genauigkeit. Wenn Ihr Inhalt reale Szenarien darstellt, in denen unrealistische Bewegung sofort auffallen würde – Sport, komplexe Interaktionen, Ursache-Wirkungs-Sequenzen –, rechtfertigt die überlegene Physiksimulation von Sora 2 die höheren Kosten. Wenn visueller Stil und ästhetische Wirkung wichtiger sind als physische Präzision, erzeugen die Bewegungscharakteristiken von Seedance 2.0 oft angenehmere Ergebnisse.

Berechnen Sie Ihre realen Kosten. Berücksichtigen Sie Erfolgsquoten, nicht nur nominale Preise pro Video. Ein Modell mit 90% Erfolgsquote bei 1,00 USD pro Video kostet effektiv 1,11 USD pro brauchbarem Video. Ein Modell mit 60% Erfolgsquote bei 0,80 USD pro Video kostet 1,33 USD pro brauchbarem Video nach Berücksichtigung fehlgeschlagener Generationen. Die höhere Erfolgsquote von Seedance 2.0 beim ersten Versuch macht es oft trotz vergleichbarer nominaler Preise kosteneffizienter.

Berücksichtigen Sie Ihre Auflösungsanforderungen. Für Inhalte, die für große Displays, hochauflösende Werbung oder Anwendungen bestimmt sind, bei denen maximale visuelle Wiedergabetreue zählt, bietet die 2K-Ausgabe von Seedance 2.0 einen bedeutenden Vorteil. Für Standard-Web- und Social-Media-Anwendungen bleibt die 1080p-Ausgabe von Sora 2 voll professionell.

Testen Sie beide Modelle an Ihren tatsächlichen Anwendungsfällen. Theoretische Vergleiche reichen nur bis zu einem gewissen Punkt. Generieren Sie Testvideos mit beiden Modellen unter Verwendung von Prompts, die für Ihre realen Projekte repräsentativ sind. Bewerten Sie die Ergebnisse anhand Ihrer spezifischen Qualitätsstandards, Workflow-Anforderungen und kreativen Ziele. Das Modell, das bei Ihren tatsächlichen Inhalten besser abschneidet, ist wichtiger als das Modell, das in abstrakten Benchmarks gewinnt.

Fazit: Ergänzende Werkzeuge, keine direkten Konkurrenten

Seedance 2.0 und Sora 2 repräsentieren unterschiedliche Philosophien darüber, wie KI-Videogenerierung funktionieren sollte. Seedance 2.0 priorisiert kreative Kontrolle durch multimodale Referenzen und ermöglicht eine präzise Spezifikation von visuellem Stil, Bewegungscharakteristiken und Audio-Atmosphäre durch Beispiele anstelle von Beschreibungen. Sora 2 betont physikalische Genauigkeit und erweiterte zeitliche Konsistenz und produziert Videos, in denen sich die Welt realistisch über längere Zeiträume verhält.

Diese unterschiedlichen Ansätze machen die Modelle eher ergänzend als direkt konkurrierend. Professionelle Workflows nutzen zunehmend mehrere Modelle und wählen das Tool aus, das den Anforderungen jedes spezifischen Projekts am besten entspricht. Social-Media-Inhalte könnten die hohe Erfolgsquote und multimodale Kontrolle von Seedance 2.0 nutzen. Narrative Sequenzen könnten die verlängerte Dauer und Physiksimulation von Sora 2 nutzen. Produktdemonstrationen könnten je nachdem, ob der Inhalt visuellen Stil oder realistische Produktinteraktion betont, zwischen den Modellen wechseln.

Der Ansatz der einheitlichen Plattform – der Zugriff auf beide Modelle über Dienste wie Seedance 2 – spiegelt diese Realität wider. Anstatt sich exklusiv an das Ökosystem eines Modells zu binden, profitieren Kreative davon, beide Tools verfügbar zu haben und das richtige Modell für jede spezifische Aufgabe basierend auf tatsächlichen Anforderungen statt Plattformloyalität zu wählen.

Da sich die Technologie zur KI-Videogenerierung weiterhin rasant entwickelt, wird sich die Lücke zwischen diesen Modellen in einigen Dimensionen verringern, während in anderen neue Unterscheidungsmerkmale entstehen. Was konstant bleibt, ist das Grundprinzip: Passen Sie die Modellfähigkeiten an die Projektanforderungen an, testen Sie gründlich an Ihren tatsächlichen Anwendungsfällen und bleiben Sie flexibel genug, um neue Tools zu übernehmen, wenn sie ihren Wert in Produktionsworkflows beweisen.

Die Zukunft der KI-Videogenerierung liegt nicht darin, das eine beste Modell zu finden – sondern darin, ein Toolkit komplementärer Fähigkeiten aufzubauen, die zusammen kreative Visionen ermöglichen, die vor wenigen Monaten noch unmöglich waren. Sowohl Seedance 2.0 als auch Sora 2 verdienen ihren Platz in diesem Toolkit, wobei jedes in den Dimensionen brilliert, die für verschiedene Arten von Inhalten am wichtigsten sind.

Wichtige Erkenntnisse

| Dimension | Seedance 2.0 | Sora 2 |

|---|---|---|

| Auflösung | 2K (2048×1152) | 1080p |

| Dauer | 4-15 Sekunden | 5-25 Sekunden |

| Eingabetypen | Text, Bild, Video, Audio | Text, Bild |

| Seitenverhältnisse | 6 Optionen | 3 Optionen |

| Physikalische Genauigkeit | Gut | Exzellent |

| Bewegungsästhetik | Exzellent | Gut |

| Erfolg beim 1. Versuch | ~90% | ~82% |

| Am besten für | Social Media, multimodale Kontrolle, High-Res-Output | Narrative Sequenzen, Physiksimulation, verlängerte Dauer |

| Preisspanne | $0,50-1,20 pro 10s Video | $1,00-5,00 pro 10s Video |

Bereit, beide Modelle zu erleben? Try Seedance 2 bietet bequemen Zugang zu Seedance 2.0, Sora 2 und anderen führenden KI-Video- und Bildgenerierungsmodellen über eine einzige einheitliche Plattform – was die Komplexität der Verwaltung mehrerer Dienste eliminiert und Ihnen gleichzeitig die Flexibilität gibt, das richtige Tool für jedes Projekt zu wählen.