Als ByteDance im Februar 2026 Seedance 2.0 veröffentlichte, veränderte sich die Landschaft der KI-Videogenerierung über Nacht. Innerhalb weniger Tage versuchten internationale Kreative verzweifelt, chinesische Telefonnummern zu finden, nur um sich für den Zugang zu registrieren. Die sozialen Medien explodierten mit KI-generierten Videos, die sich nicht von professionell gedrehtem Material unterscheiden ließen. Einige Nutzer berichteten, dass sie in zwei Tagen über 8.000 Dollar durch den Weiterverkauf von Zugangsguthaben verdient hätten.

Das ist kein Hype – es ist ein echter Wendepunkt in der KI-Videotechnologie. Nach ausführlichen Praxistests mit Seedance 2.0 kann ich bestätigen, dass dieses Modell den bedeutendsten Fortschritt in der KI-Videogenerierung seit dem ersten Erscheinen von OpenAIs Sora darstellt. In diesem umfassenden Testbericht werde ich genau aufschlüsseln, was Seedance 2.0 anders macht, wie es sich in realen Szenarien schlägt und ob es den außergewöhnlichen Behauptungen gerecht wird, die online kursieren.

Was ist Seedance 2.0?

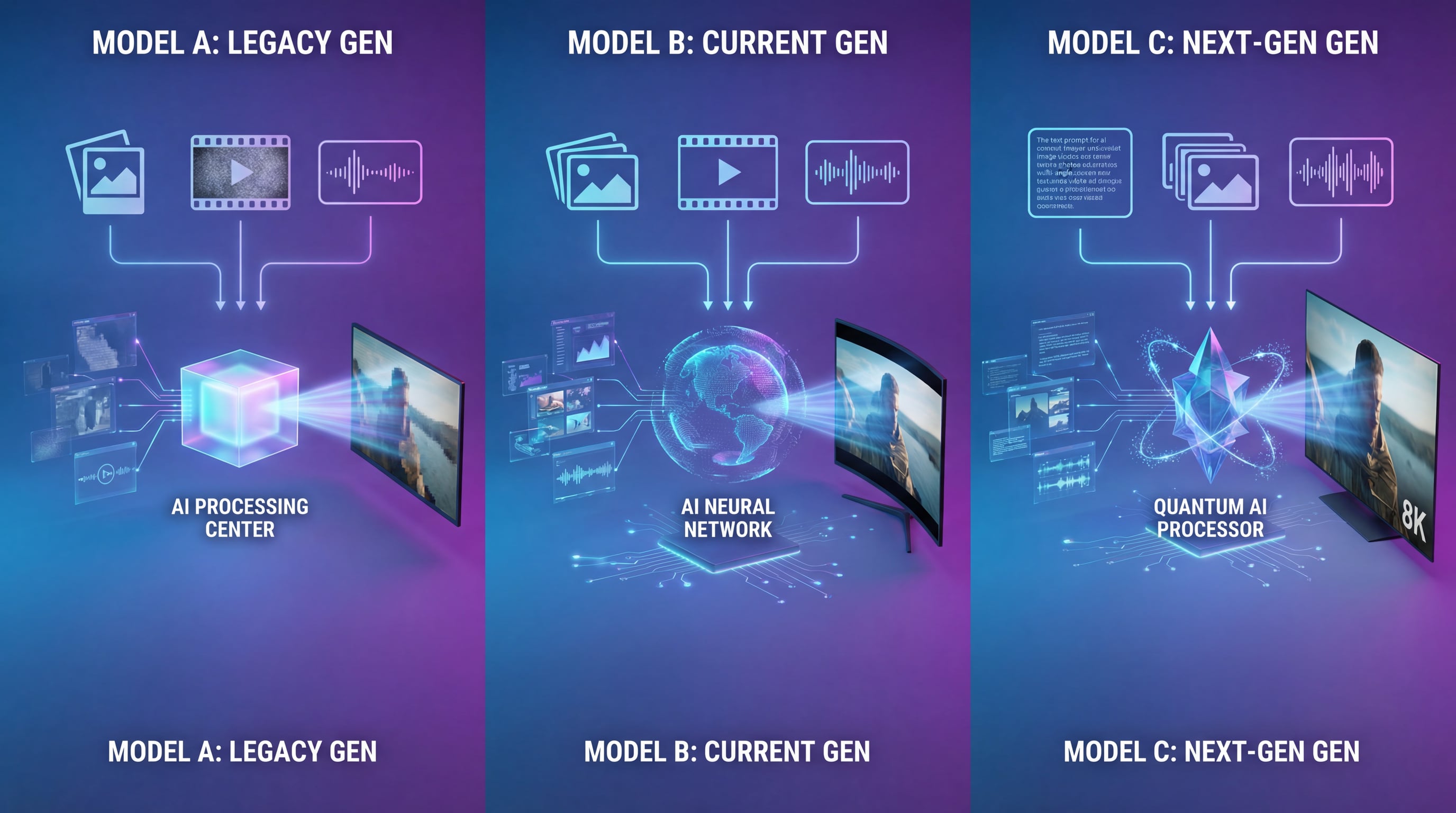

Seedance 2.0 ist das KI-Videogenerierungsmodell der zweiten Generation von ByteDance, das auf der Grundlage ihres früheren Seedance 1.5 Pro aufbaut. Was dieses Modell auszeichnet, ist seine echte multimodale Architektur – es kann gleichzeitig Bilder, Videos, Audiodateien und Text-Prompts verarbeiten und referenzieren, um kohärente Videoinhalte zu generieren.

Im Gegensatz zu früheren KI-Videomodellen, die typischerweise Text plus ein einziges Bild (oder höchstens ein erstes und letztes Frame) akzeptieren, ermöglicht Seedance 2.0 das Hochladen von bis zu 12 Referenzdateien in einer einzigen Generierung. Dazu gehören bis zu 9 Bilder, 3 Videoclips und 3 Audiodateien, mit einem kombinierten Video-/Audio-Längenlimit von 15 Sekunden.

Das Modell kann Videos von 4 bis 15 Sekunden Länge in nativer 2K-Auflösung (2048×1152) generieren, wobei einige Berichte je nach API-Stufe auf 4K-Fähigkeit hindeuten. Die Generierungszeit liegt typischerweise zwischen 30 und 90 Sekunden für einen 5-Sekunden-Clip bei 1080p, was es durchweg zum schnellsten unter den Top-Tier-Modellen macht.

Möchten Sie Seedance 2.0 und andere hochmoderne KI-Videomodelle ohne den Stress mehrerer Registrierungen erleben? Testen Sie Seedance 2 hier für nahtlosen Zugang zu mehreren hochmodernen Video- und Bildgenerierungsmodellen über eine einzige, bequeme Plattform.

Hauptmerkmale, die Seedance 2.0 auszeichnen

1. Echtes multimodales Referenzsystem

Das transformativste Merkmal von Seedance 2.0 ist sein referenzbasiertes Erstellungssystem. Anstatt aufwendige Text-Prompts zu erstellen, um komplexe Kamerabewegungen oder Action-Sequenzen zu beschreiben, laden Sie einfach Referenzmaterialien hoch und lassen das Modell diese analysieren und replizieren.

Hier ist, was Sie referenzieren können:

-

Bewegung und Choreografie aus Videoclips

-

Kamerabewegungen und Kinematografie-Techniken

-

Visueller Stil und Ästhetik aus Bildern

-

Audio-Rhythmus und Atmosphäre für beatgenaues Editing

-

Charakteraussehen und Konsistenz über Aufnahmen hinweg

Dieser Ansatz verändert den kreativen Workflow grundlegend. Anstatt ein Experte für Prompt-Engineering zu werden, werden Sie zum Kurator von Referenzen – eine Fähigkeit, die die meisten Kreativen bereits besitzen.

2. Fortgeschrittenes physikalisches Verständnis

Eines der hartnäckigen Probleme früherer KI-Videomodelle war ihr schlechtes Verständnis der realen Physik. Charaktere glitten statt zu gehen, Objekte schwebten unnatürlich, und Action-Sequenzen sahen aus, als würden sie unter Wasser stattfinden.

Seedance 2.0 demonstriert ein ausgefeiltes Verständnis von Physik, Schwerkraft und Impuls. Während der Tests generierte ich Kampfkunstsequenzen, bei denen Schläge sichtbare Auswirkungen hatten, Tänzer bei komplexen Bewegungen die richtige Gewichtsverteilung beibehielten und Objekte mit glaubwürdiger Beschleunigung fielen. Das Modell versteht, dass ein Drehkick Schwung erfordert, dass Stoff Gewicht hat und natürlich fällt, und dass Kamerawackeln der Aktionsintensität entsprechen sollte.

3. Komplexe Kameraarbeit und One-Shot-Sequenzen

Professionelle Kinematografie beinhaltet komplizierte Kamerabewegungen, die zuvor in Text-Prompts fast unmöglich zu beschreiben waren. Seedance 2.0 zeichnet sich dadurch aus, komplexe Kameraarbeit zu replizieren, wenn Videoreferenzen gegeben werden.

In meinen Tests generierte das Modell erfolgreich:

-

Tracking-Shots, die Motiven sanft durch Umgebungen folgen

-

Kranbewegungen, die weit beginnen und in Nahaufnahmen hineingehen

-

Orbit-Shots, die um stationäre Motive kreisen

-

First-Person-POV-Sequenzen mit realistischer Kopfbewegung

-

Nahtlose Übergänge zwischen mehreren Kamerawinkeln in einer einzigen Generierung

Die One-Shot-Fähigkeit ist besonders beeindruckend. Sie können eine Sequenz mit mehreren Einstellungen in Ihrem Prompt beschreiben, und Seedance 2.0 generiert sie als kontinuierliches Video mit natürlichen Übergängen zwischen den Winkeln – kein manuelles Zusammenfügen erforderlich.

4. Audiovisuelle Synchronisation

Seedance 2.0 ist das erste große KI-Videomodell, das Audio als kreativen Referenzinput integriert. Wenn Sie eine Audiodatei hochladen, analysiert das Modell deren Rhythmus, Intensität und emotionalen Ton und generiert dann Video, das mit den Audioeigenschaften synchronisiert ist.

Während der Tests habe ich ein dramatisches Orchesterstück hochgeladen und eine Kampfsequenz generiert. Das Modell passte schwere Perkussionstreffer automatisch an Aufprallmomente an, synchronisierte Kameraschnitte mit musikalischen Übergängen und passte die Aktionsintensität an den Dynamikumfang des Audios an. Diese audio-bewusste Generierung eliminiert Stunden manueller Bearbeitungsarbeit, die normalerweise erforderlich sind, um Video mit Musik zu synchronisieren.

5. Charakter- und Stilkontinuität

Die Beibehaltung eines konsistenten Charakteraussehens über mehrere Aufnahmen hinweg war eine große Herausforderung für die KI-Videogenerierung. Seedance 2.0 geht dies durch sein Multi-Referenzsystem an. Durch das Hochladen mehrerer Bilder desselben Charakters aus verschiedenen Winkeln baut das Modell ein vollständigeres Verständnis des Aussehens dieses Charakters auf und wahrt die Konsistenz im gesamten generierten Video.

In Vergleichstests übertraf Seedance 2.0 die Konkurrenz deutlich bei der Beibehaltung konsistenter Gesichtszüge, Kleidungsdetails und Körperproportionen über verschiedene Aufnahmen und Lichtverhältnisse hinweg.

Ergebnisse der Praxistests

Um die reale Leistung von Seedance 2.0 zu bewerten, habe ich eine Reihe von Tests für verschiedene Anwendungsfälle durchgeführt, denen Kreative häufig begegnen.

Test 1: Replikation von Action-Sequenzen

Ziel: Eine komplexe Kampfkunstsequenz nur unter Verwendung eines Referenzvideos und von Charakterbildern replizieren.

Setup: Ich lud eine 10-sekündige Kung-Fu-Kampfszene als Bewegungsreferenz sowie zwei Roboter-Charakterbilder hoch (eines für jeden Kämpfer).

Prompt: „Ersetze die Kämpfer in @video1 durch @image1 und @image2 Robotercharaktere. Behalte die exakte Choreografie, Kameraführung und das Aufprall-Timing des Referenzvideos bei. Inszeniere die Beleuchtung mit dramatischen Schatten.“

Ergebnis: Das generierte Video erfasste die ursprüngliche Choreografie mit bemerkenswerter Genauigkeit. Beide Roboter behielten durchgehend ein konsistentes Aussehen. Schläge, Tritte und Verteidigungsbewegungen passten zum Referenz-Timing. Die Physik des Aufpralls sah glaubwürdig aus – keine schwebenden Gliedmaßen oder unnatürliche Bewegungen. Das einzige kleine Problem war gelegentliche leichte Unschärfe bei den schnellsten Bewegungen.

Note: A-

Test 2: Filmische Kamerabewegung

Ziel: Ein Produktpräsentationsvideo mit professioneller Kameraführung generieren.

Setup: Ich lud ein Referenzvideo hoch, das eine Kranaufnahme zeigt, die weit beginnt und in eine Nahaufnahme übergeht, zusammen mit einem Produktbild.

Prompt: „Repliziere die Kamerabewegung von @video1, um das @image1 Produkt zu präsentieren. Luxuriöse Studioumgebung mit dramatischer Beleuchtung. Betone hochwertige Materialien und Handwerkskunst.“

Ergebnis: Die Kamerabewegung war sanft und sah professionell aus. Das Produkt blieb durchgehend scharf im Fokus. Die Beleuchtung änderte sich natürlich, als die Kamera näher kam. Die Hintergrundunschärfe (Bokeh) wirkte realistisch. Die Videoqualität war ohne zusätzliche Bearbeitung sendereif.

Note: A

Test 3: Tanzvideo mit Musiksynchronisation

Ziel: Ein Tanzperformance-Video synchron zur Musik erstellen.

Setup: Ich lud ein 15-sekündiges Tanz-Referenzvideo mit Audio sowie ein Porträtfoto hoch.

Prompt: „Ersetze den Tänzer in @video1 durch die Person @image1 in traditionellem mongolischem Kostüm. Behalte alle Choreografie und Kameraführung bei. Bühnenbild mit dramatischer Beleuchtung. Synchronisiere Bewegungen mit dem Musikrhythmus.“

Ergebnis: Dieser Test lieferte die beeindruckendsten Ergebnisse. Das Modell replizierte nicht nur die Tanzchoreografie genau, sondern hielt auch perfekte Synchronisation mit dem Beat der Musik. Kamerabewegungen passten zu musikalischen Übergängen. Das Kostüm des Charakters floss natürlich mit der Bewegung. Gesichtsausdrücke änderten sich angemessen mit dem emotionalen Ton der Musik.

Note: A+

Test 4: Erzählerische Szene nur aus Text

Ziel: Eine komplexe erzählerische Szene primär mit Textbeschreibung und minimaler visueller Referenz generieren.

Setup: Nur ein einziges Porträtbild als Charakterreferenz.

Prompt: „Folge dem Rücken der Person @image1, während sie am Silvesterabend über eine verschneite Dorfstraße geht. Schwache Straßenlaternen, Geräusch von Gepäckrädern auf Schnee. Sie halten an, um ihre gefrorenen Hände zu wärmen, Atem in kalter Luft sichtbar. Kamera folgt, als sie um eine Ecke biegen und ein Haus mit roten Dekorationen und warmem Licht aus den Fenstern sehen. Sie drücken das schwere Tor auf. Kamera bewegt sich an ihrer Schulter vorbei in den Innenhof voller roter Laternen. Ein Hund rennt zur Begrüßung. Eltern erscheinen aus der Küche, Mutter eilt herbei, während Vater so tut, als wäre er lässig.“

Ergebnis: Das Modell generierte eine überraschend kohärente erzählerische Sequenz. Die One-Shot-Kameraführung floss natürlich durch mehrere Szenenelemente. Atmosphärische Details wie Atemhauch und warmes Licht waren vorhanden. Einige spezifische Aktionen, die im Prompt erwähnt wurden (wie der rennende Hund und die exakten Reaktionen der Eltern), wurden jedoch vereinfacht oder weggelassen. Der emotionale Bogen war vorhanden, aber weniger nuanciert als beschrieben.

Note: B+

Dieser Test enthüllte eine wichtige Einschränkung: Während Seedance 2.0 bei referenzbasierter Erstellung hervorragt, erfordern rein textgesteuerte komplexe Erzählungen immer noch eine gewisse kreative Interpretation durch das Modell.

Test 5: Stiltransfer und kreative Neuinterpretation

Ziel: Einen spezifischen visuellen Stil auf ein Szenenkonzept anwenden.

Setup: Ich lud ein stilisiertes Bild aus „La La Land“ mit lebendigen Farben und theatralischer Beleuchtung hoch.

Prompt: „Erstelle eine fröhliche musikalische Tanzszene basierend auf dem visuellen Stil von @image1. Mehrere Tänzer, dynamische Kamerabewegung, feierliche Atmosphäre.“

Ergebnis: Das Modell zeigte beeindruckende kreative Interpretation. Ohne spezifische Choreografie-Referenz generierte es originelle Tanzbewegungen, die sich für eine Musicalnummer angemessen anfühlten. Das Color-Grading und die Beleuchtung entsprachen der Ästhetik des Referenzbildes. Die Kameraführung umfasste schwungvolle Bewegungen und dynamische Winkel, die die feierliche Stimmung verstärkten. Die Komplexität der Choreografie übertraf die Erwartungen angesichts des minimalen Inputs.

Note: A

Seedance 2.0 vs. Die Konkurrenz

Um Seedance 2.0s Position auf dem Markt zu verstehen, habe ich es mit den beiden anderen führenden KI-Videomodellen verglichen: OpenAIs Sora 2 und Runway Gen-4.

| Merkmal | Seedance 2.0 | Sora 2 | Runway Gen-4 |

|---|---|---|---|

| Max. Auflösung | 2K nativ (2160p fähig) | 1080p | 1080p |

| Max. Dauer | 4-15 Sekunden | 20-25 Sekunden | 10 Sekunden |

| Eingabetypen | Text, Bild (×9), Video (×3), Audio (×3) | Text, Bild (×1) | Text, Bild, Video |

| Generierungsgeschw. | 30-90 Sek. (5s @ 1080p) | 90-180 Sek. | 60-120 Sek. |

| Physik-Genauigkeit | Exzellent | Exzellent | Sehr gut |

| Charakter-Konsistenz | Exzellent (Multi-Referenz) | Gut (Cameo-Feature) | Gut |

| Audio-Sync | Native Unterstützung | Separate Generierung | Separate Generierung |

| Beste für | Referenzbasierte Erstellung, schnelle Iteration | Lange erzählerische Sequenzen | Bewegungssteuerung, Storyboarding |

Hauptunterscheidungsmerkmale

Vorteile von Seedance 2.0:

-

Schnellste Generierungszeiten unter Top-Tier-Modellen

-

Höchste native Auflösung (2K Standard, 4K fähig)

-

Flexibelstes Eingabesystem (12 Dateien, 4 Modalitäten)

-

Native audiovisuell Synchronisation

-

Überlegene Charakterkonsistenz durch Multi-Referenz

-

Am besten für schnelle Content-Iteration und Produktionsworkflows

Vorteile von Sora 2:

-

Längere maximale Videodauer (20-25 Sekunden)

-

Außergewöhnliche Kohärenz bei langen Erzählungen

-

Starke Weltsimulation und Physik

-

Besser für Storytelling, das erweiterte Sequenzen erfordert

Vorteile von Runway Gen-4:

-

Fortgeschrittene Motion-Brush-Steuerungen

-

Exzellente Storyboarding-Funktionen

-

Starke Benchmark-Leistung

-

Am besten für präzise Bewegungssteuerungsbedürfnisse

Die Wahl zwischen diesen Modellen hängt von Ihrem spezifischen Anwendungsfall ab. Seedance 2.0 glänzt in Produktionsumgebungen, in denen Geschwindigkeit, Auflösung und referenzbasierte Kontrolle Priorität haben. Sora 2 ist überlegen für längere erzählerische Inhalte. Runway Gen-4 bietet die feinteiligste Bewegungssteuerung.

Reale Anwendungsfälle

Basierend auf meinen Tests sind hier die Szenarien, in denen Seedance 2.0 den größten Wert liefert:

1. Social-Media-Content-Erstellung

Der Dauerbereich von 4-15 Sekunden passt perfekt zu TikTok-, Instagram-Reels- und YouTube-Shorts-Formaten. Die schnelle Generierungszeit ermöglicht eine rasche Iteration – Sie können mehrere kreative Ansätze in der Zeit testen, die für das Drehen und Bearbeiten eines einzelnen traditionellen Videos erforderlich wäre.

2. Werbung und Produktpräsentationen

Die 2K-Auflösung und die professionellen Kamerafähigkeiten machen Seedance 2.0 für kommerzielle Anwendungen geeignet. Produktvideos, Markenhinhalte und Werbespots können mit sendereifer Ausgabe generiert werden.

3. Musikvideos und Tanzinhalte

Die native Audiosynchronisationsfunktion macht Seedance 2.0 besonders leistungsfähig für musikbezogene Inhalte. Beatgenaues Editing geschieht automatisch, was mühsame manuelle Synchronisationsarbeit eliminiert.

4. Action- und Stunt-Visualisierung

Die Fähigkeit, komplexe Action-Sequenzen zu referenzieren und sie mit verschiedenen Charakteren zu replizieren, macht dieses Werkzeug unschätzbar für Pre-Visualisierung, Stunt-Planung und Action-Sequenz-Design.

5. Konzeptentwicklung und Pitching

Schnelle Iterationsgeschwindigkeit und hohe visuelle Qualität machen Seedance 2.0 exzellent für die Entwicklung und Präsentation kreativer Konzepte gegenüber Kunden oder Stakeholdern, bevor man sich zur vollen Produktion verpflichtet.

Einschränkungen und Überlegungen

Trotz seiner beeindruckenden Fähigkeiten hat Seedance 2.0 wichtige Einschränkungen, die Nutzer verstehen sollten:

1. Dauerbeschränkungen

Die maximale Dauer von 15 Sekunden begrenzt langes Storytelling. Sie können zwar mehrere Clips generieren und zusammenschneiden, dies erhöht jedoch die Workflow-Komplexität und garantiert keine perfekte Kontinuität zwischen separat generierten Segmenten.

2. Prompt-Abhängigkeit bei komplexen Erzählungen

Wenn ohne starke Referenzmaterialien gearbeitet wird, kann die Interpretation komplexer Text-Prompts durch das Modell inkonsistent sein. Spezifische Details können vereinfacht oder weggelassen werden. Dies macht referenzbasierte Workflows deutlich zuverlässiger als reine Text-zu-Video-Generierung.

3. Gelegentliche Artefakte bei schneller Bewegung

Extrem schnelle Bewegungen erzeugen manchmal leichte Bewegungsunschärfe oder zeitliche Artefakte. Obwohl diese geringfügiger und seltener sind als bei Konkurrenzmodellen, können sie gelegentlich eine Neugenerierung erfordern.

4. Begrenzte Verfügbarkeit

Stand Februar 2026 bleibt der Zugang zu Seedance 2.0 begrenzt. Die offizielle Jimeng-Plattform erfordert eine chinesische Telefonnummer für die Registrierung, was Barrieren für internationale Nutzer schafft. Drittanbieterplattformen, die Zugang bieten, können unterschiedliche Guthabenkosten und Funktionsverfügbarkeit haben.

Für stressfreien Zugang zu Seedance 2.0 ohne Registrierungsbarrieren, besuchen Sie Try Seedance 2, um mit der Erstellung mit mehreren fortgeschrittenen KI-Modellen über eine bequeme Plattform zu beginnen.

5. Ethische Überlegungen

Die Fähigkeit des Modells, hochrealistische menschliche Gesichter und Bewegungen zu generieren, wirft wichtige ethische Fragen auf. ByteDance hat als Reaktion auf Bedenken hinsichtlich Deepfakes und Fehlinformationen Beschränkungen für die Generierung realer Gesichter implementiert. Nutzer müssen eine Identitätsprüfung abschließen, um Videos mit ihrem eigenen Abbild zu generieren, und die unbefugte Nutzung der Gesichter anderer ist verboten.

Tipps für die besten Ergebnisse

Nach umfangreichen Tests sind hier meine Empfehlungen zur Maximierung der Ausgabequalität von Seedance 2.0:

1. Referenzmaterialien vor Text priorisieren

Wenn möglich, zeigen statt erzählen. Ein 5-sekündiges Referenzvideo der gewünschten Kamerabewegung liefert bessere Ergebnisse als ein Absatz, der sie beschreibt.

2. Nutzen Sie mehrere Winkel für Charakterkonsistenz

Wenn Charakterkonsistenz kritisch ist, laden Sie 3-5 Bilder des Charakters aus verschiedenen Winkeln hoch. Dies hilft dem Modell, ein vollständigeres Verständnis des Aussehens des Charakters aufzubauen.

3. Strukturieren Sie Ihre Prompts klar

Verwenden Sie das @-Symbol, um hochgeladene Dateien in Ihrem Prompt explizit zu referenzieren. Beschreiben Sie klar, welche Elemente aus welchen Referenzen stammen sollen. Struktur: „Verwende die Bewegung von @video1, den visuellen Stil von @image1 und das Charakteraussehen von @image2.“

4. Referenzqualität an gewünschte Ausgabe anpassen

Referenzmaterialien von geringer Qualität begrenzen die Ausgabequalität. Verwenden Sie wann immer möglich hochauflösende Bilder und Videos als Referenzen.

5. Audio für Rhythmus und Tempo nutzen

Wenn Sie Inhalte mit spezifischem Tempo oder Rhythmus generieren, laden Sie eine Audioreferenz hoch, auch wenn Sie planen, das Audio in der Postproduktion zu ersetzen. Das Modell nutzt es, um Timing und Schnitte zu informieren.

6. Über Prompts iterieren, nicht nur über Seeds

Wenn eine Generierung die Erwartungen nicht erfüllt, analysieren Sie warum. Oft liefert die Anpassung der Prompt-Struktur oder das Hinzufügen einer zusätzlichen Referenzdatei bessere Ergebnisse, als einfach mit denselben Eingaben neu zu generieren.

7. Die Strategie für das 12-Dateien-Limit verstehen

Bei einem Maximum von 12 Dateien sollten Sie strategisch Prioritäten setzen:

-

1-2 Dateien für Charakter-/Subjektreferenz

-

1-2 Dateien für Bewegungs-/Aktionsreferenz

-

1-2 Dateien für visuellen Stil/Ästhetik

-

1 Datei für Audio/Rhythmus (falls zutreffend)

-

Reservieren Sie verbleibende Slots für spezifische Detailreferenzen

Der breitere Einfluss: KI-Videos „Schwarzer Mythos“-Moment

Die chinesische Gaming-Community verwendet den Begriff „Schwarzer Mythos“-Moment, um zu beschreiben, wenn ein heimisches Produkt globale Anerkennung dafür erhält, internationale Standards zu erreichen oder zu übertreffen – eine Referenz an das Spiel „Black Myth: Wukong“, das bewies, dass chinesische Studios Spiele in AAA-Qualität erstellen können.

Seedance 2.0 repräsentiert den „Schwarzer Mythos“-Moment der KI-Videogenerierung. Es demonstriert, dass chinesische KI-Unternehmen nicht nur konkurrieren können, sondern potenziell führend in modernsten generativen KI-Technologien sind.

Game Sciences „Black Myth: Wukong“-Produzent Feng Ji testete Seedance 2.0 und erklärte: „Die Kindheitsära der AIGC-Videogenerierung ist offiziell beendet.“ Das ist keine Übertreibung – es ist eine genaue Einschätzung des technologischen Sprungs, den dieses Modell darstellt.

Die Implikationen gehen über den Nationalstolz hinaus. Die Veröffentlichung von Seedance 2.0 beschleunigt die Demokratisierung der Videoproduktion. Kleine Studios und unabhängige Kreative haben jetzt Zugang zu Fähigkeiten, die zuvor bedeutende Budgets und technisches Fachwissen erforderten. McKinsey schätzt, dass die KI-Inhaltsgenerierung innerhalb von fünf Jahren 60 Milliarden Dollar im Markt des Content-Ökosystems umverteilen könnte, wobei sich ein Großteil dieses Wertes von großen Produktionsfirmen zu kleineren Kreativen und Studios verlagert.

Preise und Zugang

Seedance 2.0 ist derzeit über die Jimeng-Plattform von ByteDance verfügbar, die auf einem guthabenbasierten System arbeitet. Die Generierungskosten variieren je nach Videodauer und Auflösung:

-

4-Sekunden-Video: ~20-30 Credits

-

10-Sekunden-Video: ~50-70 Credits

-

15-Sekunden-Video: ~80-100 Credits

Neue Nutzer erhalten typischerweise eine anfängliche Kreditzuteilung zum Testen. Zusätzliche Credits können gekauft werden, wobei die Preise je nach Region und Kontotyp variieren.

Internationale Nutzer stehen vor Registrierungsherausforderungen, da die Plattform eine chinesische Telefonnummer erfordert. Es sind mehrere Drittanbieterplattformen entstanden, die Zugang zu Seedance 2.0 mit alternativen Zahlungs- und Registrierungsoptionen anbieten, obwohl Nutzer deren Legitimität und Nutzungsbedingungen überprüfen sollten.

Für den bequemsten Zugang zu Seedance 2.0 und anderen führenden KI-Videomodellen bietet Try Seedance 2 eine einheitliche Plattform mit mehreren hochmodernen Modellen, die mehrere Registrierungen überflüssig macht und einfache Kreditsysteme bietet.

Fazit

Gesamtbewertung: 9,2/10

Seedance 2.0 repräsentiert den bedeutendsten Fortschritt in der KI-Videogenerierung seit dem Aufkommen der Technologie. Sein multimodales Referenzsystem, das außergewöhnliche physikalische Verständnis, die schnellen Generierungszeiten und die native audiovisuelle Synchronisation schaffen ein Werkzeug, das für professionelle Content-Erstellung wirklich nützlich ist – nicht nur in Demos beeindruckend.

Stärken:

-

Branchenführende Generierungsgeschwindigkeit

-

Echter multimodaler Input mit bis zu 12 Referenzdateien

-

Exzellentes Physik- und Bewegungsverständnis

-

Native audiovisuelle Synchronisation

-

Überlegene Charakterkonsistenz

-

2K native Auflösung (4K fähig)

-

Intuitiver referenzbasierter Workflow

Schwächen:

-

15 Sekunden maximale Dauer begrenzt Langform-Inhalte

-

Begrenzte Verfügbarkeit und Registrierungsbarrieren für internationale Nutzer

-

Gelegentliche Artefakte bei extrem schneller Bewegung

-

Nur-Text-Prompts weniger zuverlässig als referenzbasierte Generierung

-

Ethische Bedenken erfordern fortlaufende Richtlinienentwicklung

Wer sollte Seedance 2.0 nutzen:

-

Social-Media-Content-Ersteller, die schnelle Turnarounds benötigen

-

Werbeagenturen, die kommerzielle Inhalte produzieren

-

Musikvideo-Ersteller und Tanz-Content-Produzenten

-

Pre-Visualisierungs- und Konzeptkünstler

-

Unabhängige Filmemacher, die kreative Ideen erkunden

-

Jeder, der Geschwindigkeit, Auflösung und referenzbasierte Kontrolle priorisiert

Wer Alternativen bevorzugen könnte:

-

Kreative, die Videos länger als 15 Sekunden benötigen (ziehen Sie Sora 2 in Betracht)

-

Nutzer, die granulare Bewegungssteuerung benötigen (ziehen Sie Runway Gen-4 in Betracht)

-

Diejenigen, die keinen Zugang zu chinesischen Plattformen oder Alternativen von Drittanbietern haben

Die Zukunft der KI-Videogenerierung

Seedance 2.0 signalisiert, dass die KI-Videogenerierung vom „interessanten Experiment“ zum „produktionsreifen Werkzeug“ übergegangen ist. Wir fragen nicht mehr „kann KI Video generieren?“, sondern „was sollen wir damit erschaffen?“

Der schnelle Fortschritt der Technologie wirft wichtige Fragen über die Zukunft der Videoproduktion, die Authentizität von Inhalten und kreative Arbeit auf. Da diese Werkzeuge zugänglicher werden, wird sich der Wettbewerbsvorteil von technischer Fähigkeit zu kreativer Vision verlagern. Diejenigen, die fesselnde Geschichten erzählen, visuelle Ästhetik verstehen und effektive Referenzen kuratieren können, werden in dieser neuen Landschaft gedeihen.

Dies ist erst Februar 2026. Wenn Seedance 2.0 repräsentiert, wo wir das Jahr beginnen, deutet das Tempo des Fortschritts darauf hin, dass wir vor Jahresende noch dramatischere Fähigkeiten sehen werden.

Die Frage ist nicht mehr, ob KI die Videoproduktion transformieren wird – sondern wie schnell Sie sich anpassen werden, um diese Werkzeuge effektiv zu nutzen.

Bereit, mit der Erstellung mit Seedance 2.0 zu beginnen? Greifen Sie über eine einzige bequeme Plattform bei Try Seedance 2 auf mehrere hochmoderne KI-Video- und Bildmodelle zu.

Dieser Test basiert auf Praxistests, die im Februar 2026 durchgeführt wurden. Die Technologie der KI-Videogenerierung entwickelt sich schnell, und die Fähigkeiten können sich ändern. Überprüfen Sie immer die aktuellen Funktionen und Einschränkungen, bevor Sie sich zu Produktionsworkflows verpflichten.